Qwen2-Math

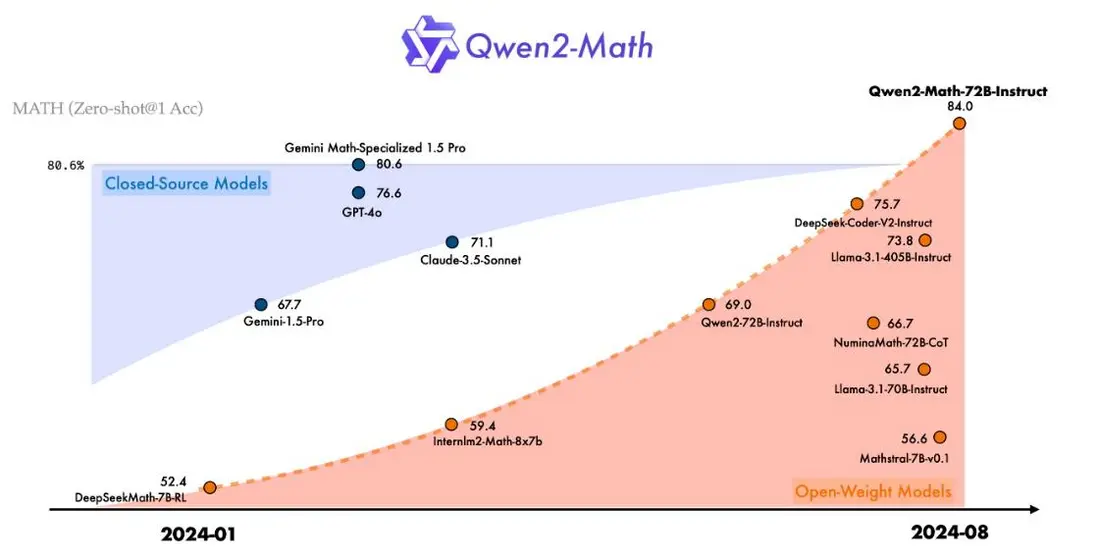

阿里巴巴開源的Qwen2-Math模型以驚人的84%準確率橫空出世,不僅超越了GPT-4o,更是將Claude-3.5-Sonnet和Gemini-1.5-Pro等一眾AI巨頭甩在身後。這個AI數學大師的誕生,是否預示着人工智能在精確科學領域的新紀元即將到來?

Qwen2-Math

官方數據圖展示

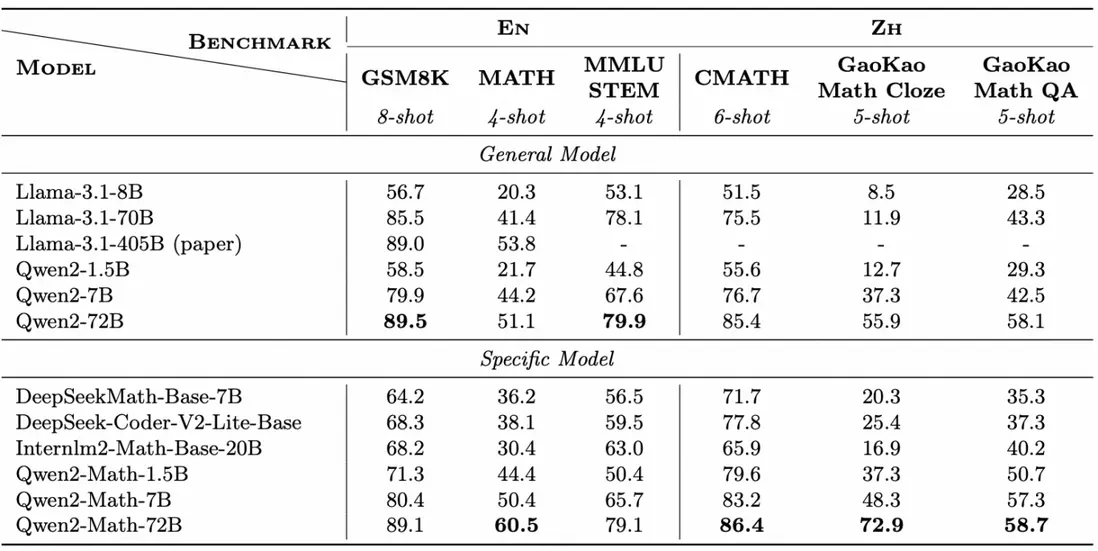

Qwen2-Math 的基礎模型使用 Qwen2-1.5B/7B/72B 進行初始化,然後在精心設計的數學專用語料庫上進行預訓練,該語料庫包含大規模高質量的數學網絡文本、書籍、代碼、考試題目以及由 Qwen2 模型合成的數學預訓練數據。

阿里在三個廣泛使用的英語數學基準 GSM8K、Math 和 MMLU-STEM 上評估了的 Qwen2-Math 基模型。此外,他們還評估了三個中國數學基準 CMATH,GaoKao Math Cloze 和 GaoKao Math QA。所有評估均使用 Few-shot CoT 方式。

數據測試

Qwen2-Math數據測試

在AI的世界裏,性能聲明往往需要經過嚴格的檢驗。Qwen2-Math也不例外。阿里雲團隊對這個模型進行了全方位的測試,確保其在各種數學場景下都能保持卓越的表現。

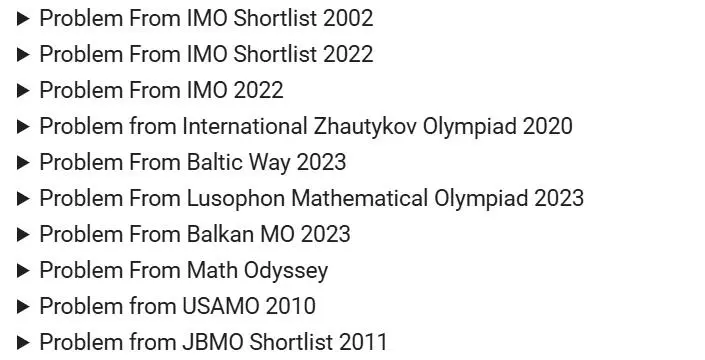

成功解決的數學競賽題

Qwen2-Math接受了一系列嚴苛的考驗。從GSM8K和MATH基準測試,再到中國的高考和中考數學題,模型都展現出了驚人的解題能力。特別是在MATH測評中,Qwen2-Math-72B-Instruct以84%的準確率傲視羣雄,超越了包括GPT-4o在內的多個頂尖模型。

去除數據污染

式為了確保測試結果的公正性,團隊對訓練和微調數據進行了嚴格的去污染處理。他們移除了與知名基準測試數據集有重疊的樣本,確保模型不會因為"提前看到答案"而獲得不公平的優勢。

包括 GSM8K、MATH在內,阿里移除了有13-gram重複且最長公共子序列比例大於0.6的訓練樣本。微調數據,移除了更多與 GSM8K、MATH、Aqua、SAT Math、OlympiadBench、College Math、AIME24、AMC23 等數據集有重疊的正例污染樣本,使用了同樣的過濾方法。

但阿里雲團隊並未就此止步。他們透露,目前的Qwen2-Math系列僅支持英語,但他們已經在積極開發支持英語和中文的雙語模型,並計劃在不久的將來推出多語言版本。此外,團隊還在持續優化模型,以進一步提升其解決更加複雜和具有挑戰性的數學問題的能力。

有關厚德雲

厚德雲致力於為用户提供穩定、可靠、易用、省錢的 GPU 算力解決方案。海量 GPU 算力資源租用,就在厚德雲。