摘要

下文為 ID 為“機智流”的博主用 GMI Cloud Inference Engine 新上線的 MiniMax M2 模型生成"熱梗表情包生成器"的實錄,全文為博主自撰原文。

上週我們發佈了實測 MiniMax M2 的文章,和一起 AI Coding 的小夥伴交流後發現,最常被問題到的兩類問題——一個是“我想開發某個類型的應用,用哪個模型效果更好?”;再就是“我需要調用不同種類的多個模型,每個模型都要適配和管理 API,有沒有效率高一點的方法?”。

今天我們就用最近做的 AI 小應用為例,和大家分享下 0 代碼開發 AI 應用的過程,做到一個 API 搞定所有模型(All Model in ONE API)。

正好最近“高雅人士”表情包火了,咱來開發一個“熱梗表情包生成器”,做個個人專屬“高雅人士”。效果如下(表情包進羣自取

Part 1

準備工作

1、需求梳理

這次要做的是一個“熱梗表情包生成器”。主要利用文生圖或者圖生圖大模型能力,快速將熱梗做成 meme 表情包,或者仿製爆火的表情包。

2、開發工具

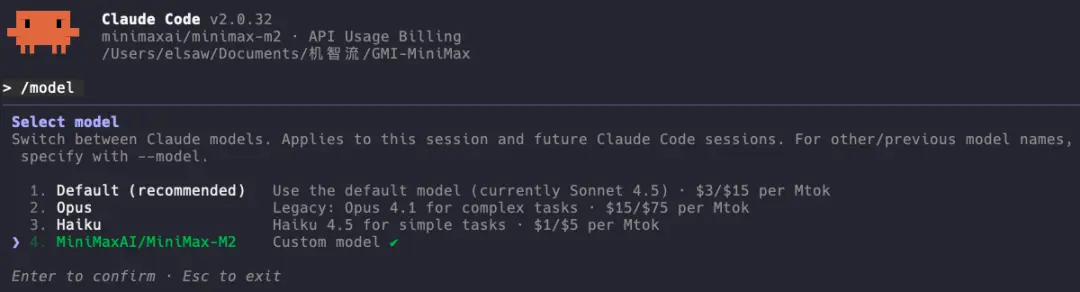

MiniMax M2接入Claude Code

因為上次評測後,我個人和同事的後續反饋很好,這次依然延續 Claude Code 和 MiniMax M2 作為開發工具(其實是懶得寫新工具的使用測評~),採用 Vibe Coding 的方式,具體怎麼實現參考《實測 MiniMax M2 》。

3、模型準備

1 方案選擇

為了方便模型選型和模型的測試調試,採用的是 MaaS API 方案調用應用會使用到的各類模型。

MaaS(Model as a Service,模型即服務):指通過雲端 API 提供模型能力的服務模式。

這次開發的 MaaS 平台選用的是 GMI Cloud[1] ,之前的項目用過他們的推理引擎(GMI Cloud Inference Engine),開發和後期運行的感覺都還不錯。他們最近上線了 MiniMax 家的全套模型,正好滿足這個AI應用的需求。

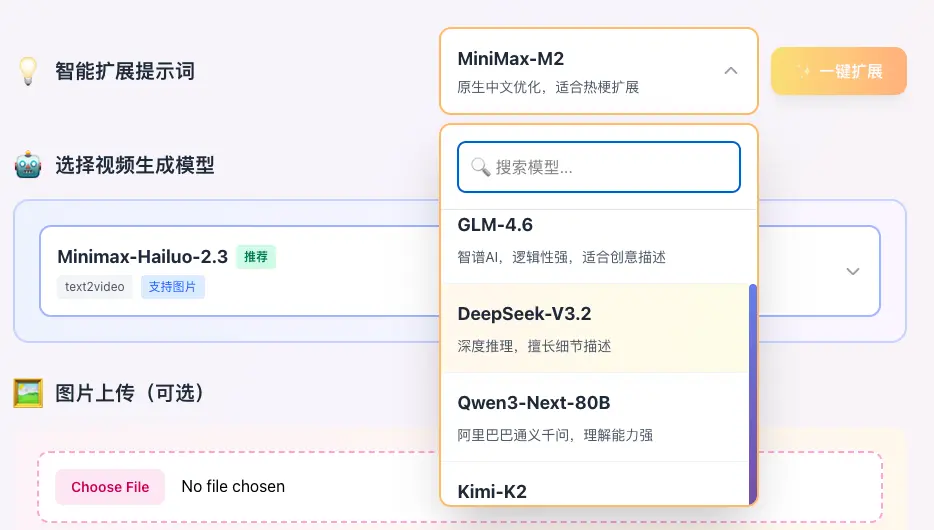

GMI Cloud 現在支持的 LLM,包含 MinMax、GLM、Deepseek、Qwen、Kimi、LAMA 系列各款模型

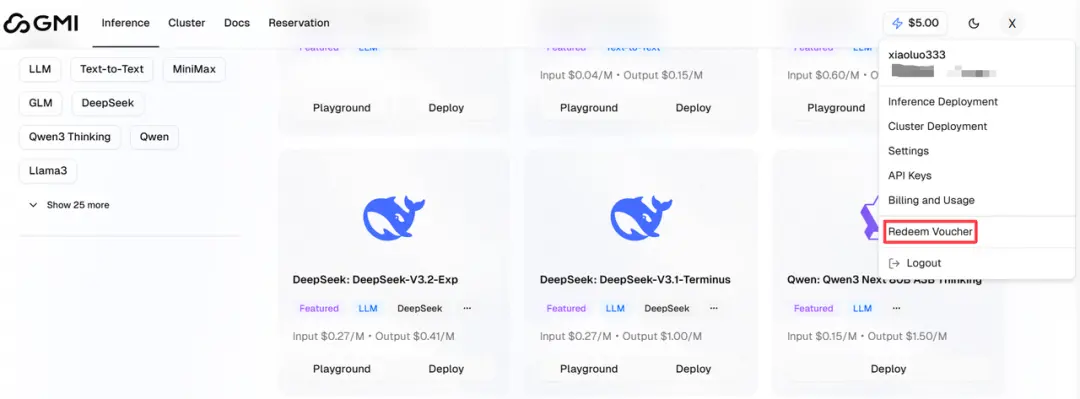

2 API 準備

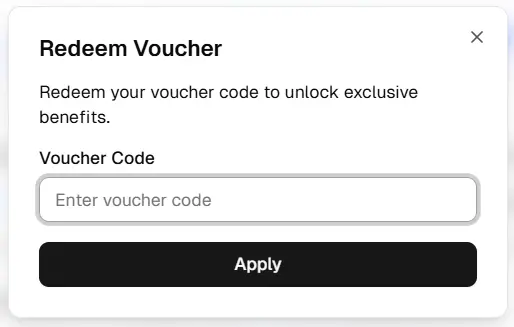

GMI Cloud 的使用流程很簡單,註冊後點擊右上角 “Redeem Voucher”,在彈出窗口中輸入兑換碼就可以看到充值到賬了。

GMI Cloud兑換

填寫兑換碼兑換額度

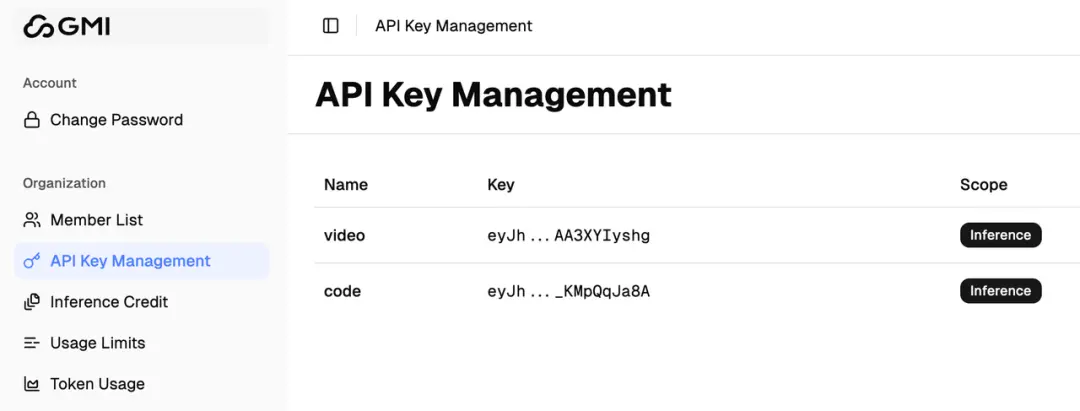

然後右上角點擊“API Keys”進入API的管理界面:

API管理界面

我的習慣是一個 AI 應用一個專屬的 API Key,方便我管理和統計用量。這裏看到我有兩個 Key,“Code”是我使用 GLM4.6、K2、Qwen3 來 Coding 的,用一個 Key 避免了在幾個模型官網和多個 Key 之間來回切換的麻煩。

“Video”這個 Key 就是這回“熱梗表情包生成器”要用到的 API Key 了。記錄下來,準備工作就完成了。

GMI Cloud最近上新模型,劃到最後進羣有優惠券可以領!

Part 2

(無聊的)開發

開發過程真的很無聊……

1、需求確認

還是先使用 CC 的 Plan 模式,提示詞如下:

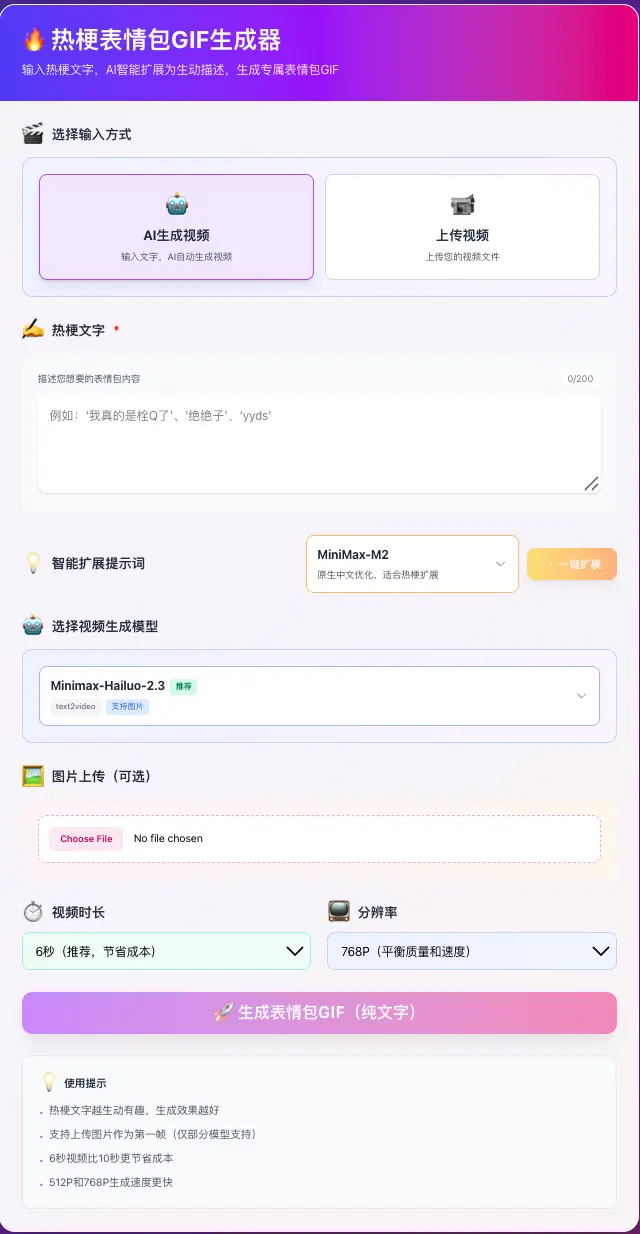

我想要製作一個網頁應用“熱梗表情包生成器”,能夠根據輸入的網絡熱梗(可帶參考圖),利用視頻生成模型生成可下載的gif表情包,需求如下:

1. 輸入支持文字,或文字+圖片兩種模式

2. 利用LLM對輸入的文字提示詞進行拓展

3. 先對視頻生成模型生成的視頻進行預覽,用户滿意後,點擊進行gif生成再生成後下載

LLM選用 MiniMax M2,API參考文檔 xxxxx

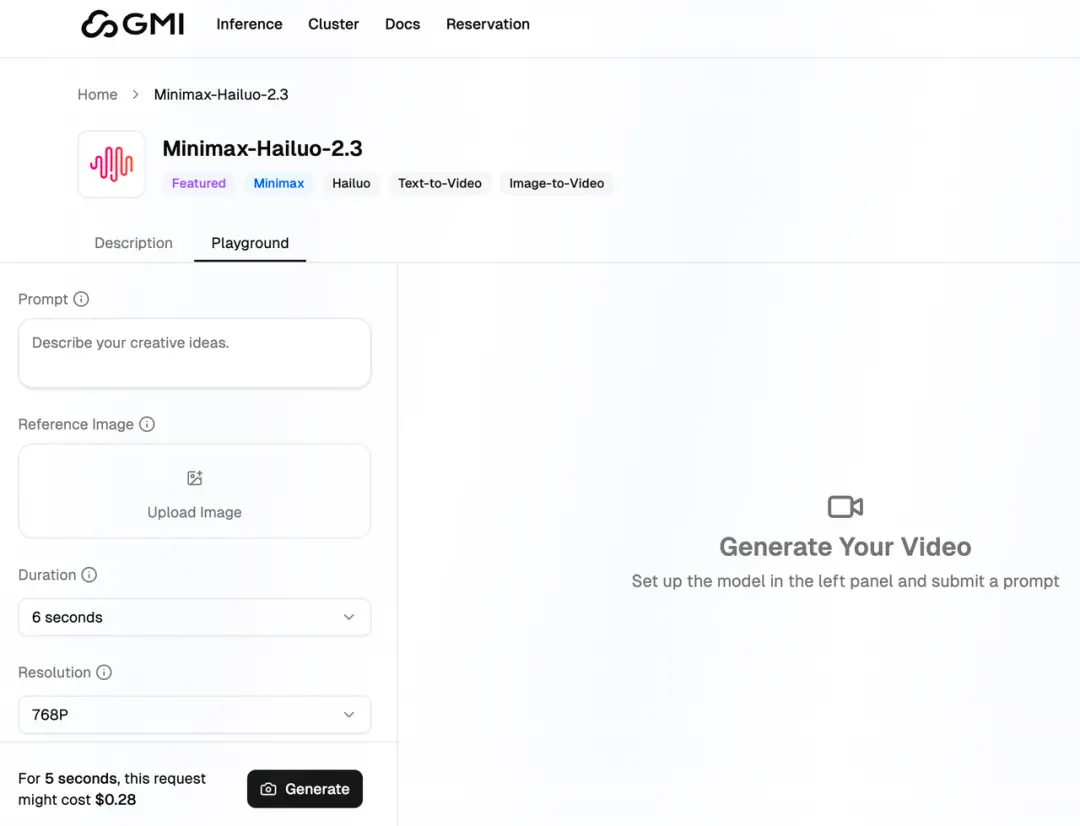

視頻生成模型選用Minimax-Hailuo-2.3,API使用文檔參考 xxxx這裏我選用的 MiniMax M2 作為擴詞模型。值得一提的是,GMI Cloud 目前和 MiniMax 官方有聯動活動,現在有不少免費用量。

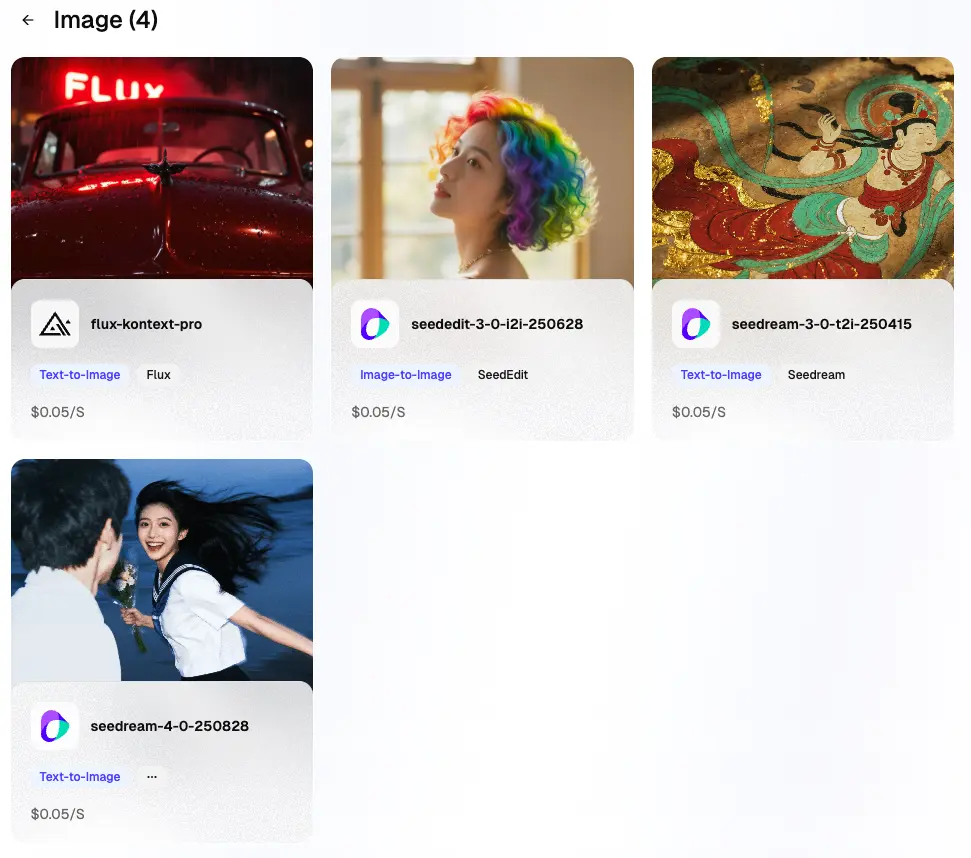

GMI Cloud 模型廣場

選用海螺 2.3 生視頻則是因為,在 GMI Cloud 中每一個模型都有廣場可以快速的測試模型效果和調整參數,在用相同的提示詞比較了 n 多個模型後,海螺 2.3 是現有視頻模型中性價比最高的。

GMI Cloud 支持的視頻生成模型,包含 MinMax 家的海螺、可靈、Veo 和 Sora 等熱門模型。

這裏説一下,前面提示詞中 XXX 的部分就是把 GMI Cloud 模型的使用文檔複製粘貼進去,因為是同一平台提供的服務,多數 MaaS 平台會統一 API 接口(GMI Cloud 現在支持的是 OpenAI 格式的接口),一個文檔就可以搞定眾多模型的調用!

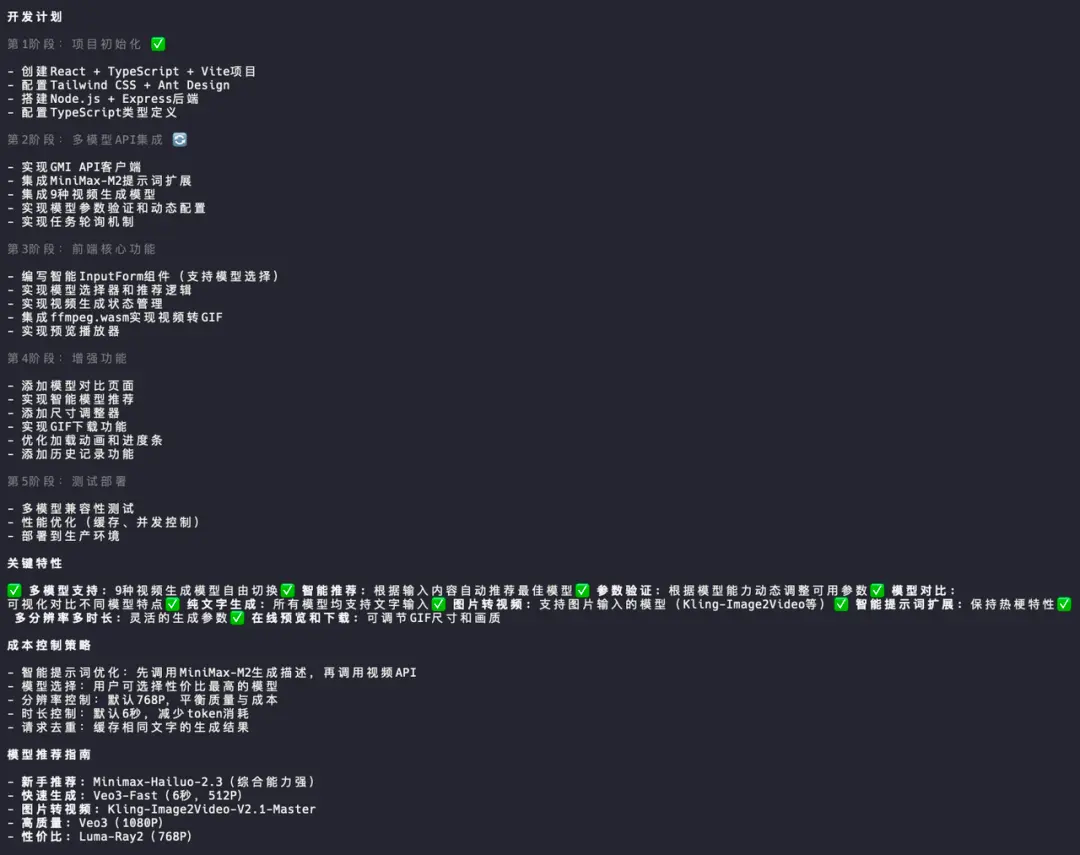

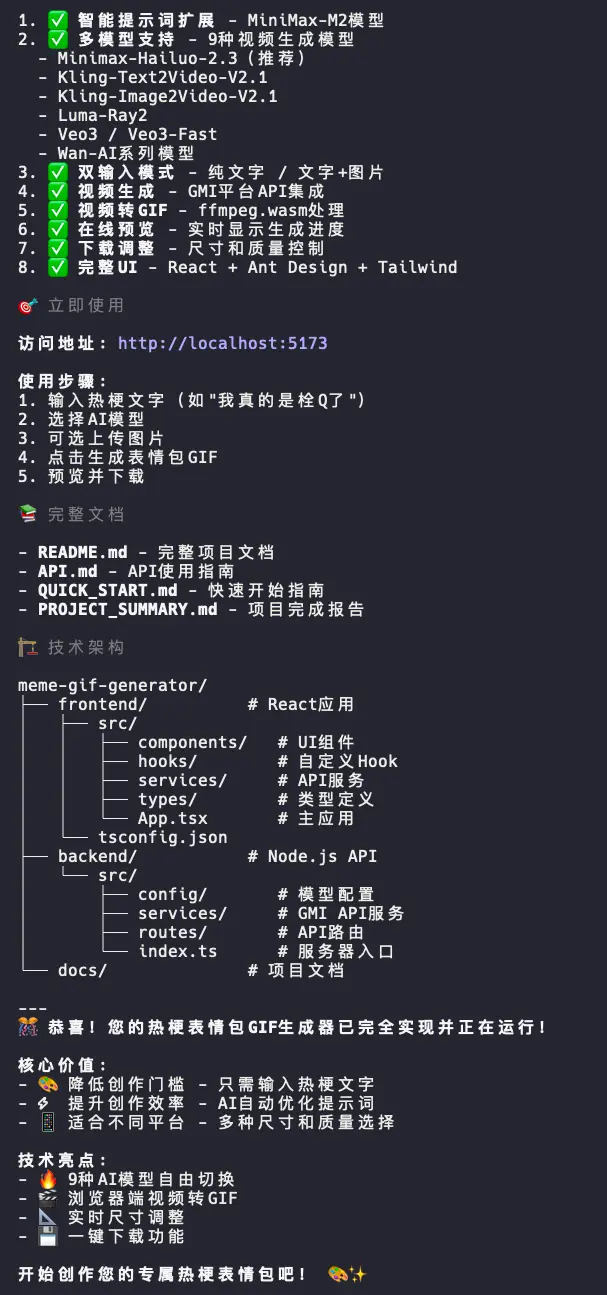

在 CC Plan 模式下經過幾輪對話後,確定了應用的功能和開發計劃:

經過幾輪“溝通”後的開發計劃

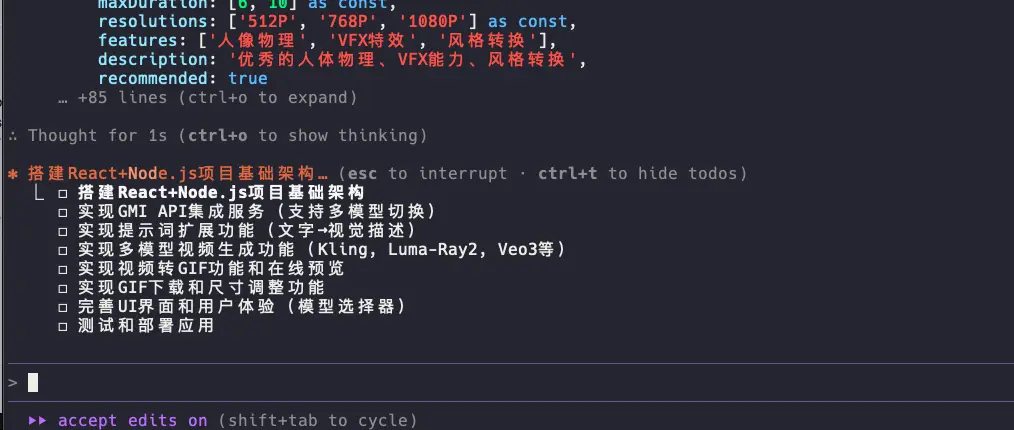

2、第一階段開發

開始執行計劃後我就去吃飯了……CC+MiniMax M2 根據 Todos 自己開始了開發工作。

根據 TODOs 開發,包含測試

吃完飯回來後測試遇到了幾個 bug,繼續對話粘貼錯誤代碼和我需要的改進,完成第一階段後的反饋如下:

第一階段反饋

把準備工作中準備好的 API Key 複製到環境文件中,就可以開始使用測試了。提示詞:

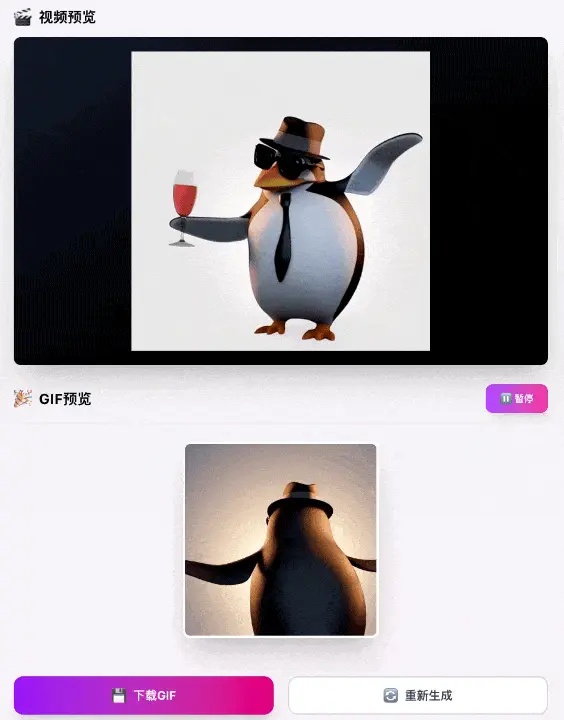

熱梗“高貴的優雅”,一隻且手拿紅酒杯獨自慢舞。

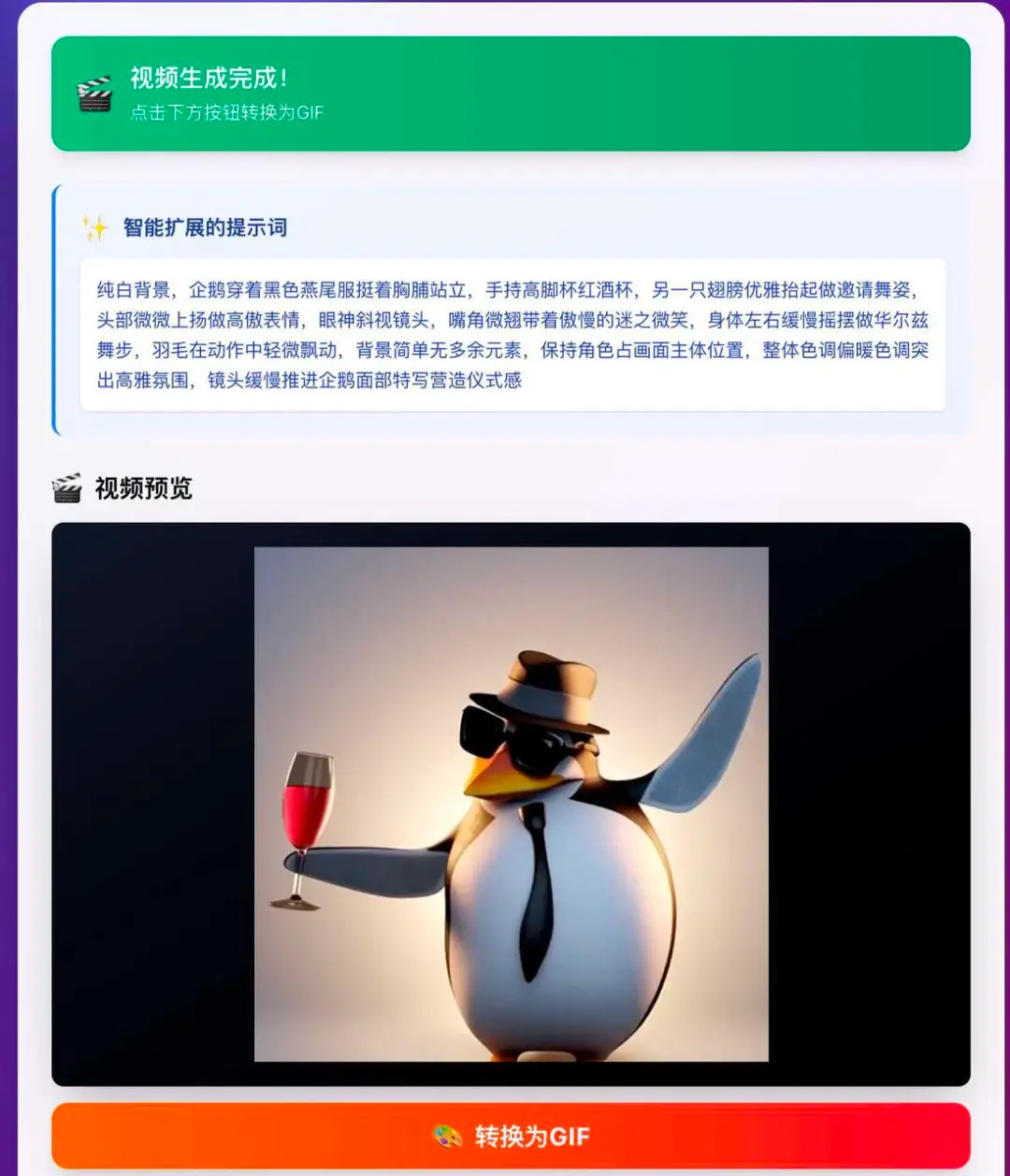

第一階段測試

手動測試結果,前端顯示操作,APIN 能夠正常調用模型,各項設計功能也符合預期。可能是 GMI Cloud 底層搭載的是 H100/H200,視頻的生成速度也比預期的要快的多。

視頻生成效果預覽

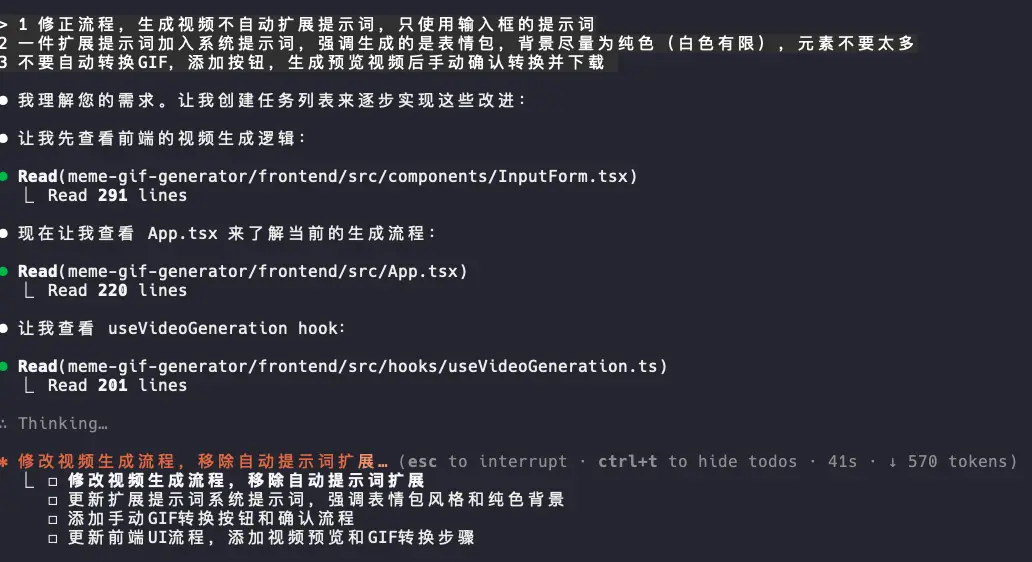

3、第二階段開發

然後進入第二階段開發。我個人的習慣通常在每個 AI 應用開發中用二階開發模式,第一階段是實現基礎的設計功能,後端能運行,前端能看得過眼,就是達到“能用”的標準。

根據使用體驗進行第二輪調試

第二階段是根據第一階段的表現和暴露的問題,進行流程的改進和必要功能的的添加。

注意!階段≠對話輪數。很多功能和 bug 是需要多輪對話才能修復和實現的。

第二輪調試後結果

這是第二輪的調試後的結果,增加了直接視頻生成 gif 的功能,同時完善了提示詞擴展的多模型選擇功能。

同一 API 可選用多 LLM 模型

同一 API 支持多視頻生成模型

最終生成視頻和 gif 的效果預覽:

Part 3

結語

在實際的使用中,三個場景需要頻繁調用/切換不同模型:

產品驗證過程:通常需要開發人員或者客户針對同一功能和流程用不同的模型測試哪個效果更貼近真實需求。

需要多種類大模型的應用:和這次的熱梗生成 meme 一樣,真實的落地場景通常需要不同大模型(文本 LLM、語音生成、圖像生成、視頻生成)之間形成完善的工作流。

用户要求:要求支持不同廠家不同型號的模型,原因未知~

傳統的做法是,每使用一個模型,就到它的官網去拿一個 API,查看一遍使用文檔,然後針對不同模型開發接口,分別配置 API……

GMI Cloud 作為 MaaS 平台解決了模型選擇和 API 調用複雜繁瑣的問題,同時配合它簡潔明瞭的操作文檔和良好的配置體驗(上週剛更新了 UI),讓我可以輕鬆實現 All Model in ONE API 。

我可以在平台提供的模型廣場測試不同的模型的效果,完成產品和概念驗證;然後使用一個 API、一套接口調用多個模型,不僅是單純的的文本 LLM,還可以方便的在語音生成、圖像生成、視頻生成等多種類大模型間切換。

除了模型本身的選型和調用更方便快捷之外,通過單一平台調用模型還能保證性能和傳輸的穩定性,避免不同廠家規格不一致和網絡問題,也更容實現根據用量和功能後端切換模型的功能,節省開支。

GMI Cloud 支持的生圖模型

最後説一下這個應用的真實落地拓展——加入語音和圖片生成能力,製作一個海外電商商品自動推廣視頻和廣告製作神器,有興趣的同學自己嘗試一下。

GMI Cloud 支持的語音生成模型

最後歡迎加入“AI Coding 交流羣”,羣內分享交流 AI Coding 的經驗和問題,之後的活動也會在羣裏第一時間推送!

參考資料

[1] GMI Cloud: https://console.gmicloud.ai/?tab=maas

-- 完 --

關於 GMI Cloud

由 Google X 的 AI 專家與硅谷精英共同參與創立的 GMI Cloud 是一家領先的 AI Native Cloud 服務商,是全球六大 Reference Platform NVIDIA Cloud Partner 之一,擁有遍佈全球的數據中心,為企業 AI 應用提供最新、最優的 GPU 雲服務,為全球新創公司、研究機構和大型企業提供穩定安全、高效經濟的 AI 雲服務解決方案。

GMI Cloud 憑藉高穩定性的技術架構、強大的GPU供應鏈以及令人矚目的 GPU 產品陣容(如能夠精準平衡 AI 成本與效率的 H200、具有卓越性能的 GB200、GB300 以及未來所有全新上線的高性能芯片),確保企業客户在高度數據安全與計算效能的基礎上,高效低本地完成 AI 落地。此外,通過自研“Cluster Engine”、“Inference Engine”兩大平台,完成從算力原子化供給到業務級智算服務的全棧躍遷,全力構建下一代智能算力基座。

作為推動通用人工智能(AGI)未來發展的重要力量,GMI Cloud 持續在 AI 基礎設施領域引領創新。選擇 GMI Cloud,您不僅是選擇了先進的 GPU 雲服務,更是選擇了一個全方位的 AI 基礎設施合作伙伴。

如果您想要了解有關 GMI Cloud 的信息

請關注我們並建立聯繫