今天咱們來聊個超酷的功能:如何讓你的 n8n 工作流“長眼睛”和“長耳朵”? 🧐

很多朋友在用 n8n 搭建 AI 應用時,發現不論怎麼折騰,好像只能發文字。想發張圖片讓 AI 分析?或者發段語音讓 AI 聽聽?對不起,不支持。🚫

別急!今天這篇教程就手把手教你,如何利用 全模態(Multimodal) 大模型,讓你的 n8n 支持文本、圖片、音頻、視頻的上傳與多輪對話!

舉個栗子 🌰:

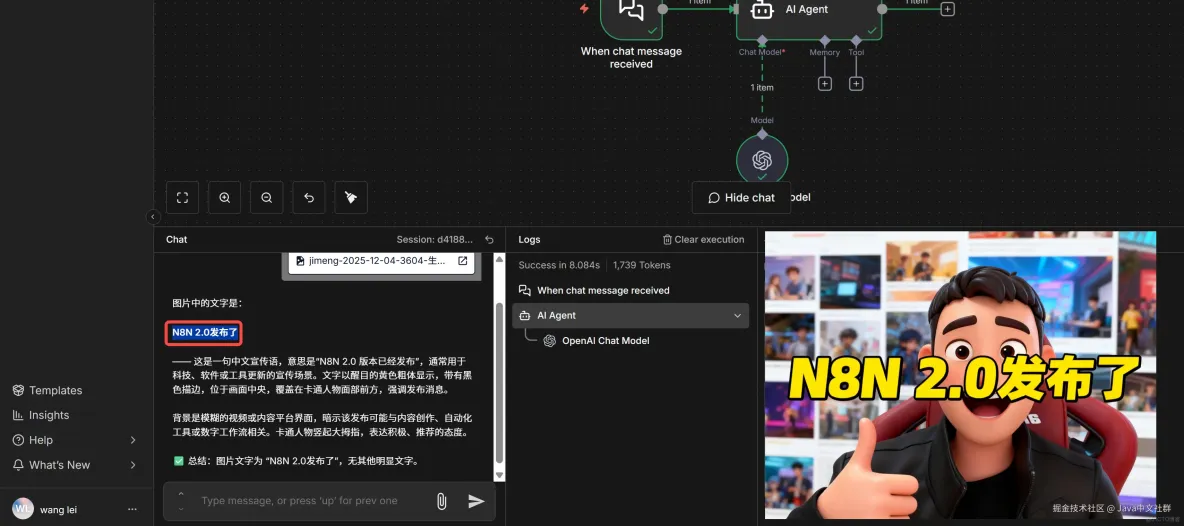

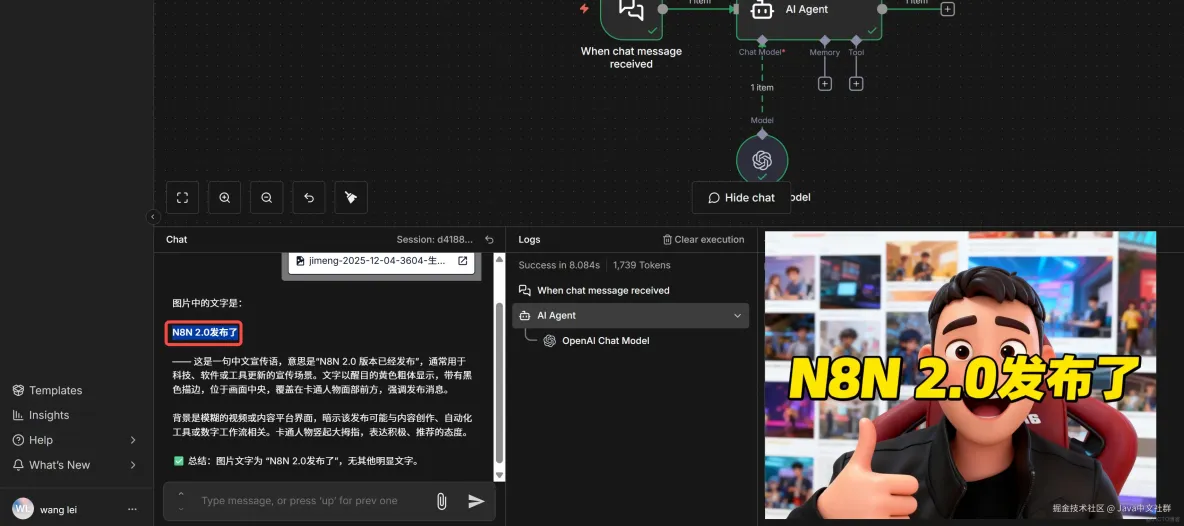

我給 AI 發一張海報圖,問它:“圖裏寫了啥?”

它立馬告訴我:“N8N 2.0 發佈了”

是不是很贊?只要掌握了這個方法,音視頻分析也統統不在話下!

廢話不多説,咱們直接上乾貨!👇

視頻演示

www.bilibili.com/video/BV1yn…

1️⃣ 打通“任督二脈”——開啓文件上傳 📂

首先,我們需要一個入口。

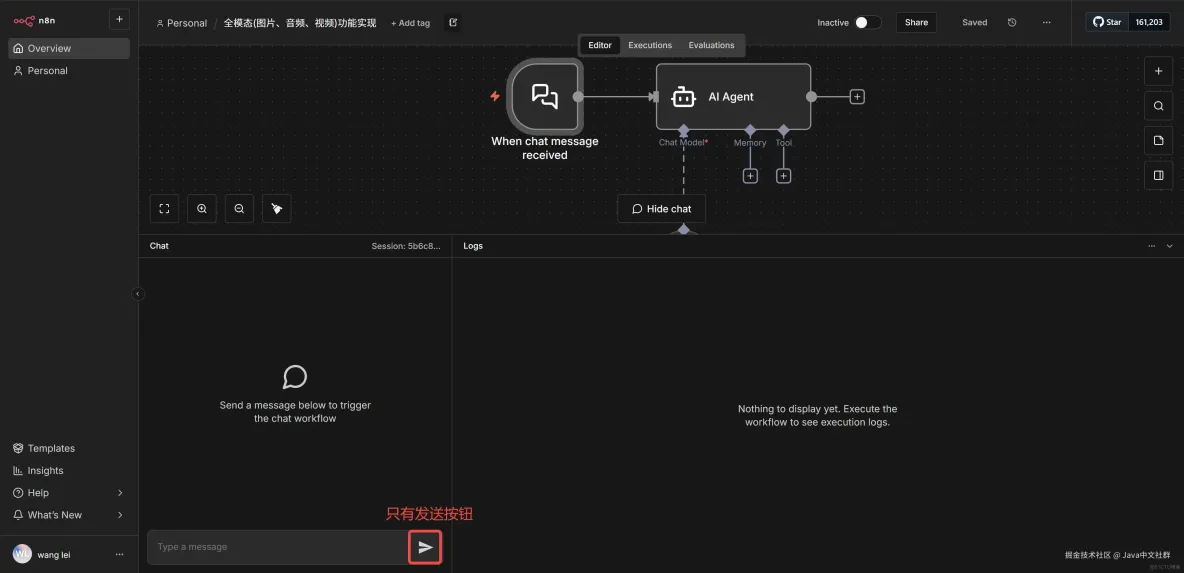

在 n8n 中添加 Chat Trigger(聊天觸發器)節點。

⚠️ 注意: 默認情況下,這個聊天窗口只有“發送”按鈕,是不支持上傳附件的。

怎麼破?

在 Chat Trigger 的設置裏,找到 Allow File Uploads(允許上傳文件)選項,把它打開!✅

設置好後,你會發現你的聊天窗口多了一個回形針圖標 📎(或者上傳按鈕)。這就意味着,你的通道已經打通了,可以接受圖片、音頻和視頻啦!

2️⃣ 選擇“最強大腦”——配置 AI Agent 🧠

即使通道通了,如果你的大模型是個“臉盲”或者“聽不懂”,那也沒用。所以,我們需要一個支持全模態的大模型。

在 n8n 流程中:

- 下一步添加節點: 這裏一定要選 AI Agent!

- 敲黑板:千萬別選 Basic LLM Chain,那個通常只支持純文本,不支持多模態操作。🙅♂️

- 設置 Model: 在 AI Agent 裏,我們需要配置一個 Chat Model(聊天模型)。

3️⃣ 核心秘技——接入 Qwen-Omni (通義千問) 🔗

我們要選哪個模型呢?這就得用到阿里的百鍊平台了。

- ❌ DeepSeek:雖然很火,但目前 API 主要側重文本和推理,全模態支持不是它的強項。

- ✅ Qwen-Omni:這是阿里最新的全模態大模型,能看圖、聽音、看視頻,選它準沒錯!

關鍵操作來了(必看): 🛠️

因為 n8n 原生可能沒有直接的“百鍊”節點,或者為了通用性,我們這裏使用 OpenAI Chat Model 節點來“偽裝”接入。因為百鍊平台完美兼容 OpenAI 的協議!

操作步驟:

- 添加憑證 (Credentials):

- 去阿里雲百鍊平台,註冊並登錄。

- 在“API-KEY管理”裏創建一個新的 Key,複製下來。

- 在 n8n 的 OpenAI 憑證裏,把這個 Key 填進去。

- 修改 Base URL:

- 在百鍊的模型廣場找到 Qwen-Omni,點擊“API參考”。

- 複製那個 Base URL 地址。

- 粘貼到 n8n 憑證設置裏的 Base URL 欄目中。

- 連接測試: 點擊 Save/Test,看到綠色小對勾 ✅ 就説明連接成功!

4️⃣ 實戰演練——見證奇蹟的時刻 ✨

連接成功後,回到 n8n 的 OpenAI Model 節點:

- 在模型列表(或者手動輸入)裏選擇 qwen-omni-turbo (或者日期後綴的最新版,如 12 月份的版本)。

- 關閉雜項: 那些聯網搜索、文件搜索的高級功能這次用不上,統統關掉,我們只測多模態。

測試開始! 🚀

- 打開聊天窗口。

- 上傳一張包含文字的圖片(比如 n8n 2.0 的海報)。

- 輸入指令:“提取圖片中的文字”。

- 點擊發送!

結果展示:

大模型迅速識別並回復:“這張圖片顯示的是 n8n 2.0 發佈了。”

我核對了一下原圖,完全相符! 💯

📝 總結

想要實現 n8n 全模態,必須滿足兩個條件,缺一不可:

- 入口支持:Chat Trigger 開啓文件上傳。

- 模型支持:後端必須連接支持全模態的模型(如 Qwen-Omni)。

搞定這兩步,你的 n8n 就不再是隻會打字的機器人,而是能看能聽的超級助手了!視頻和音頻的原理是一樣的,大家課後可以自己去試一試。

好啦,今天的教程就到這裏。我是磊哥,咱們下期再見! 👋