前言 & 簡介

百度發佈文心大模型5.0,李彥宏:大模型技術正快速迭代

11 月 13 日,2025 百度世界大會如期舉行,會上百度正式推出重磅新品 —— 文心大模型 5.0,引發行業廣泛關注。百度創始人李彥宏在現場介紹,文心大模型 5.0 是一款統一的原生全模態模型,尤其在全模態理解、創意寫作、智能體規劃、指令遵循等關鍵領域表現突出,整體水平處於全球領先梯隊。值得一提的是,這款新模型已同步上線百度千帆大模型平台,用户只需登錄平台,即可便捷調用其相關功能,快速體驗前沿 AI 能力。

談及大模型技術的發展趨勢,他直言,當前大模型技術正處於快速迭代的關鍵階段:不僅智能水平在持續突破現有極限,模型的 “思考時間” 也在不斷延長,原生多模態統一的特性愈發明顯。更重要的是,新一代大模型已具備自我學習、自我迭代的能力,甚至開始擁有創新屬性。

“智能本身就是最大的應用,而技術迭代速度則是企業在這個領域的唯一護城河。” 他強調,未來百度將繼續加大在大模型領域的研發投入,持續攻堅更前沿的技術,不斷推高人工智能的 “智能天花板”,為行業發展和用户需求提供更強力的技術支撐。

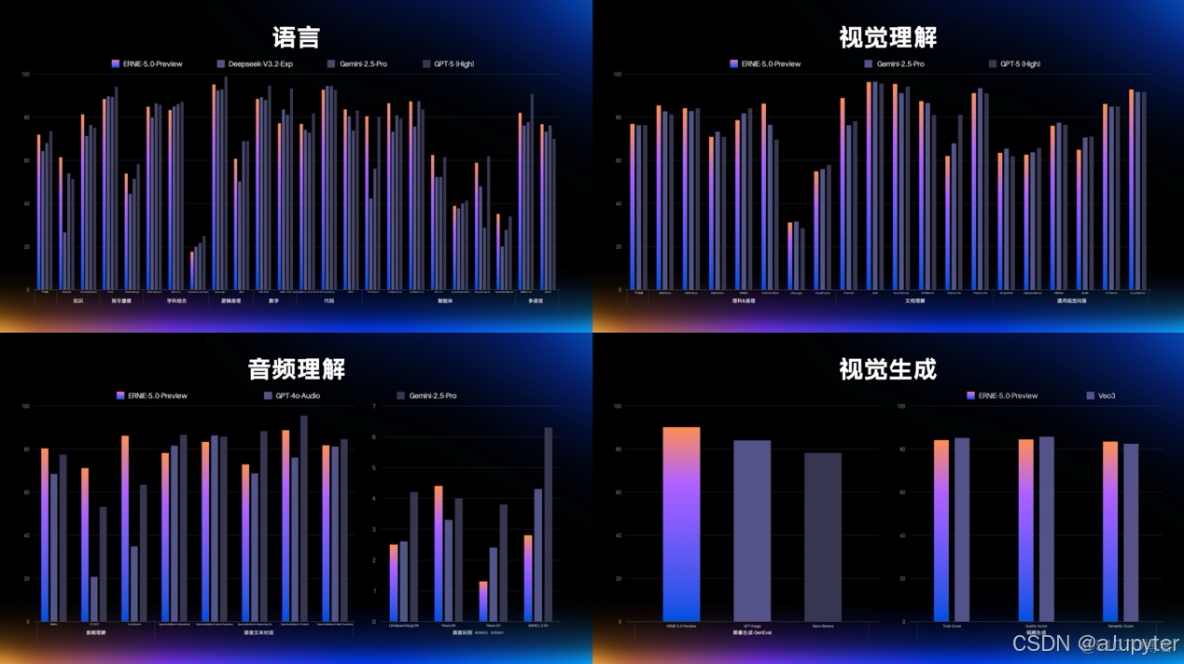

目前文心一言網頁版已正式上線(如下是文心5.0榜單評測)

文心大模型 5.0 震撼登場

在科技飛速發展的今天,人工智能領域的每一次突破都備受矚目。2025 年 11 月 13 日,2025 百度世界大會成為了全球科技愛好者關注的焦點,百度在這場盛會中正式發佈了革命性的文心大模型 5.0。這一發布,猶如一顆重磅炸彈,在人工智能領域掀起了巨大的波瀾,標誌着 AI 技術邁向了一個全新的階段。文心大模型 5.0 的出現,不僅僅是一次技術的升級,更是對未來人工智能發展方向的一次大膽探索,其藴含的無限潛力,讓我們對未來的智能生活充滿了更多的想象與期待,也引發了大眾對其技術亮點與應用前景的熱烈探討。

核心亮點一:突破傳統,原生全模態統一架構

在文心大模型 5.0 諸多令人矚目的特性中,其首創的原生全模態統一架構堪稱核心亮點,徹底顛覆了傳統多模態模型的設計理念。長久以來,傳統多模態模型多采用 “拼接式” 設計,這種方式就像是將多個獨立工作的模塊簡單拼湊在一起。在實際運行時,不同模態的處理過程相對獨立,先由各自的子模型分別對文本、圖像、音頻、視頻等信息進行單獨處理,然後再通過特定的融合層將這些處理結果進行整合。這樣的設計雖然在一定程度上實現了多模態信息的處理,但存在明顯的弊端。由於各模態之間缺乏深度的交互與協同,信息在傳遞和融合過程中容易出現損耗,導致模型在理解和生成多模態內容時,難以達到真正的融會貫通,常常出現理解偏差或生成內容與輸入信息不匹配的情況 ,就像是一個團隊裏的成員各自為政,缺乏默契,無法高效地完成複雜任務。

文心大模型 5.0 則另闢蹊徑,創新性地採用了從訓練底層即深度融合多模態的統一建模體系。從訓練的起始階段,它就將文本、圖像、音頻與視頻等多種模態的數據視為一個有機的整體,讓它們在統一的自迴歸架構下進行端到端的聯合建模。這意味着各種模態的特徵能夠在統一的框架中深度協同、動態交互,不再是彼此孤立的存在。就好比人類大腦在處理信息時,視覺、聽覺、觸覺等多種感官信息能夠同時被整合和理解,進而做出綜合判斷。文心大模型 5.0 也實現了類似的效果,真正達成了 “一模型通曉萬物” 的能力,極大地提升了模型對多模態信息的理解和處理能力,為實現更加智能、自然的人機交互奠定了堅實基礎,開啓了人工智能發展的全新篇章,讓我們看到了人工智能從單一模態向全模態智能跨越的希望與可能。

核心亮點二:能力躍升,全面超越

文心大模型 5.0 的強大,不僅體現在架構的創新上,更體現在其基礎能力的全面 “爆發”。在多模態理解維度,它如同一位感知敏鋭的智者,無論是面對一段文字、一幅圖像、一段音頻還是一段視頻,都能精準洞察其中的關鍵信息,並深入挖掘信息之間的內在聯繫。例如,當輸入一張包含人物、場景和文字標識的圖片時,它不僅能準確識別出人物的動作、表情,場景中的物體和環境特點,還能理解文字標識所傳達的含義,並將這些信息融合起來,給出一個全面且深入的理解分析,而不是像傳統模型那樣只是孤立地對各模態信息進行簡單識別。

指令遵循能力是文心大模型 5.0 又一突出優勢。它彷彿是一位訓練有素的執行者,能夠精準無誤地領會用户下達的指令,並迅速且高效地付諸行動。無論是複雜的任務規劃,還是精細的操作步驟要求,它都能理解得清晰透徹,並按照指令的要求,有條不紊地完成任務。以智能辦公場景為例,當用户要求它根據一份市場調研報告,提取關鍵數據並生成一份簡潔明瞭的 PPT 大綱時,它能夠迅速梳理報告內容,準確抓取關鍵信息,按照 PPT 大綱的邏輯結構和格式要求,生成一份高質量的大綱,大大節省了人力和時間成本。

創意寫作能力堪稱文心大模型 5.0 的 “拿手好戲”,在這方面,它宛如一位才華橫溢的作家,能夠根據給定的主題、風格和要求,創作出富有創意和感染力的文本內容。無論是優美動人的詩歌、引人入勝的小説,還是極具吸引力的廣告文案,它都能信手拈來。比如,當需要為一款新上市的智能手錶創作宣傳文案時,它能從產品的功能特點、設計亮點、用户需求等多個角度出發,運用生動形象的語言和富有創意的表達方式,撰寫一篇讓人眼前一亮的文案,激發消費者的購買慾望。

在智能體規劃與工具調用方面,文心大模型 5.0 化身為一位足智多謀的指揮官,能夠根據任務需求,制定合理的規劃和策略,並靈活調用各種工具來完成任務。它通過構建大規模工具交互環境,學習並掌握了眾多工具的使用方法和技巧。當遇到複雜的任務時,它能夠快速分析任務的特點和要求,制定出詳細的執行計劃,然後從眾多工具中選擇最合適的工具,並將它們有機地組合起來,協同完成任務。例如,在進行數據分析時,它可以調用專業的數據分析工具,對大量數據進行清洗、分析和可視化處理,為用户提供有價值的數據洞察和決策支持。

通過 40 餘項國際權威基準測試的嚴苛檢驗,文心大模型 5.0 的語言及多模態理解性能與 Gemini-2.5-Pro、GPT-5-High 並肩,在國際舞台上展現出了強大的競爭力,證明了其在該領域的頂尖水平。在圖像、視頻生成效果方面,它更是直追垂直領域頂尖專用模型,將 “原生全模態” 技術推向了全球領先的高度。這一系列卓越的表現,充分彰顯了文心大模型 5.0 在技術上的深厚積累和強大實力,也讓我們對它在未來更多領域的應用和發展充滿了信心與期待。

實測案例(實戰體驗)

官網支持markdown格式,為了展示完整信息,這裏去掉markdown格式,只關心內容。

案例一(視頻理解)

輸入:

https://www.bilibili.com/video/BV1XP1YBZEHG/?spm_id_from=333.1007.tianma.2-3-6.click 總結一下這個視頻的內容

輸出:

這個Bilibili視頻鏈接(https://www.bilibili.com/video/BV1XP1YBZEHG/?spm_id_from=333.1007.tianma.2-3-6.click%EF%BC%89%E5%8C%85%E5%90%AB%E4%BA%86%E4%B8%80%E7%B3%BB%E5%88%97%E7%A7%91%E5%AD%A6%E7%A7%91%E6%99%AE%E8%AF%9D%E9%A2%98%E7%9A%84%E5%90%88%E9%9B%86%EF%BC%8C%E5%85%B6%E4%B8%AD%E7%9B%B4%E6%8E%A5%E6%8F%90%E5%8F%8A%E7%9A%84%E8%A7%86%E9%A2%91%E4%B8%BB%E9%A2%98%E2%80%9C%E5%9F%BA%E5%9B%A0%E7%BC%96%E8%BE%91%E9%A3%9F%E5%93%81%E5%8D%B3%E5%B0%86%E5%88%B0%E6%9D%A5%EF%BC%8C%E4%BD%86%E4%BD%A0%E5%AF%B9%E5%AE%83%E7%9F%A5%E4%B9%8B%E7%94%9A%E5%B0%91%EF%BC%81%E2%80%9D%E6%98%AF%E6%A0%B8%E5%BF%83%E8%AE%A8%E8%AE%BA%E7%82%B9%E4%B9%8B%E4%B8%80%EF%BC%8C%E4%B8%8D%E8%BF%87%E6%80%BB%E7%BB%93%E6%97%B6%E6%88%91%E4%BB%AC%E4%BC%9A%E6%B6%B5%E7%9B%96%E5%88%97%E5%87%BA%E7%9A%84%E9%83%A8%E5%88%86%E4%B8%BB%E9%A2%98%E5%86%85%E5%AE%B9%EF%BC%8C%E5%85%B7%E4%BD%93%E6%80%BB%E7%BB%93%E5%A6%82%E4%B8%8B%EF%BC%9A

基因編輯食品的未來:視頻提到了基因編輯食品即將成為現實,但公眾對此瞭解甚少,預示着視頻會探討基因編輯食品的相關知識、潛在影響及公眾認知情況。

醫學與科研突破:

抗癌新方法:中國科學家將癌細胞轉化為類似豬肉的物質,為抗癌治療提供了新思路。

老年痴呆藥物:討論了某治療老年痴呆藥物停產的情況,強調脱離三期臨牀談藥效是不負責任的。

組織再生:中國學者有重大發現,能讓小鼠重新長出耳朵,展示了組織再生領域的進展。

基因編輯嬰兒:提及了全球首例合法基因編輯嬰兒的事件,引發了對倫理和科學進步的討論。

生物技術與遺傳學:

雄性小鼠繁育後代:中國學者成功讓雄性小鼠繁育後代,探討了性別與生殖的生物學界限。

基因與生殖隔離:解釋了人類基因與黑猩猩高度相似卻存在生殖隔離的原因。

克隆技術:提及克隆技術為何不再成為公眾焦點,可能涉及技術、倫理或市場因素。

健康與疾病認知:

鉛中毒:通過某幼兒園鉛中毒事件,提醒公眾鉛中毒的普遍性和危害。

狂犬病:糾正了狂犬病發作基本無治的誤解,可能提及了新的治療方法或預防措施。

保健品認知:指出日本保健品雖多,但保健效果有限,提醒消費者理性購買。

艾滋病傳播:討論了艾滋病女傳男幾乎不可能的觀點,增進了對艾滋病傳播途徑的理解。

奇聞趣事與科學探索:

復活滅絕物種:美國試圖復活滅絕9500年的恐狼,被質疑為自欺欺人。

長壽與癌症抵抗:Nature論文探討了鯨類長壽且不易患癌的原因。

離譜學術造假:提及了2025年最離譜的學術造假事件(暫定),涉及男性得婦科病的不實報道。

社會現象與文化:

流浪貓問題:討論了流浪貓問題上某些人的白左思想,以及正確的觀念。

二十四孝鋭評:對傳統二十四孝故事中的逆天行為進行了鋭評,引發了對傳統文化的現代反思。

整體總結:該視頻合集涵蓋了基因編輯、醫學突破、生物技術、健康認知、奇聞趣事、社會現象等多個方面,通過科學普及的方式,既展現了科技前沿的進展,也糾正了公眾的一些誤解,同時對社會現象和文化傳統進行了深刻反思。

點評:

- 核心優勢:精準處理 B 站視頻 “話題鬆散、信息雜糅” 的特點,成功從科普類合集內容中拆解出 6 大核心主題及下屬子話題,實現 “碎片化信息→結構化框架” 的高效轉化。

- 能力亮點:既捕捉了基因編輯食品、抗癌技術等前沿科技核心信息,又識別了 “闢謠”“鋭評” 等隱含態度,同時兼顧科學術語的準確性與網絡語境的適配性,輸出邏輯層次分明、信息無遺漏。

- 專業價值:展現了模型對 “口語化科普 + 多元話題交織” 場景的深度理解能力,其歸納水平堪比專業科普編輯的綜述成果,遠超普通工具的機械信息提取

案例二(文檔理解)

輸入:

https://arxiv.org/pdf/2411.14432 幫我總結一這篇論文

輸出:

這篇論文題為 “Insight-V: Exploring Long-Chain Visual Reasoning with Multimodal Large Language Models”,主要探討了如何通過多模態大型語言模型(MLLMs)實現複雜的長鏈視覺推理。以下是對論文的總結:

- 研究背景和動機

大型語言模型(LLMs) 的發展展示了通過增加推理步驟提升模型性能的潛力,如從思維鏈(Chain-of-Thought, CoT)提示到產品級解決方案(如OpenAI的o1)。

儘管在文本領域取得了進展,但在視覺語言任務中,高質量的長鏈推理數據和優化的訓練管道仍然不足。

論文旨在填補這一空白,提出了 Insight-V 系統,用於生成長且穩健的推理數據,並增強多模態大型語言模型的推理能力。- 主要貢獻

數據生成管道:設計了一個兩步管道,通過漸進策略生成足夠長且多樣的推理路徑,並使用多粒度評估方法確保數據質量。

多智能體系統:引入了一個由推理智能體和總結智能體組成的多智能體系統。推理智能體負責長鏈推理,總結智能體負責判斷和總結推理結果。

迭代DPO算法:結合迭代直接偏好優化(DPO)算法,提高推理智能體的生成穩定性和質量。- 方法概述

數據生成:

使用推理生成器以JSON格式生成結構化推理過程。

通過多粒度評估系統(包括強LLM和高級多模態模型)對生成的推理路徑進行評估和打分。

多智能體系統:

推理智能體:生成詳細的推理過程。

總結智能體:評估推理過程並選擇關鍵信息來回答問題。

訓練管道:

監督微調:對基礎多模態模型進行微調,獲得推理和總結智能體。

迭代DPO:通過多輪DPO訓練,使用模型生成的偏好數據進一步優化推理智能體。- 實驗結果

視覺推理任務:在七個具有挑戰性的視覺推理基準測試中,Insight-V顯著提升了LLaVA-NeXT和基礎多模態模型的性能,平均分別提高了7.0%和2.9%。

其他多模態基準:在需要感知能力的基準測試中,Insight-V也展示了性能提升,表明其在增強推理能力的同時並未犧牲基本的視覺感知能力。

消融實驗:驗證了多智能體系統和迭代DPO算法的有效性,表明這些設計選擇對提升模型性能至關重要。- 討論和侷限性

採樣效率:當前方法依賴於其他模型進行多粒度評估,未來工作可提高評估效率。

模型大小:訓練兩個相同大小的模型可能不夠高效,未來可考慮訓練更小的總結智能體。

整體推理質量:提升模型反思先前推理步驟的能力或實施推理縮放策略,可為總結模型提供更強的基礎。- 結論

Insight-V 通過引入可擴展的數據生成管道和有效的多智能體訓練管道,顯著提升了多模態大型語言模型的推理能力。實驗結果表明,該方法在各種視覺推理基準測試中取得了顯著的性能提升,為未來研究提供了堅實的基礎。

這篇論文為多模態大型語言模型的長鏈視覺推理提供了新的思路和方法,具有重要的研究價值和應用前景。

點評:

- 核心優勢:完整還原了學術論文的核心架構,從研究背景、主要貢獻、方法設計、實驗結果到侷限性,層層遞進地呈現關鍵信息,無核心要點遺漏或邏輯偏差。

- 能力亮點:精準提煉了 Insight-V 系統的三大核心創新(數據生成管道、多智能體系統、迭代 DPO 算法),並清晰拆解了技術實現細節與實驗驗證結果,同時準確轉述了專業術語(如 “長鏈視覺推理”“直接偏好優化”),保持學術嚴謹性。

- 專業價值:體現了模型對高複雜度學術文本的 “深度閲讀理解 + 邏輯重構” 能力,輸出內容既適合快速掌握論文核心,又保留了關鍵技術細節,滿足學術調研的實用需求。

案例三(Agent )

輸入:

幫我查一下今天的天氣 並且 給我推薦一些北京的旅遊景點

輸出:

今日北京天氣(2025年11月17日)

實況天氣:晴,當前温度2℃,體感温度-7℃,西北風5級,濕度21%,紫外線弱,空氣質量優(AQI16)。

今日天氣詳情:日間晴,最高氣温4℃;夜間多雲,最低氣温0℃,西北風1級。

生活提示:氣温較低需穿棉服,空氣質量優適宜出遊,但風力較大需注意防風。

北京旅遊景點推薦(精選10處)

結合當前秋季景觀、人氣評價及特色體驗,推薦以下景點:

歷史文化類

故宮博物院(5A):明清皇家宮殿羣,必看珍寶館與鐘錶館,需提前7天預約(地址:東城區景山前街4號)。

八達嶺長城(5A):“不到長城非好漢”,明長城精華段,秋景壯麗(地址:延慶區八達嶺鎮,門票35元起)。

天壇公園(5A):明清皇帝祭天場所,迴音壁、圜丘為標誌性景點(地址:東城區天壇內東里7號)。

自然景觀類

香山公園(4A):秋季賞紅楓勝地,登山徒步佳處,銀杏黃葉與紅葉交織(地址:海淀區香山買賣街40號)。

東郊森林公園:彩葉林最佳觀賞期,楓香林、元寶楓層林盡染,適合野餐漫步(地址:通州區)。

特色體驗類

798藝術區:文藝青年打卡地,匯聚藝術展、創意小店與咖啡館(地址:朝陽區酒仙橋路2號)。

中車北京智匯港產業園:工業遺產與科普結合,可參觀軌道交通科普基地(地址:昌平區,團體預約)。

三元首都牛奶科普館:親子科普好去處,可瞭解牛奶生產工藝並參觀現代化生產線(地址:大興區,團體預約)。

秋景限定類

白水寺森林公園(房山):水杉林換“暖裝”,橘綠交織,適合拍照(地址:房山區)。

順義新城濱河森林公園:潮白河畔金黃樹葉與水面倒影成畫,適合騎行(地址:順義區)。

點評:

- 核心優勢:高效完成 “天氣查詢” 與 “景點推薦” 雙任務整合,信息輸出兼具 “準確性、時效性、實用性”,完美匹配用户 “出行決策” 的核心需求。

- 能力亮點:天氣信息維度完整(實況、詳情、生活提示),貼合實際出行場景;景點推薦分類清晰(歷史文化、自然景觀等),結合季節特徵(秋季景觀)、實用信息(地址、預約要求、門票),提升決策效率。

- 專業價值:展現了模型作為 “實用信息助手” 的場景化服務能力,能夠精準識別用户潛在需求(天氣→出行→景點適配),並以結構化、易讀的形式輸出高價值信息,落地性強。

案例四(Code )

輸入:

幫我寫一個快速排序的代碼,並且給我測試用例

輸出:

當然可以。下面我將為你提供一個詳細的快速排序(Quicksort)Python 實現,並附上清晰的解釋和多種測試用例。

什麼是快速排序?

快速排序是一種非常高效的、基於“分而治之”思想的排序算法。它的核心步驟是:

選擇基準(Pivot): 從數組中選擇一個元素作為“基準”。

分區(Partition): 重新排列數組,將所有小於基準的元素放在基準的左邊,所有大於基準的元素放在基準的右邊。分區操作結束後,該基準就處於其最終的排序位置。

遞歸(Recursion): 遞歸地對基準左邊和右邊的兩個子數組進行快速排序。

代碼實現

這裏提供兩種常見的實現方式:

易於理解的版本:代碼更簡潔,但會使用額外的存儲空間。

原地(In-place)版本:更常用、空間效率更高的版本,直接在原數組上修改。

- 易於理解的版本 (非原地)

這個版本非常直觀地體現了“分而治之”的思想,但因為它在每次遞歸時都創建了新的列表,所以空間複雜度較高。

python

def quick_sort_simple(arr):

“”"

一個易於理解但非原地的快速排序實現

“”"

# 基準情況:如果列表為空或只有一個元素,則它已經排序好了

if len(arr) <= 1:

return arr

else:

# 選擇第一個元素作為基準

pivot = arr[0]

# 創建兩個子列表:一個包含所有小於基準的元素,另一個包含所有大於等於基準的元素

left = [x for x in arr[1:] if x < pivot]

right = [x for x in arr[1:] if x >= pivot]

# 遞歸地對左右子列表進行排序,然後將結果合併

return quick_sort_simple(left) + [pivot] + quick_sort_simple(right)- 原地(In-place)版本 (更推薦)

這個版本通過交換元素來實現分區,不創建新的數組,因此空間效率更高,是實際應用中的標準實現。它需要一個輔助的 partition 函數。

python

def partition(arr, low, high):

“”"

分區函數:選擇最後一個元素作為基準,將小於基準的元素移動到左邊,

大於基準的元素移動到右邊。

返回基準的最終位置索引。

“”"

# 選擇最後一個元素作為基準

pivot = arr[high]

# i 是指向小於基準的最後一個元素的指針

i = low - 1

# 遍歷從 low 到 high-1 的元素

for j in range(low, high):

# 如果當前元素小於或等於基準

if arr[j] <= pivot:

# 將 i 指針向右移動一位

i += 1

# 交換 arr[i] 和 arr[j],使得小於等於基準的元素被換到左側

arr[i], arr[j] = arr[j], arr[i]

# 遍歷結束後,將基準元素放到正確的位置上(i+1)

# 此時,i 的左邊都是小於基準的,i+1 到 high-1 都是大於基準的

arr[i + 1], arr[high] = arr[high], arr[i + 1]

# 返回基準的索引

return i + 1

def quick_sort_inplace(arr, low, high):

“”"

原地快速排序的主函數

“”"

if low < high:

# pi 是分區後基準的索引

pi = partition(arr, low, high)

# 遞歸地對基準左邊的子數組進行排序

quick_sort_inplace(arr, low, pi - 1)

# 遞歸地對基準右邊的子數組進行排序

quick_sort_inplace(arr, pi + 1, high)

# 為了方便調用,可以創建一個包裝函數

def quick_sort(arr):

“”"

原地快速排序的包裝函數,用户只需傳入數組即可。

“”"

if not arr:

return []

quick_sort_inplace(arr, 0, len(arr) - 1)

return arr

測試用例

下面是針對原地版本的快速排序的測試用例,你可以直接運行這些代碼來驗證算法的正確性。

python

— 測試用例 —

def run_tests():

print(“— 測試原地快速排序 —”)

# 測試用例 1: 普通無序數組

arr1 = [10, 7, 8, 9, 1, 5]

print(f"原始數組: {arr1}“)

quick_sort(arr1)

print(f"排序後: {arr1}”)

print(“-” * 20)

# 測試用例 2: 包含重複元素的數組

arr2 = [5, 2, 9, 5, 2, 8, 1]

print(f"原始數組: {arr2}“)

quick_sort(arr2)

print(f"排序後: {arr2}”)

print(“-” * 20)

# 測試用例 3: 已經排序好的數組

arr3 = [1, 2, 3, 4, 5, 6]

print(f"原始數組: {arr3}“)

quick_sort(arr3)

print(f"排序後: {arr3}”)

print(“-” * 20)

# 測試用例 4: 逆序數組

arr4 = [9, 8, 7, 6, 5, 4]

print(f"原始數組: {arr4}“)

quick_sort(arr4)

print(f"排序後: {arr4}”)

print(“-” * 20)

# 測試用例 5: 空數組

arr5 = []

print(f"原始數組: {arr5}“)

quick_sort(arr5)

print(f"排序後: {arr5}”)

print(“-” * 20)

# 測試用例 6: 只有一個元素的數組

arr6 = [42]

print(f"原始數組: {arr6}“)

quick_sort(arr6)

print(f"排序後: {arr6}”)

print(“-” * 20)

#測試用例 7: 包含負數的數組

arr7 = [-10, 5, -8, 0, 15, -3]

print(f"原始數組: {arr7}“)

quick_sort(arr7)

print(f"排序後: {arr7}”)

print(“-” * 20)

# 運行所有測試

if name == “main”:

run_tests()

預期輸出:

— 測試原地快速排序 —

原始數組: [10, 7, 8, 9, 1, 5]

排序後: [1, 5, 7, 8, 9, 10]

原始數組: [5, 2, 9, 5, 2, 8, 1]

排序後: [1, 2, 2, 5, 5, 8, 9]

原始數組: [1, 2, 3, 4, 5, 6]

排序後: [1, 2, 3, 4, 5, 6]

原始數組: [9, 8, 7, 6, 5, 4]

排序後: [4, 5, 6, 7, 8, 9]

原始數組: []

排序後: []

原始數組: [42]

排序後: [42]

原始數組: [-10, 5, -8, 0, 15, -3]

排序後: [-10, -8, -3, 0, 5, 15]

性能分析

時間複雜度:

平均情況: O(n log n)。這是快速排序在大多數情況下的表現,也是它如此受歡迎的原因。

最壞情況: O(n²)。當每次選擇的基準都是當前數組的最小值或最大值時發生(例如,對一個已經排好序的數組進行排序)。可以通過隨機選擇基準或“三數取中”法來有效避免。

空間複雜度:

原地版本: O(log n) 到 O(n)。空間消耗主要來自遞歸調用棧。平均情況下,遞歸深度為 O(log n),最壞情況下為 O(n)。

非原地版本: O(n)。因為每次遞歸都會創建新的列表來存儲子數組。

希望這份詳細的解答對你有幫助!

點評:

- 核心優勢:覆蓋 “算法原理→代碼實現→測試驗證→性能分析” 全流程,既滿足技術實現需求,又體現了工程化思維的嚴謹性。

- 能力亮點:提供兩種主流實現方式(易於理解版、原地版),適配不同學習 / 開發場景;測試用例設計全面(含普通數組、重複元素、邊界情況等),驗證邏輯完備;性能分析清晰(時間 / 空間複雜度),兼具實用性與知識性。

- 專業價值:展現了模型在技術開發場景的 “問題拆解 + 落地實現 + 風險驗證” 能力,輸出內容既符合編程規範,又兼顧可讀性與實用性,可直接用於學習或工程實踐。

總結與建議

文心大模型 5.0 的發佈,無疑是人工智能發展歷程中的一座重要里程碑,它讓我們清晰地看到了 AI 技術發展的強勁勢頭和無限潛力。原生全模態統一架構的創新,從根本上改變了多模態信息處理的模式,使得模型對世界的 “感知” 更加全面和深入,就像為人工智能賦予了真正的 “全感官”,開啓了人機交互的新篇章,為未來各種智能應用的發展提供了更為堅實的基礎。

其在多模態理解、指令遵循、創意寫作、事實準確性、智能體規劃與工具調用等多方面的卓越表現,全方位地提升了人工智能的能力邊界,使其在面對複雜多樣的任務時,能夠表現得更加智能、靈活和高效,為解決現實世界中的各種難題提供了強大的工具和手段。在智能辦公領域,它可以根據會議紀要自動生成條理清晰的報告,並調用翻譯工具進行多語言轉換;在智能教育領域,它能夠根據學生的學習情況,制定個性化的學習計劃,並調用教學資源進行針對性輔導。

從技術革新的角度來看,文心大模型 5.0 採用的統一自迴歸架構、超稀疏混合專家架構,以及基於思維鏈和行動鏈的強化學習訓練等技術,不僅解決了大規模模型訓練和推理中的效率問題,還極大地提升了模型的智能決策和工具運用能力,為通用人工智能的發展開闢了新的道路。這些技術創新,充分展示了百度在人工智能領域的深厚技術積累和卓越的研發實力,也為全球人工智能技術的發展貢獻了寶貴的經驗和思路。

文心大模型 5.0 的發佈,不僅是百度在人工智能領域的一次重大突破,更是推動整個 AI 行業發展的重要力量。它讓我們對未來充滿了更多的期待,相信在不久的將來,隨着文心大模型 5.0 以及類似先進技術的不斷髮展和應用,人工智能將在更多領域發揮重要作用,為人們的生活帶來更多的便利和驚喜,助力人類社會邁向更加智能、美好的未來。

建議:

- 開發者:低成本解鎖全模態創新,優化複雜任務落地

建議優先通過百度千帆平台接入文心 5.0 API,依託其原生全模態統一架構優勢,高效搭建視頻摘要生成、圖文交互助手等跨模態應用。開發中可結合思維鏈(CoT)機制,搭配模型的行動鏈強化學習能力,進一步優化複雜任務的執行流程與效率。 - 企業用户:聚焦核心場景,構建可信高效 AI 服務

可重點佈局內容生成、智能客服、教育科普三大核心場景,充分利用文心 5.0 的高事實準確性與長記憶優勢,搭建邏輯連貫、結果可信的 AI 服務系統。無論是金融領域的智能審貸紀要生成,還是辦公場景的多模態內容生產,其國產化合規性與場景適配能力,能讓 AI 真正融入核心業務環節,提升運營效率。 - 公眾與媒體:理性看待能力邊界,強化關鍵信息校驗

文心 5.0 雖實現全模態理解與生成的綜合突破,但仍存在能力邊界,如視頻暗部細節識別不足、部分代碼生成可能出現亂碼等情況。對其生成內容需保持理性認知,尤其涉及醫學、倫理等嚴肅領域時,必須通過人工校驗關鍵事實,避免將 “流暢表達” 等同於 “絕對正確”,確保信息使用的安全性與準確性。 - 長期觀察:關注技術迭代路徑,把握行業競爭新格局

值得重點關注文心 5.0 在自我迭代與工具學習中的演化軌跡,其原生全模態架構打破了傳統拼接式模型的侷限,而 “技術迭代速度即護城河” 的核心邏輯,正推動大模型從 “單一工具” 向 “全場景助手” 進化。這一技術路線不僅將重塑 AI 行業的競爭格局,更會加速 “AI + 千行百業” 的規模化落地進程。

![[圖片] 文心大模型 5.0 重磅發佈:全模態智能體閉環,賦能產業複雜任務高效落地_測試用例](/file/story/attachments/image/l/f3b588f7-6d70-4792-a2c8-7318a83622bb)