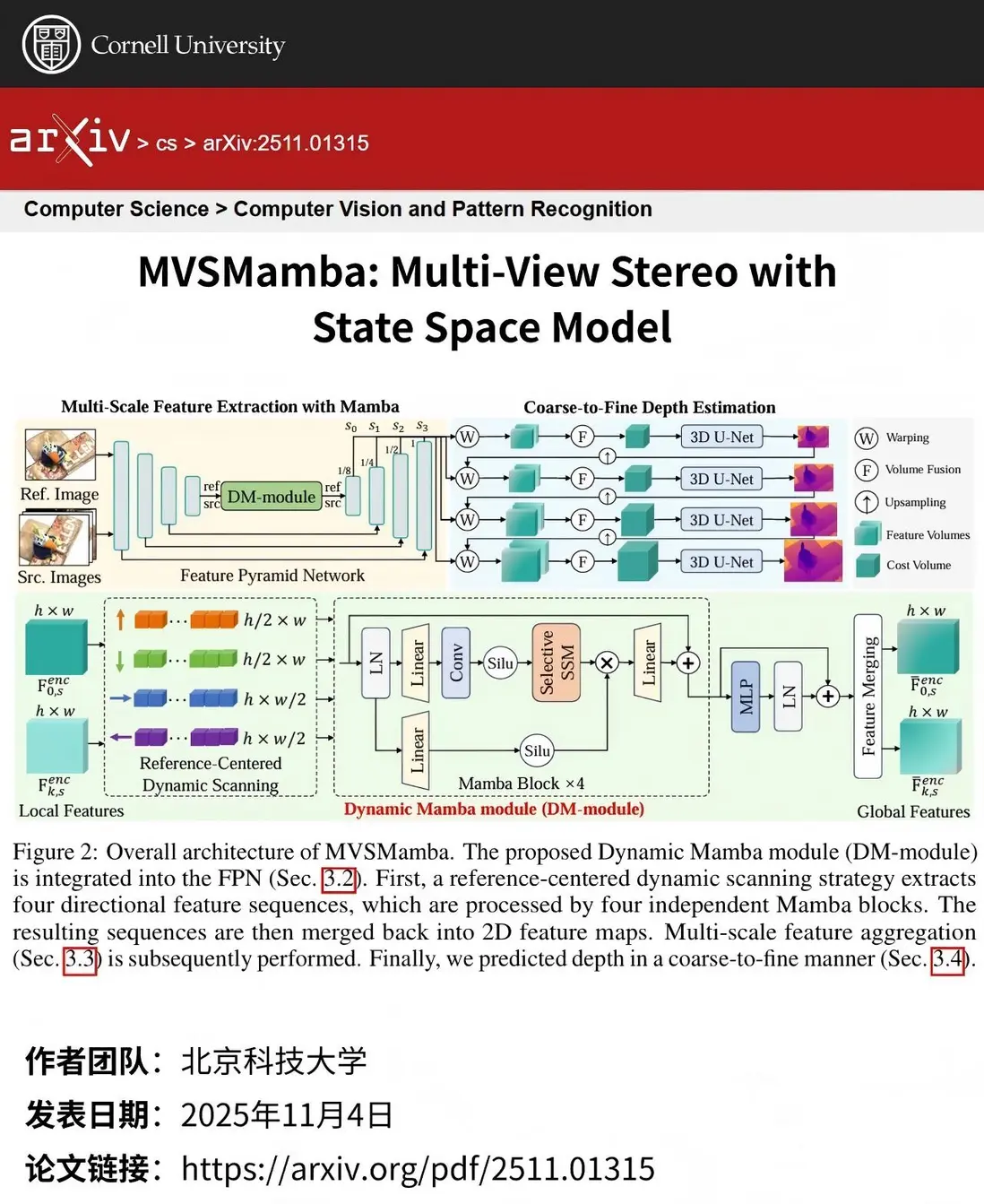

論文標題:MVSMamba: Multi-View Stereo with State Space Model

作者團隊:北京科技大學

發佈時間:2025年11月4日

👉一鍵直達論文

👉Lab4AI大模型實驗室論文閲讀

✅Lab4AI平台提供AI導讀和AI翻譯等工具,輔助論文閲讀。

⭐研究背景

基於學習的多視圖立體視覺方法嚴重依賴魯棒的特徵匹配。傳統CNN方法因感受野有限,難以捕捉全局特徵;而Transformer雖能建模長程依賴,但其二次計算複雜度嚴重製約了性能與效率的平衡。如何在保持高精度的同時降低計算開銷,成為當前MVS領域的關鍵挑戰。

⭐研究目標

本研究旨在解決Transformer在MVS中計算複雜度過高的問題。核心目標是提出一種基於Mamba(狀態空間模型)的全新MVS網絡MVSMamba,實現高效的全局特徵聚合。通過引入動態掃描策略,構建全方位、多尺度的特徵表示,在提升性能的同時顯著降低計算成本。

⭐研究方法

論文提出MVSMamba網絡,核心是動態Mamba模塊。該模塊採用參考視圖中心的動態掃描策略,將源特徵與參考特徵在四個方向拼接,通過Mamba塊進行線性複雜度的序列建模,實現高效的視圖內與視圖間全局交互。該方法在特徵金字塔網絡中進行多尺度特徵聚合,並以由粗到細的方式估計深度。

⭐研究結果

在DTU和Tanks-and-Temples基準測試上,MVSMamba達到了最先進的性能。特別是在DTU數據集上,其綜合排名和效率均優於現有CNN和Transformer方法。消融實驗驗證了動態掃描、多尺度聚合等關鍵設計的有效性,證明了該方法在保持極低內存和運行時開銷的同時,實現了優異的重建精度和泛化能力。