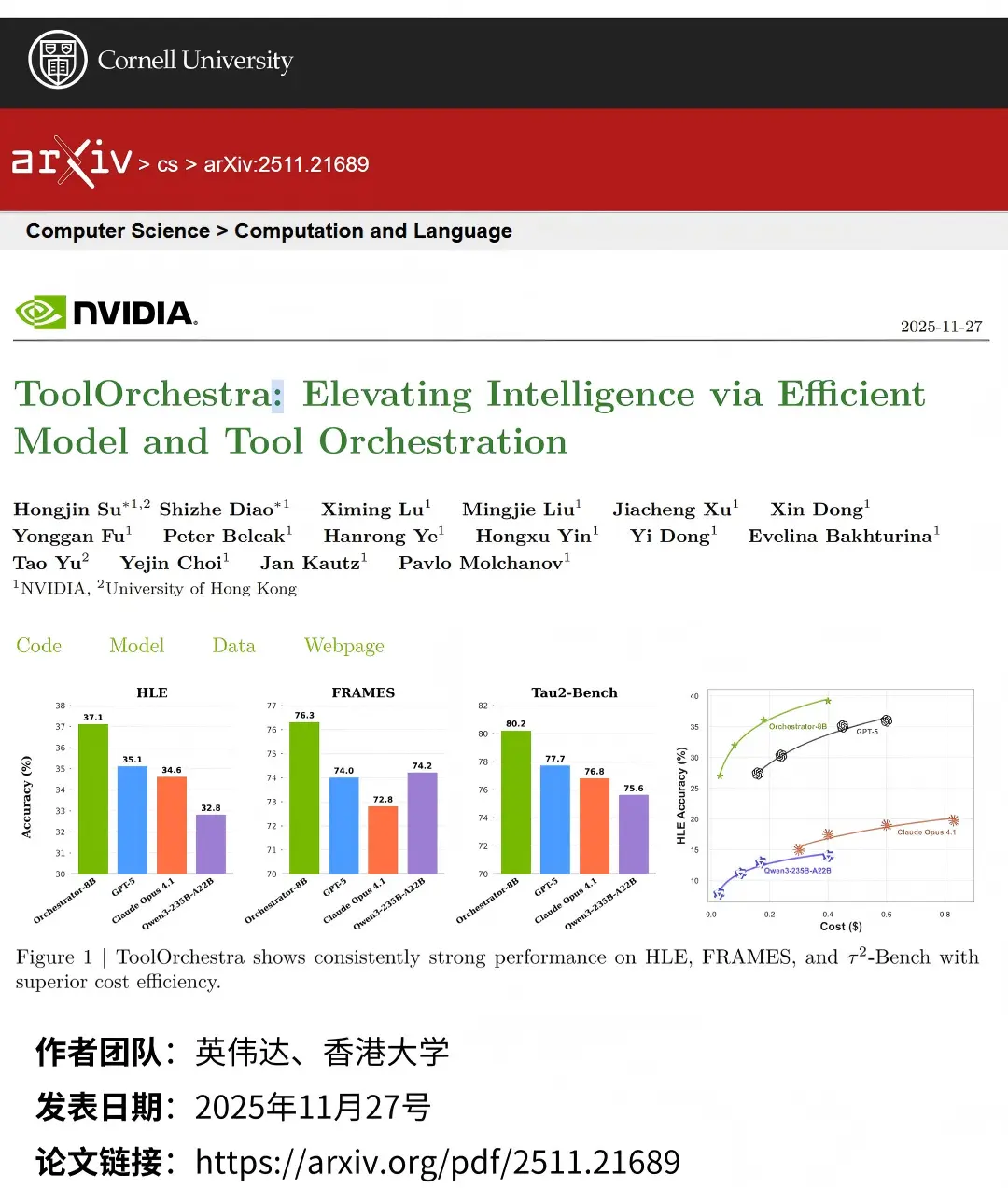

小模型驅動大智能:NVIDIA新研究實現2.5倍效率提升,成本直降70%

論文標題:ToolOrchestra: Elevating Intelligence via Efficient Model and Tool Orchestration

作者團隊:英偉達、香港大學

發佈時間:2025年11月27日

👉一鍵直達論文

👉Lab4AI大模型實驗室論文閲讀

⭐論文簡介

大語言模型在解決深度複雜問題時面臨計算成本高、推理能力不足的挑戰;現有工具代理多依賴單一強大模型,缺乏對“工具編排”的系統性優化,導致效率與成本難以平衡。

這篇論文解決的是,訓練一個小型語言模型(Orchestrator) 作為編排器,動態協調多種工具(基礎工具、專業LLMs、通用LLMs),通過強化學習優化任務完成效果。

⭐核心創新

論文核心是訓練一個小型語言模型作為“編排器”,通過強化學習讓小模型學會 “何時調用、調用什麼、如何組合” 工具,實現 “以小控大、降本增效”。

該方法將多工具任務建模為馬爾可夫決策過程,編排器通過“多輪滾動”交替執行“推理”和“工具調用”,逐步完成任務。

獎勵設計包含三重目標:結果正確性(任務是否解決)、效率(成本與延遲)、用户偏好(工具選擇傾向),引導模型平衡性能與成本,適配用户需求。

為支持訓練,論文還提出了ToolScale數據集,通過模擬工具環境與生成多樣化任務,解決端到端RL訓練的數據稀缺問題。

⭐論文的貢獻

- 提出“編排範式”,用小型模型協調工具實現“性能 - 成本”最優;

- 發佈ToolScale數據集,推動工具代理研究;

- 證明小型編排模型在複雜任務上可超越大模型,為低成本、可擴展的AI系統提供新思路。