混元視頻生成大模型

在當今人工智能技術飛速發展的時代背景下,視頻生成領域正不斷迎來新的變革與突破。2024 年 12 月 3 日,騰訊這一科技行業的領軍者做出了一項引人矚目的舉措 —— 宣佈旗下的混元視頻生成大模型(HunYuan-Video)對外開源,此舉無疑在業界掀起了軒然大波。

HunYuan-Video

HunYuan-Video

騰訊混元視頻生成模型 HunYuan-Video(HY-Video)是一款突破性的視頻生成模型,提供超寫實畫質質感,能夠在真實與虛擬之間自由切換。它打破了小幅度動態圖的限制,實現完整大幅度動作的流暢演繹。HY-Video 具備導演級的運鏡效果,具備業界少有的多視角鏡頭切換主體保持能力,藝術鏡頭無縫銜接,一鏡直出,展現出如夢似幻的視覺敍事。

以下是混元大模型的基本參數:

參數量:130 億,是當前最大的視頻開源模型。

輸入輸出:支持中英文雙語輸入,生成視頻支持多種視頻尺寸以及多種視頻清晰度。

生成能力:能生成 5 秒視頻,其生成的視頻遠景幅度大、動作流暢,在人文場景 / 人造場所、人、多主體組合這些類目上有較明顯優勢,在物品和動物 / 微生物類目也有一定優勢。

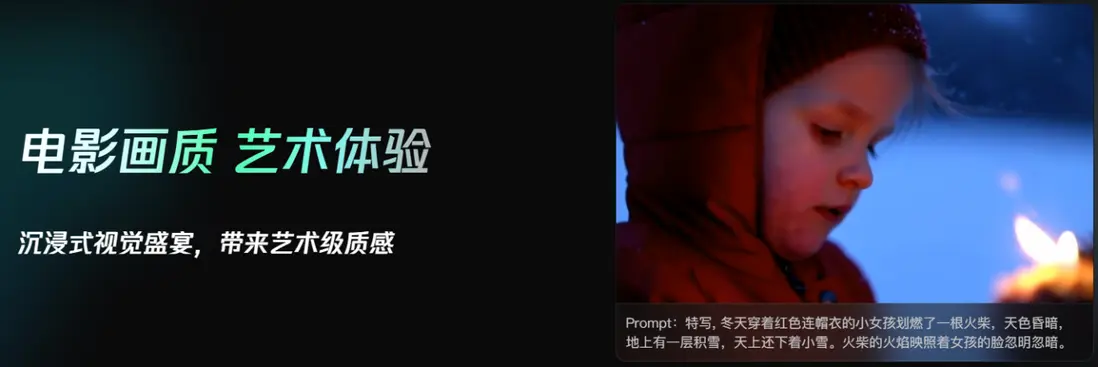

電影畫質 藝術體驗

電影畫質 藝術體驗

從功能特性來看,這款模型可謂是亮點多多。它能夠提供超寫實畫質質感,讓生成的視頻畫面細膩逼真,彷彿真實場景再現,成功打破了虛擬與現實之間那道看似難以逾越的界限。以往那些小幅度動態圖的侷限也被它輕鬆突破,無論是衝浪時的大幅度動作,還是舞者靈動優美的旋轉等,都能流暢且自然地演繹出來,使得視頻的觀賞性和連貫性達到了一個新的高度。

不僅如此,HunYuan-Video 還具備導演級的運鏡效果,展現出了業界少有的多視角鏡頭切換主體保持能力。在視頻生成過程中,藝術鏡頭能夠無縫銜接,為觀眾帶來如夢似幻的視覺敍事體驗,將創意和故事完美地融入每一個畫面之中。

而且,模型在光影反射上嚴格遵循物理定律,極大地降低了觀眾在觀看時可能產生的跳戲感,沉浸感十足。其強大的語意遵從能力更是不可小覷,用户只需簡單輸入指令,就能精準實現對多主體的描繪以及流暢的創作,無論是想要描繪繁華都市中的車水馬龍與人來人往,還是靜謐森林裏的各種動植物,它都能準確地按照要求呈現畫面,充分激發着使用者無限的創意與靈感,盡顯 AI 超寫實影像的獨特魅力。

有關厚德雲

厚德雲致力於為用户提供穩定、可靠、易用、省錢的 GPU 算力解決方案。海量 GPU 算力資源租用,就在厚德雲。