MiniMax-M1 模型是由 MiniMax 公司6月17日全新推出的大語言模型,使用 hybrid Mixture-of-Experts (MoE) 架構,並使用了 lightning attention 機制。 MiniMax 公司稱其為世界上第一個開源的大規模混合架構的推理模型。

MiniMax-M1 模型原生支持 1 百萬個 token 的上下文長度, 並且 lightning attention 機制使計算能夠高效擴展,與 DeepSeek R1 相比,MiniMax-M1 在生成長度為 10 萬個 token 時消耗的 FLOPs 僅為 DeepSeek R1 的 25%。這些特性使 M1 特別適合需要處理長輸入和廣泛思考的複雜任務。

由於 MiniMax-M1 模型的參數量達 456B,需要至少 8*96G 顯存的計算資源進行推理,雲端部署成為企業用户和開發者們部署 MiniMax-M1 時的優先選擇。阿里雲 PAI-Model Gallery 已同步接入 MiniMax-M1 模型,提供企業級部署方案。

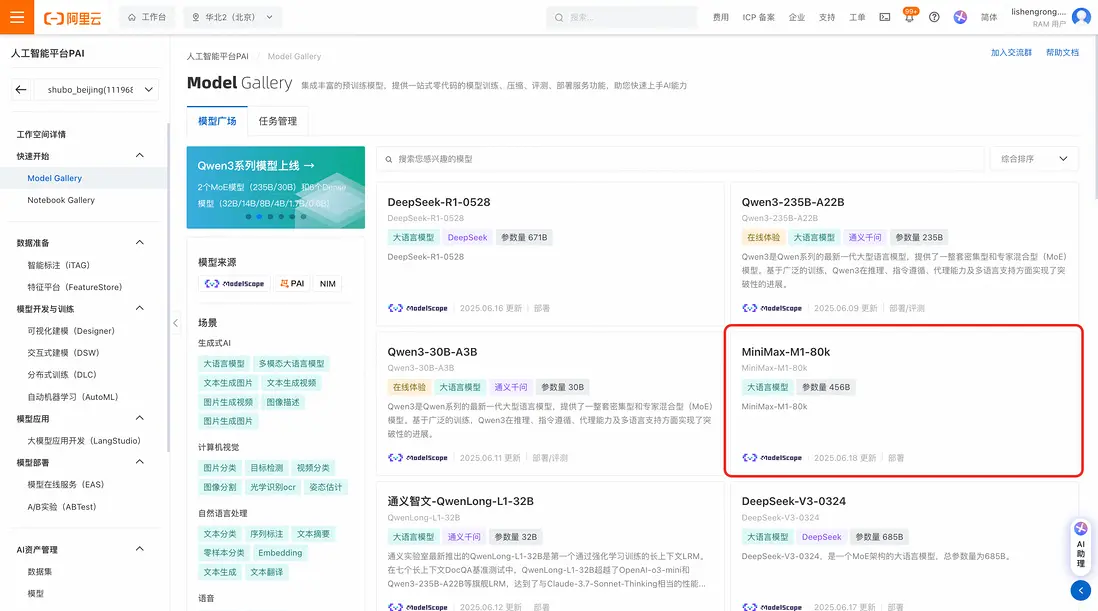

PAI-Model Gallery 簡介

PAI-Model Gallery 是阿里雲人工智能平台 PAI 的產品組件,它集成了國內外 AI 開源社區中優質的預訓練模型,涵蓋了 LLM、AIGC、CV、NLP 等各個領域。通過 PAI 對這些模型的適配,用户可以以零代碼方式實現從訓練到部署再到推理的全過程,簡化了模型的開發流程,為開發者和企業用户帶來了更快、更高效、更便捷的 AI 開發和應用體驗。

PAI-Model Gallery 訪問地址:https://pai.console.aliyun.com/#/quick-start/models

✅ 零代碼一鍵部署

✅ 自動適配雲資源

✅ 部署後開箱即用API

✅ 全流程運維託管

✅ 企業級安全 數據不出域

一鍵部署 MiniMax-M1

- 在 PAI-Model Gallery 模型廣場找到 MiniMax-M1 模型,或通過鏈接直達該模型:https://pai.console.aliyun.com/?regionId=cn-beijing#/quick-start/models/MiniMax-M1-80k/intro

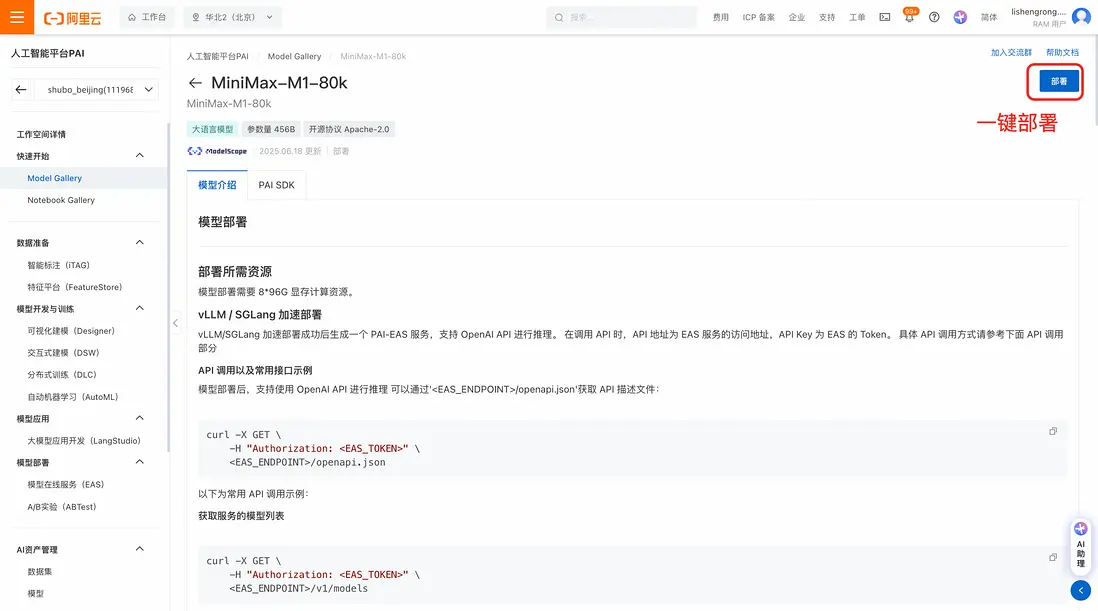

- 在模型詳情頁右上角點擊「部署」,在選擇計算資源後,即可一鍵完成模型的雲上部署。

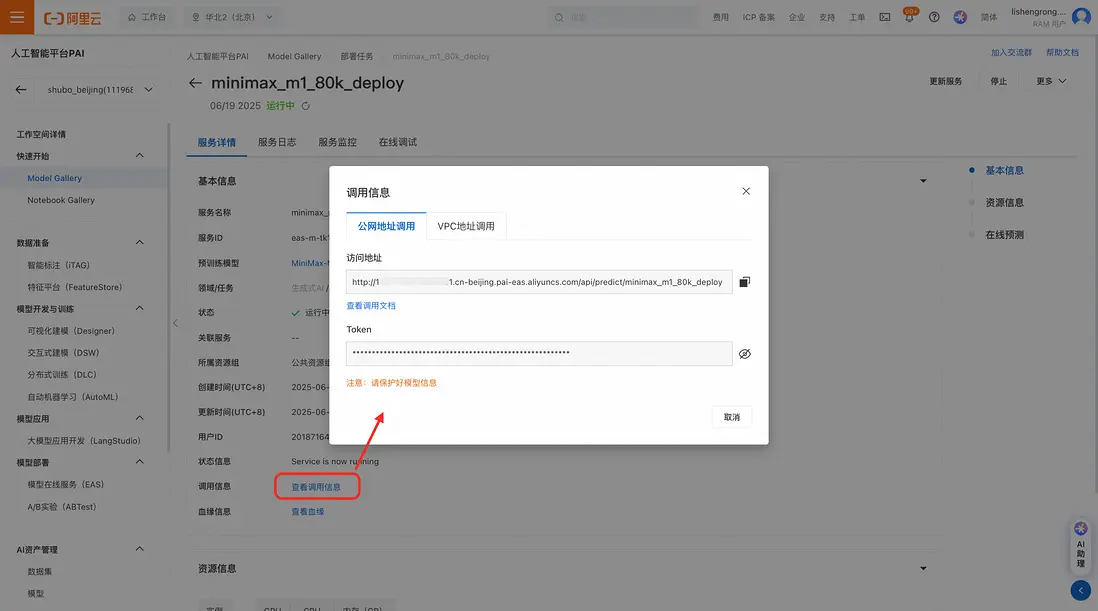

- 部署成功後,在服務頁面可以點擊“查看調用信息”獲取調用的 Endpoint 和 Token,想了解服務調用方式可以點擊預訓練模型鏈接,返回模型介紹頁查看調用方式説明。

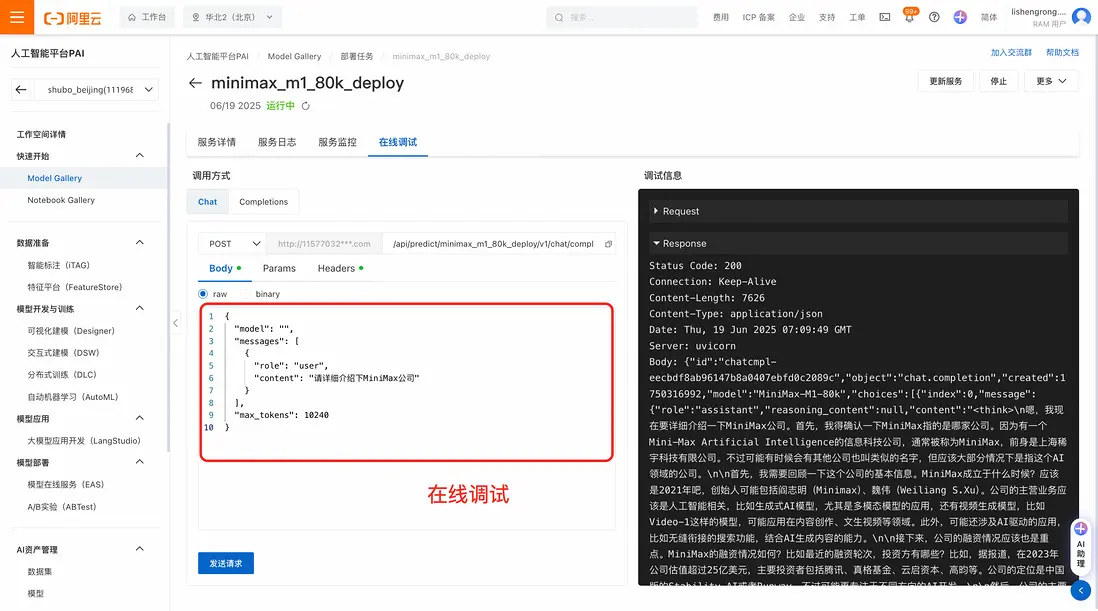

- 使用推理服務:您可以使用 API 調用模型服務,也可以使用 PAI 平台提供的在線調試功能,此外您還可以使用 PAI 平台提供的 WebUI 界面與模型進行交互。

更多模型支持

PAI-Model Gallery 持續提供開源社區熱門模型快速部署、訓練、評測實踐。

- 雲上一鍵部署 Qwen3 全尺寸模型:https://mp.weixin.qq.com/s/20xc0g-h6XLqKiAuSUNaIg

-

DeepSeek-R1 推理性能優化版:https://mp.weixin.qq.com/s/yMR4CAfW08SLO3qfd4FLhg。推理性能提升,相同時延約束下,吞吐能提升492%;相同吞吐情況下, 首token時延直降86%,token間時延直降69%。

聯繫我們

歡迎各位小夥伴持續關注使用 PAI-Model Gallery,平台會不斷上線 SOTA 模型,如果您有任何模型需求,也可以在評論區留言!