在全球範圍內,腸胃病正成為一個嚴峻的公共衞生挑戰。據世界衞生組織國際癌症研究機構統計,胃病在人羣中的發病率高達 80%,而在中國,腸胃病患者人數更是達到了 1.2 億之多,且呈現出明顯的年輕化趨勢,關注腸胃健康迫在眉睫。

在這種情況下,膠囊內窺鏡 (MCCE) 作為一種先進的診斷工具,因其非侵入性、無痛、無交叉感染的特點而被大家廣泛關注。具體而言,MCCE 在膠囊中內置了無線攝影機,患者只需吞下這個膠囊,它就會經過食道、胃部,隨後進入小腸,並在此過程中拍攝數萬張影像,將其記錄在患者的腰帶硬碟中,最後,膠囊會隨患者的糞便自然排出體外。根據拍攝的影像,醫生能快速找出腸胃疾病或異常狀況,極大地減輕了患者的醫療痛苦。

然而,由於膠囊內窺鏡的運動主要依賴腸胃蠕動,其拍攝範圍有限,MCCE 難以有效捕捉醫生想要關注的特定區域(即感興趣區域),往往只能拍攝到大量碎片化、視角不固定的圖像。這些圖像通常存在弱紋理、視角變化大、近距離拍攝變形等問題,給圖像拼接、定位帶來了極大挑戰,也增加了精準檢測病灶區域的難度。

對此,華中科技大學陸楓團隊聯合上海交通大學盛斌、中南民族大學、香港科技大學(廣州)分校、香港理工大學、悉尼大學,提出了一種自監督的、基於片段匹配的膠囊內窺鏡圖像拼接方法 S2P-Matching。 該方法通過模擬膠囊內窺鏡在腸胃道中的拍攝行為,增強原始數據,並利用對比學習提取圖像局部特徵,通過 Transformer 模型進行圖像 Patch 級別匹配,最終可將匹配精細化到像素級別,可顯著提高圖像拼接的準確性和成功率,增強早期發現和診斷腸胃道疾病的能力。

該成果以「S2P-Matching: Self-supervised Patch-based Matching Using Transformer for Capsule Endoscopic Images Stitching」為題,已被國際頂尖生物醫學工程領域期刊 IEEE Transactions on Biomedical Engineering 接受發表。

研究亮點:

- 相比其他現有方法,S2P-Matching 在實際 MCCE 圖像匹配上的表現更佳,尤其在解決腸胃道圖像的視差和弱紋理問題上,匹配的正確率和成功率分別提高了 187.9% 和 55.8%

- S2P-Matching 通過仿真膠囊內窺鏡的拍攝行為,生成了仿真圖像數據集,可以幫助模型學習不同視角下的圖像特徵

- 研究人員提出 S2P-Matching 方法,填補了傳統內鏡無法實現精準拼接與定位的空白,幫助醫生更全面、清晰地觀察腸胃道,提升腸胃疾病篩查的效率,從而推動無創內鏡技術在臨牀中的更廣泛應用

論文地址:

http://dx.doi.org/10.1109/TBME.2024.3462502

開源項目「awesome-ai4s」彙集了百餘篇 AI4S 論文解讀,並提供海量數據集與工具:

https://github.com/hyperai/awesome-ai4s

數據集:覆蓋 2w+ 臨牀拍攝數據,專業醫生精確標註

研究人員專注於分析實際臨牀場景中醫療專家們感興趣區域的一系列連續圖像,選取了國內某家醫院 2016 年至 2019 年間的膠囊內窺鏡檢查記錄。 為了驗證 S2P-Matching 的有效性和準確性,他們選擇了膠囊內窺鏡在相對穩定時段連續拍攝的圖像,作為訓練和測試數據集,這些圖像每隔 0.5 秒拍攝一次,每張的空間分辨率均為 480×480 像素。

具體而言,為確保隨機分組並優化拼接效果的比較,研究人員從 213 名患者的資料中隨機抽取樣本,又從每位患者的圖像序列中提取了 n×10 個連續幀(n 介於 5 至 15 之間),共計獲得 21,526 張圖像。經過嚴格篩選,最終保留了 20,862 張高質量圖像。在此基礎上,研究人員精選了 528 張圖像組成測試集,並邀請兩位合作醫生對這些圖像上的匹配點進行精確標註。

模型架構:補丁變形記,自監督 Transformer 帶你暢遊膠囊內窺鏡的無縫拼接之旅

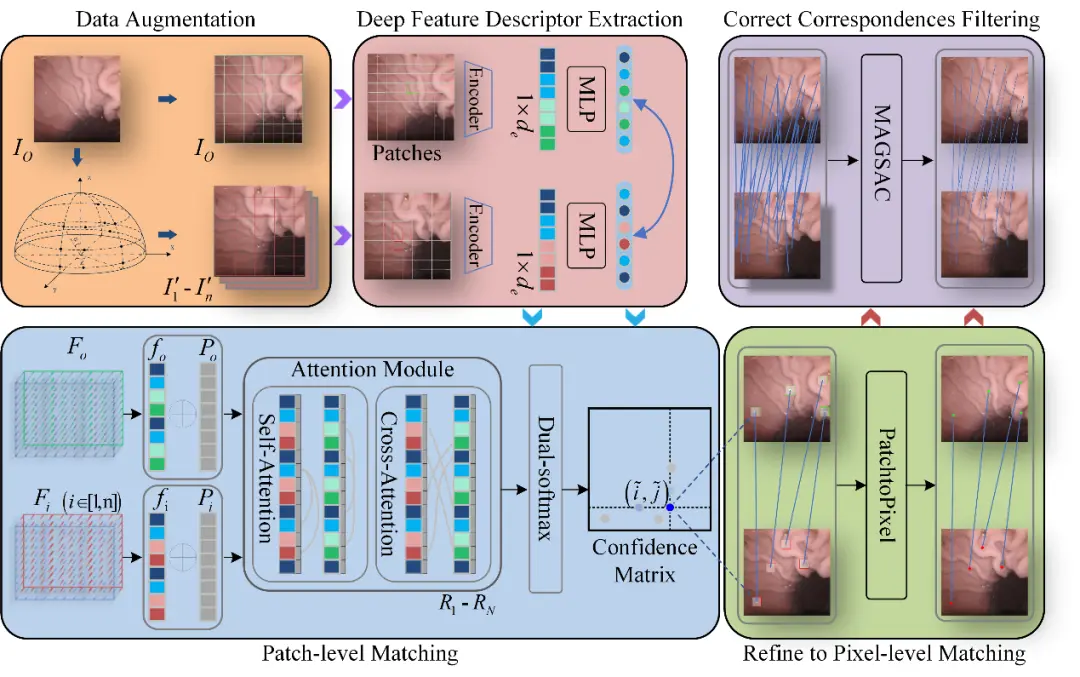

S2P-Matching 引入了改進的自監督對比學習方法,使用雙分支編碼器提取局部特徵,並用這些特徵訓練 Transformer 模型,以進行 Patch 級別的圖像匹配,最終通過 Patch-to-Pixel 方法進一步細化到像素級匹配。 其主要流程包含 5 個部分,分別是數據增強 (Data Augmentation)、特徵提取 (Deep Feature Descriptor Extraction)、Patch 級匹配 (Patch Level Matching、像素級配準 (Refine to Pixel-level Matching)、匹配點過濾 (Correct Correspondences Filtering),如下圖所示:

S2P-Matching 的架構圖

- 數據增強 (Data Augmentation):這部分的作用是數據增強,即通過仿射變換來模擬膠囊內窺鏡攝像機在腸胃道內的行為,生成多視角的參考圖像,幫助模型學習不同視角下的圖像特徵,避免手動標註的複雜性。

- 特徵提取 (Deep Feature Descriptor Extraction):這部分的作用是提取深度特徵描述符,即採用改進的對比學習技術來提取局部特徵。具體而言,通過一種雙分支編碼器,分別從圖像補丁和背景補丁中提取特徵,並將這些特徵連接 (Combine) 起來,形成用於匹配的深度特徵描述符。

- Patch 級匹配 (Patch-level Matching):這部分使用基於 Transformer 的模型來進行圖像補丁級別匹配,該模型通過多頭自注意力 (Self Attention) 機制擴展其感受野,從而有效識別圖像中不同的補丁匹配對。此外,還通過雙軟最大化 (Dual-softmax) 操作生成匹配概率矩陣,用於確定補丁配對的置信度。

- 像素級配準 (Refine to Pixel-level Matching):這部分將圖像從補丁級別匹配精煉到像素級匹配,即在補丁級匹配基礎上,使用 Patch-to-Pixel 方法將匹配細化到像素級別,進一步提升拼接精度。

- 匹配點過濾 (Correct Correspndence Filtering):確定正確匹配對,即使用 MAGSAC 算法過濾掉錯誤的匹配對,確保得到準確的像素級匹配結果。

結合數據增強、對比學習、Transformer 網絡和像素級匹配,S2P-Matching 能有效提升內窺鏡圖像的匹配和拼接精度,尤其在紋理較弱、近距離拍攝及旋轉情況下表現突出,這為基於 MCCE 的腸胃道篩查提供了潛在的應用價值。 未來,研究人員將進一步擴展該方法的應用場景,例如應對複雜的光照條件、氣泡、模糊和遮擋等問題。

實驗結論:匹配+拼接,S2P-Matching 在膠囊內窺鏡圖像中表現全能

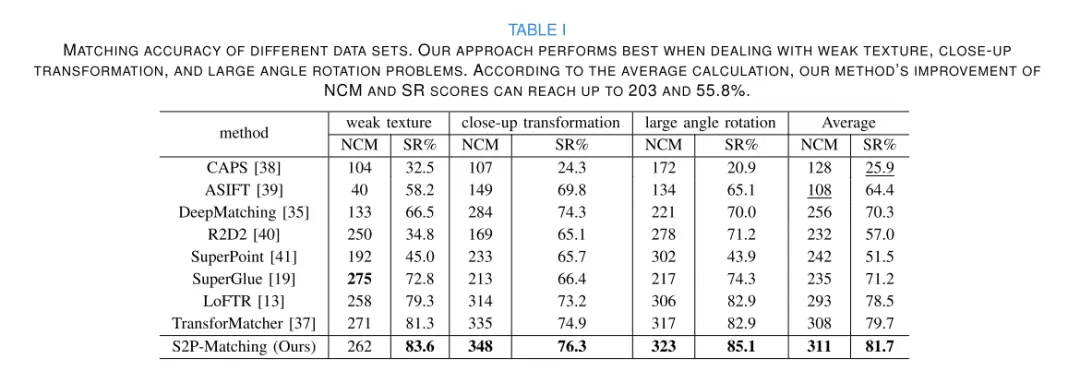

為評估 S2P-Matching 方法的性能,研究人員將其與當前其他先進圖像匹配算法(如 CAPS、ASIFT、DeepMatching、R2D2、SuperPoint 等)進行了圖像匹配效果對比。其中,用於實驗的數據集包含了從 2016 年到 2019 年間採集的膠囊內窺鏡圖像,覆蓋了多種複雜場景,如弱紋理、近距離拍攝、大角度旋轉等。

如下表所示,研究結果表明,在所有實驗類型中(弱紋理、近距離拍攝、大角度旋轉),S2P-Matching 表現出最高的 NCM(正確匹配點數)和 SR(成功率)分數,平均 NCM 達到了 311,平均 SR 為 81.7%。與傳統算法相比,S2P-Matching 的匹配準確率顯著提升。

不同方法的圖像匹配性能對比

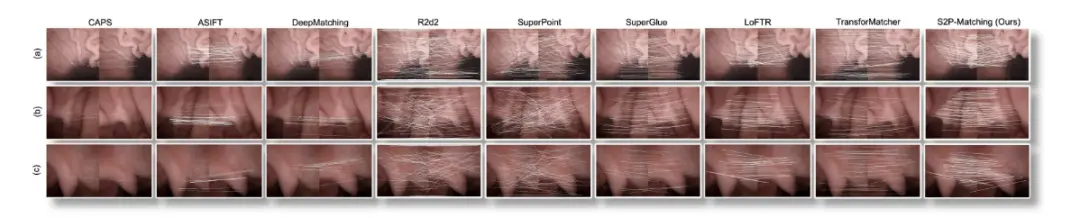

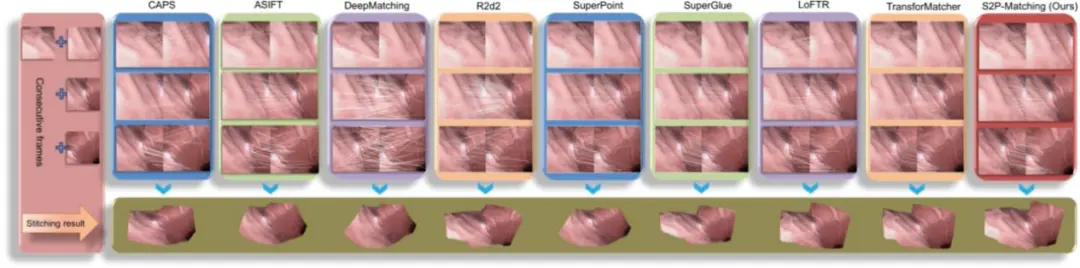

研究人員從不同數據集(弱紋理、近距離拍攝、大角度旋轉)中選擇了 3 組圖像。並比較不同方法的匹配結果視覺圖,每對輸入圖像包括以 0.5 秒間隔拍攝的 2 個膠囊內窺鏡圖像,每列的 3 對圖像都是在非常接近的位置拍攝的,並且存在旋轉方差,白色線表示對應的對,即匹配結果。不同方法得到的圖像匹配結果視覺圖如下圖所示:

不同方法得到的圖像匹配結果視覺圖

可以看出,從第 1 行到第 3 行,隨着紋理變弱與重複區域增多,各種方法匹配得到的匹配對數量都有不同程度的減少。例如,CAPS 和 ASIFT 只能提取少量的匹配對,並且存在不正確的匹配對,導致最終的圖像拼接錯誤。DeepMatching 也只能提取有限數量的匹配對。R2d2 和 SuperPoint 匹配的數量很大,但存在很多不準確的匹配對。SuperGlue,LoFTR 和 TransforMatcher 正確匹配較少。與其他方法相比,S2P-Matching 實現了最佳的特徵匹配性能,能夠在不受雜質干擾和明顯變換的情況下,提取足夠數量的重要匹配對,從而保證最終的圖像的拼接。

在臨牀應用中,膠囊內窺鏡由於每次拍攝的圖像範圍有限,使得醫生難以在一個較寬的視野中觀察到感興趣區域,這可能會影響診斷準確性。通常,一個完整的感興趣區域會涉及多張有部分重疊的連續圖像。因此,實現膠囊內窺鏡圖像的連續拼接是非常重要的。

如下圖所示,研究人員對比不同方法對膠囊內鏡圖像連續幀的拼接,結果發現,S2P-Matching 的拼接效果最為自然,拼接精度最高,能夠有效應對圖像弱紋理和旋轉等難題。與其他算法相比,該方法生成的匹配對最多,拼接結果無明顯紋理錯位、過度縮放和紋理連接等問題。

不同方法的圖像拼接效果比較

進一步地,研究人員通過消融實驗,研究了不同模塊對最終效果的影響。結果顯示,結合圖像衍生和深度特徵描述符的 S2P-Matching 框架能夠顯著提高圖像匹配的準確性,特別是在處理複雜的膠囊內窺鏡圖像時效果更佳。此外,S2P-Matching 在處理不同角度的旋轉拍攝圖像時表現優異,能夠很好地適應大角度旋轉的圖像匹配任務,其準確度優於其他方法。

綜上,S2P-Matching 在複雜的膠囊內窺鏡圖像匹配任務中取得了更高的匹配精度、更好的拼接效果,尤其是在弱紋理、旋轉及近距離拍攝等複雜情況下表現出明顯優勢。

智能醫療的領航者

隨着醫療技術的進步,膠囊內窺鏡成為了探索人體內部世界的「小鏡頭」,這種無創檢查方式在 AI 的支持下,不僅減輕了患者的痛苦,還為醫生提供了寶貴的診斷依據。

值得一提的是,論文的第一作者、華中科技大學的陸楓教授持續關注 AI 在疾病診療中的應用。除了上述研究外,她還曾與悉尼大學團隊合作,在 IEEE/ACM Transactions on Computational Biology and Bioinformatics 上發表了論文「Fine-Grained Lesion Classification Framework for Early Auxiliary Diagnosis」,提出了一種針對膠囊內窺鏡得細粒度病灶分類框架,該框架能夠從來自膠囊內窺鏡的醫學影像中準確的識別出不同尺度大小的候選病灶,輔助醫生進行早期診斷。

論文原文:

https://ieeexplore.ieee.org/abstract/document/10077722

陸楓教授的研究成果頗豐,已在 Nat Med、IEEE Network、TBME、TCBB、TIOT、AAAI 等國際頂級期刊和會議上發表了 30 餘篇學術論文,並獲得了多項國內外專利和技術獎項。

陸楓

陸楓個人主頁:

http://faculty.hust.edu.cn/lufeng2/zh_CN/index.htm

她所在研究團隊隸屬華中科技大學 CGCL 實驗室,該實驗室是科技部重點領域創新團隊、教育部「長江學者和創新團隊發展計劃」創新團隊牽頭單位、湖北省自然科學基金創新團隊,承擔了近 400 項科研項目,擁有豐富的醫療數據資源和豐富計算資源,是國際上極少數可以進行產業級大尺度數據分析和智能醫療研究的實驗室之一。

華中科技大學 CGCL 實驗室主頁:

https://grid.hust.edu.cn/

陸楓教授的團隊不僅憑藉自身過硬的技術和豐富的資源取得了顯著成就,而且還積極尋求與國內外頂尖高校的合作,例如,在本文的研究中,陸楓團隊就與 AI 醫療領域的資深學者盛斌教授展開了合作。盛斌教授長期關注 AI 在醫療中的應用,在該領域發表了一系列研究成果。比如構建全球首個面向糖尿病診療的視覺-大語言模型集成系統 DeepDR-LLM,為基層醫生提供個性化的糖尿病管理意見及糖尿病視網膜病變輔助診斷結果。

更多詳情:全球首個!清華/上海交大等聯合構建面向糖尿病診療的視覺-大語言模型,登 Nature 子刊

未來,在這些傑出研究人員的共同推動下,我們期待能實現更精準、高效的醫療診斷,切實提升患者的醫療體驗。

參考資料:

1.https://gleneagles.hk/sc/medical-treatments/capsule-endoscopy

2.https://m.21jingji.com/article/20240409/herald/244d34d9d0c815096fa8f3a25ca5cced_zaker.html