OpenAI發佈了開源安全推理模型gpt-oss-safeguard,包含120B和20B兩個版本,支持開發者自定義策略進行內容審核,模型基於Apache 2.0許可證開放使用。

兩款不同尺寸模型支持 harmony 格式的輸入輸出,並提供低、中、高三級推理強度設置。它們主要面向輸入輸出過濾、在線內容標註、離線信任與安全審核等場景,不適用於通用生成任務。

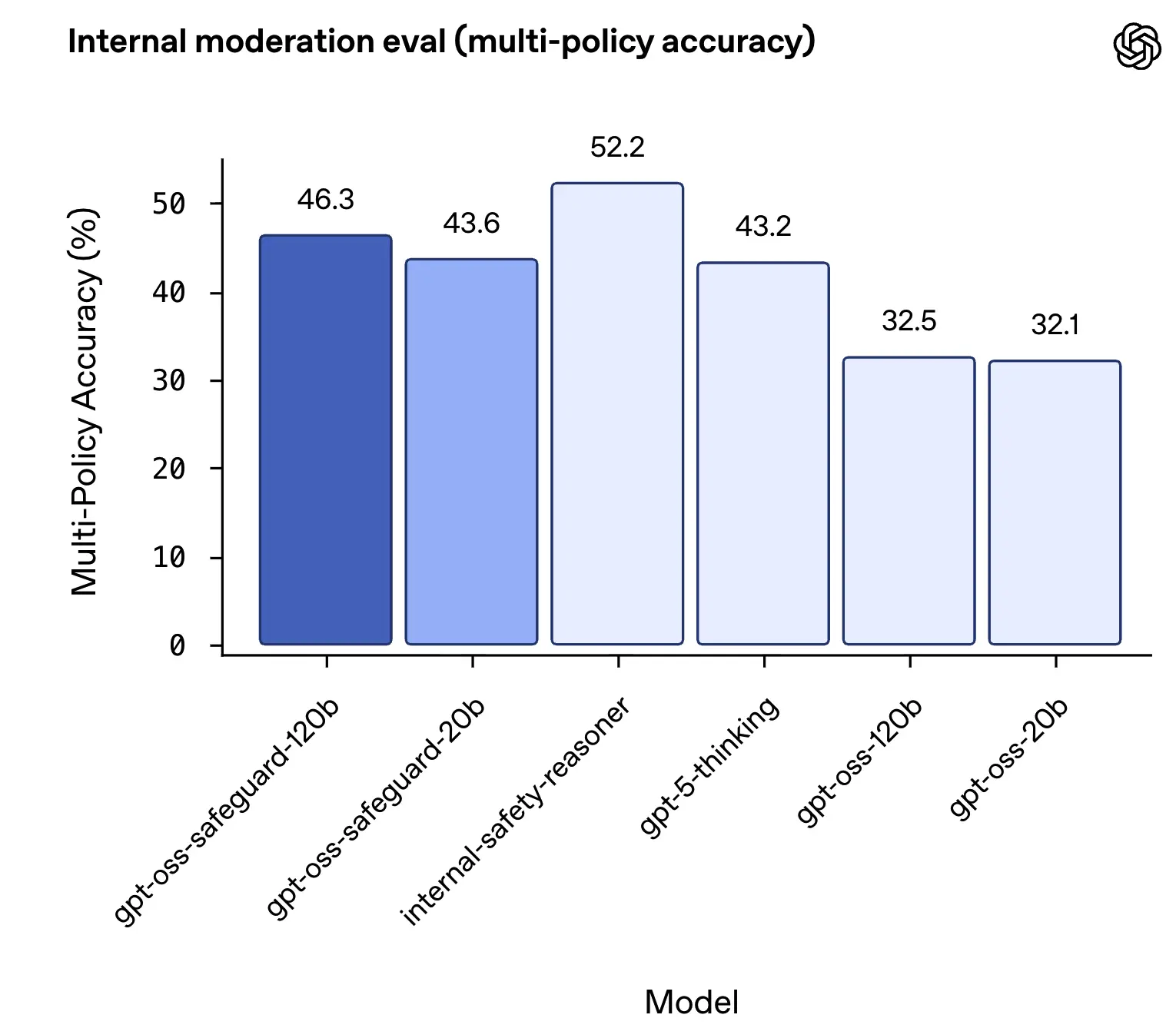

據介紹,gpt-oss-safeguard 可直接讀取開發者提供的策略文檔,通過鏈式推理輸出審核結論及依據,支持多策略並行處理,內部測試多策略準確率達52.2%,超越GPT-5-Thinking和原版GPT-OSS。該模型採用“策略直讀+推理解釋”機制,無需重新訓練即可動態調整規則,適用於新興風險、細分領域及樣本稀缺場景。

模型下載地址:https://huggingface.co/collections/openai/gpt-oss-safeguard