美團LongCat團隊正式發佈LongCat-Video視頻生成模型,旨在以視頻生成路徑探索“世界模型”,為自動駕駛、具身智能等場景夯實技術基礎。

該模型基於DiT架構,以“條件幀數量”區分任務,原生支持文生、圖生視頻及視頻續寫,形成任務閉環。可生成720p/30fps高清內容,原生支持5分鐘級長視頻輸出,通過多重技術規避時序與物理合理性問題;經三重優化提升推理效率10.1倍。

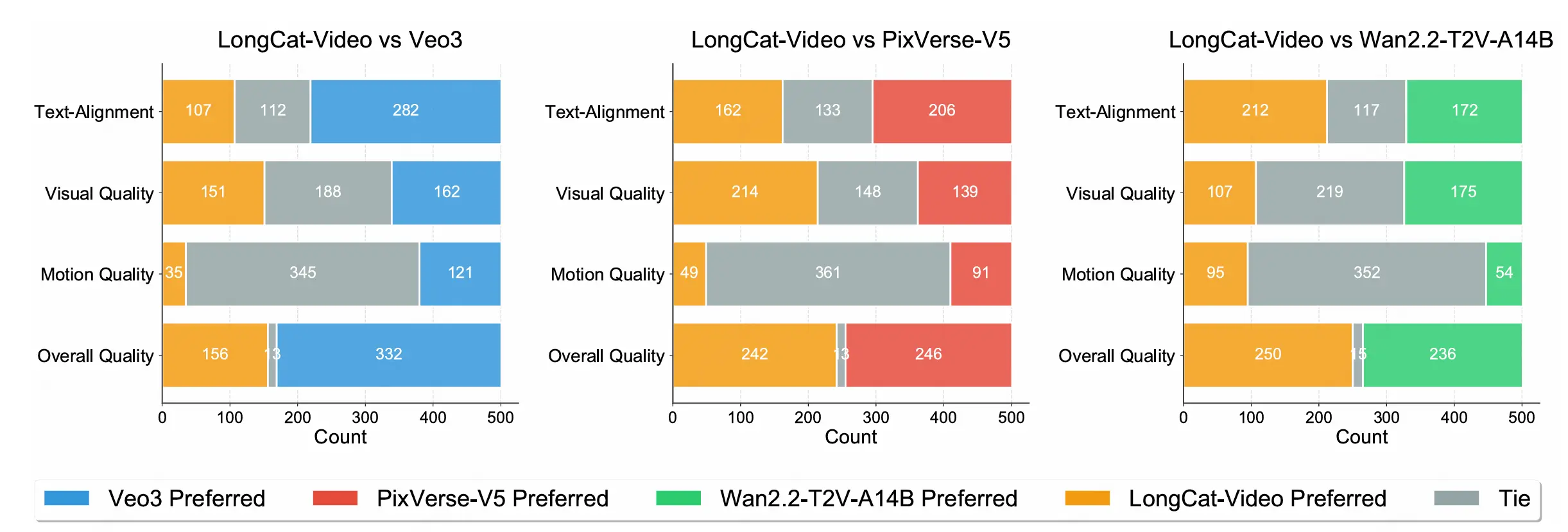

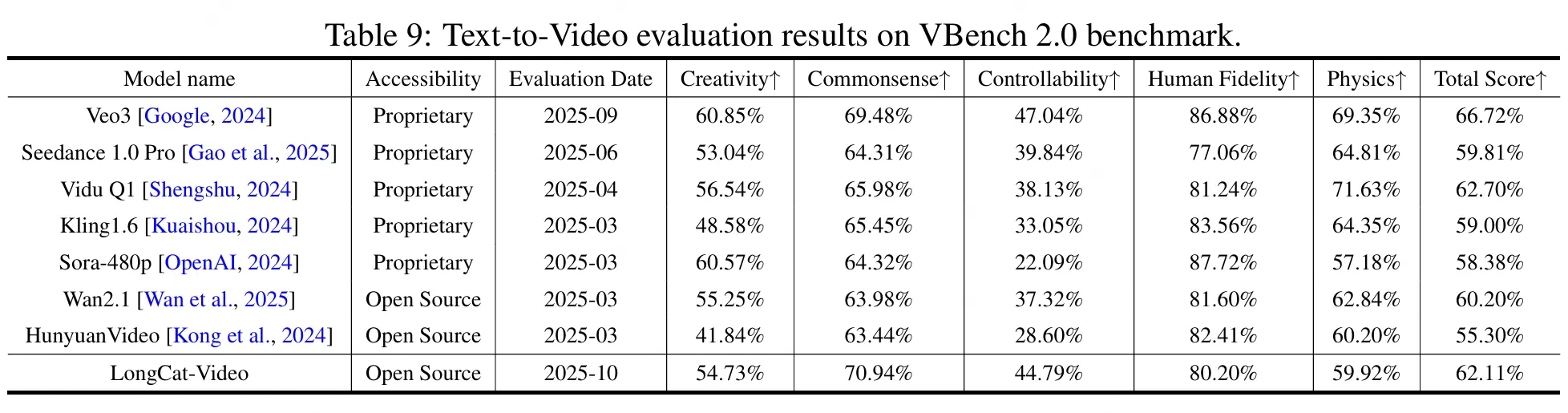

其136億參數基座模型在文生、圖生視頻任務中達開源SOTA,VBench等測試表現優異。通過全面的評估顯示,LongCat-Video 通用性能優秀,綜合能力躋身開源 SOTA:

-

136 億參數的視頻生成基座模型,在文生視頻、圖生視頻兩大核心任務中,綜合性能均達到當前開源領域 SOTA 級別;

-

通過文本-視頻對齊、視覺質量、運動質量、整體質量四大維度評估,其性能在文本對齊度、運動連貫性等關鍵指標上展現顯著優勢;

模型已開源至GitHub、Hugging Face等平台,供開發者使用。

GitHub:https://github.com/meituan-longcat/LongCat-Video

Hugging Face:https://huggingface.co/meituan-longcat/LongCat-Video

Project Page:https://meituan-longcat.github.io/LongCat-Video/