AI網關作為雲產品推出已有半年的時間,這半年的時間裏,AI 網關從內核到外在都進行了大量的進化,本文將從 AI 網關的誕生、AI 網關的產品能力、AI 網關的開放生態,以及新推出的 Serverless 版,對其進行一個全面的介紹,期望對正在進行 AI 應用落地的朋友,在 AI 基礎設施選型方面提供一些參考。

AI 網關是技術架構演進的產物

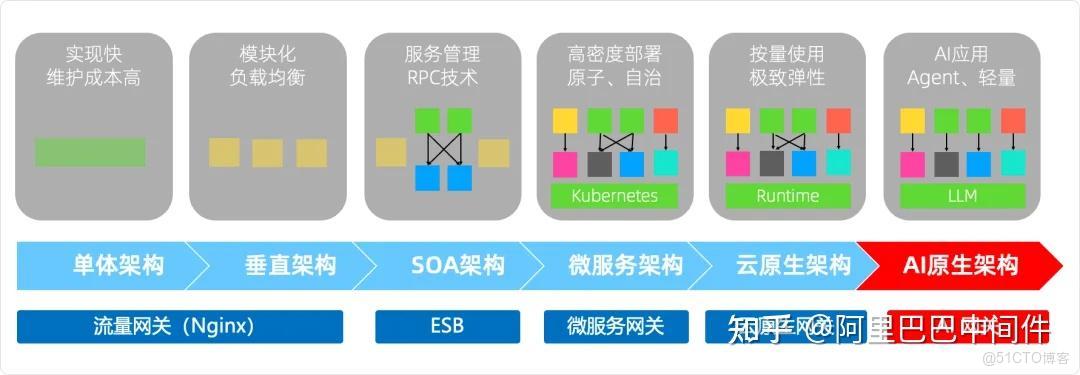

每一代應用架構的演進,都會產生新的網關訴求,從一開始的單體架構的流量網關(如 nginx),到微服務架構出現的微服務網關(如 Spring Cloud Gateway),再到雲原生架構出現的雲原生網關,網關都是企業應用基礎設施中的重要一環,提供快速接入、統一管理、統一治理等關鍵能力。

當 AI 應用出現後,伴隨着 AI 原生架構的發展,AI 網關也順勢而生了。

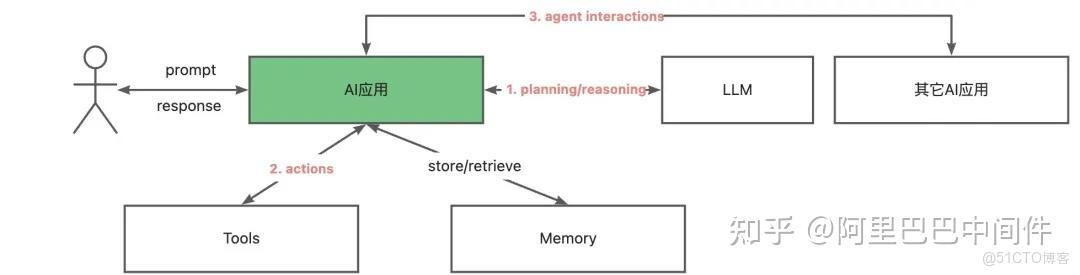

相對於傳統應用,AI 應用具有明顯的架構特徵,簡單來説即以模型為中心,通過模型的推理能力,給定提示詞,藉助工具和記憶,來滿足特定的業務訴求。

如何支撐 AI 應用更快捷、更穩定、更安全地訪問模型、訪問工具、訪問其它 Agent,成為 AI 網關的核心訴求。

在推出商業版的 AI 網關之前,Higress 在阿里雲內部進行了大量的探索,當前已成為阿里雲 AI 流量的核心承載網關,包括通義 APP、阿里雲百鍊、PAI 等服務,背後都有 Higress 的身影。

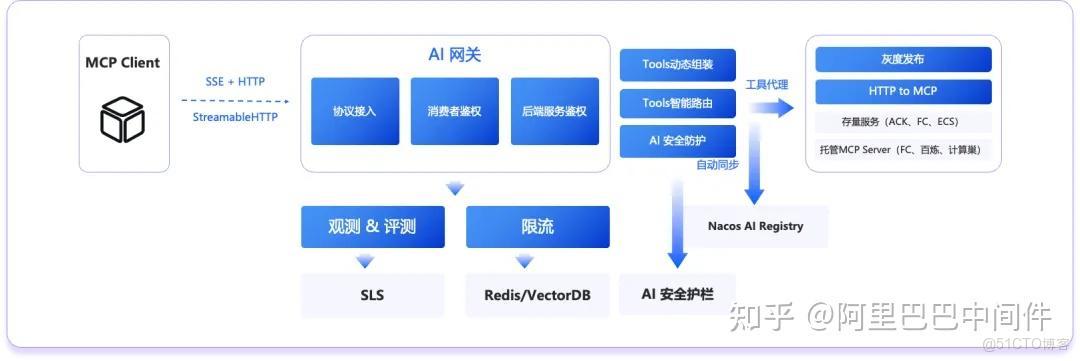

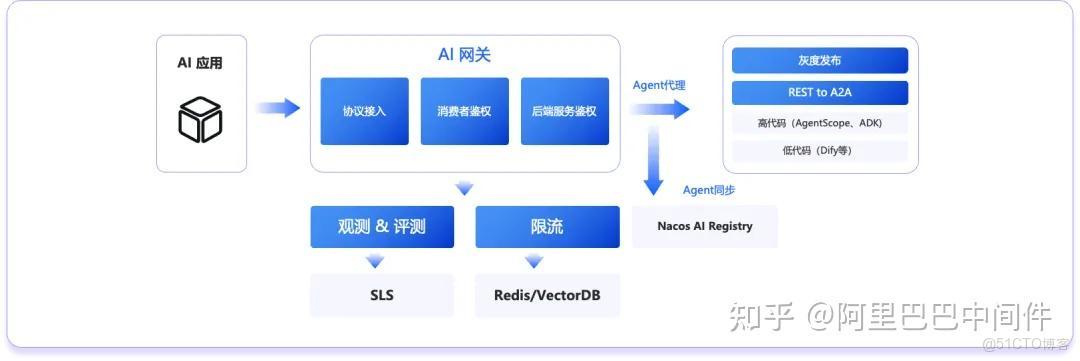

受限於當時 AI 應用的發展水平,最初的商業版 AI 網關只提供了模型代理的能力,但在過去半年中,AI 應用快速發展,MCP、A2A 等協議也逐漸成為主流,AI 網關也從模型代理髮展到包含模型、MCP、Agent 三大 API 形態,集成各種治理能力的 AI 應用的統一入口。同時在 AI 網關之上以開源形式獨立發展出了 HiMarket AI 開放平台。

AI 網關的核心產品能力

接下來我們從模型、工具、Agent 三種訪問場景以及安全這個橫向維度,瞭解下 AI 網關所解決的具體問題和核心產品能力。

2.1 模型訪問場景

2.1.1 訪問模型服務的挑戰:三多兩高

隨着企業 AI 應用的落地深入,AI 應用對大模型的訴求呈現出多模型、多模態、多場景的“三多”特點。

- 多模型:不同供應商的模型 API 接口標準不同,訪問方式不同,模型 API 的調用方無法平滑地在不同供應商之間切換,無法同時使用不同供應商提供的模型。

- 多模態:不同於文生文大模型 openAI 兼容標準的一統天下,多模態模型呈現百花齊放的特徵,傳輸協議有 SSE、Websocket、WebRTC,請求響應方式有同步有異步,請求和響應結構更是發散,給基礎設施團隊帶來很大的管理壓力。

- 多場景:不同業務場景在落地 AI 時訴求不同,有的要求低 RT(如實時語音轉換),有的要求高穩定性(如長論文的理解),不同的場景在限流等手段的選擇上差異很大。

除此以外,企業訪問模型服務還有安全要求高、穩定性要求高的“兩高”特徵。

- 安全要求高:企業在調用模型服務接口時,其內部數據存在泄露風險,同時,調用模型服務,尤其是開源或外部模型服務時,數據的合規也是不可忽視的問題。

- 穩定性要求高:模型服務受到硬件限制,其接口限流閾值較低,且自身穩定性也低於一般 API 服務,接口的 RT 和成功率均不夠穩定,進而會影響到 AI 應用的整體可用性。

2.1.2 AI 網關在模型訪問場景的解決方案

“三多兩高”的問題,藉助 AI 網關,可以這麼解決:

- 多模型:AI 網關上可以配置多種模型路由策略,比如按照模型名稱路由、按照比例路由,以及按照某些請求特徵(如特定 header)路由等,同時支持將不同的模型供應商協議統一為 openAI 兼容,AI 應用只需要按照 openAI 兼容方式,即可在多種模型之間無縫切換。

- 多模態:AI 網關支持代理 HTTP 和 Websocket 兩種傳輸協議的多模態模型調用,AI 應用可以像使用文生文模型一樣,按照統一的接入點接入多模態模型,同時,網關管理員可以通過插件等能力增強多模態模型的安全和穩定性。

- 多場景:AI 網關推薦按照不同的模型場景(文生文、文生圖、語音識別等)創建獨立的 Model API,併為每個調用方分配獨立的消費者身份,按照消費者進行觀測、限流、安全防護和計量計費。

- 安全要求高:AI 網關對調用方支持消費者鑑權,避免 API-KEY 的直接對外,對模型服務支持後端服務鑑權和 API-KEY 管理,在網關側統一管理服務鑑權,同時,無論是鑑權的密鑰還是 API-KEY,都可以託管到 KMS 中統一管理,避免數據在網關側落盤的安全風險。另一方面,AI 網關深度集成 AI 安全護欄,可對各類安全風險和合規問題進行攔截阻斷,同時,配合數據脱敏插件,可在數據發送到模型前移除敏感信息,保證內容安全。

- 穩定性要求高:AI 網關在穩定性方面的增強體現在可見、可控兩個層面。首先是全鏈路穩定性的觀測,AI 網關會記錄每次請求的供應商、模型、消費者,以及請求的各種指標如首包時長、token 數等,請求被限流、攔截、fallback 等也會標識出來,通過內置的大盤可視化展示;其次是模型訪問的可控,主要包括負載均衡、fallback、限流、緩存等能力,我們推薦基於消費者配置治理能力,如消費者維度的 token 和併發度限流。

網關管理員可以持續關注觀測大盤,根據調用情況,及時做出針對性的調整。

2.2 工具訪問場景

2.2.1 訪問工具的挑戰:精準、安全

AI 應用訪問工具的主要挑戰是如何用最少的代價,調用最合適的工具,並且保證調用過程的安全。

隨着工具數量的增加,將所有工具交給大模型推理,一方面造成 token 消耗地大幅增加,增加了推理成本,甚至可能超過大模型的上下文長度限制;另一方面由於工具過多,模型更可能選擇到錯誤的工具,從而影響執行結果。

另外,工具調用直接影響業務,使用不當將極大擴展安全的風險邊界,像 MCP 惡意投毒這樣的新型方式,對安全防護提出了新的挑戰。

2.2.2 AI 網關在工具訪問場景的解決方案

針對工具的精準和安全,AI 網關通過如下方式解決:

- 精準:AI 網關同時支持存量 HTTP 服務和託管的 MCP Server,對於存量 HTTP 服務,用户可以在網關上即時調整工具描述,同時,AI 網關支持工具的動態組裝,可以通過創建虛擬 MCP Server,按需組裝工具列表,滿足特定業務場景訴求,這樣 provider 和 consumer 可以分別定義自己的 MCP Server。另一方面,AI 網關提供了工具智能路由的能力,可以在網關側智能篩選工具列表,只返回與問題相關的工具集,從而節省模型推理的 token 和模型選擇工具的準確度。

- 安全:與模型訪問類似,AI 網關在工具訪問場景同樣建設了豐富的安全能力,針對調用方的消費者鑑權,除支持 MCP Server 粒度的鑑權配置外,還可以針對某個工具單獨設置鑑權,從而實現為不同風險等級的 Tool 賦予不同調用方權限的目的;針對 MCP 描述、工具描述、工具響應結果中的注入問題,可對接 AI 安全防護,在調用源頭進行防護。

2.3 Agent 訪問場景

2.3.1 訪問 AI Agent 的挑戰:穩定、靈活

開發者可通過多種形式構建 AI Agent,包括:

- 高代碼:如基於 Spring AI Alibaba、ADK、langchain 等框架自己編碼,這種方式靈活性最高,能力也最豐富,當然對開發者要求也最高

- 低代碼:如基於 Dify 這樣的平台進行流程的拖拉拽編排,這種方式搭建起來靈活、快速,能夠快速驗證與試錯,對開發者要求也較低

- 零代碼:如基於 JManus 這樣的工具,直接通過提示詞完成 AI Agent 的構建

不同的 AI Agent 形態,導致 AI Agent 的接入方式多種多樣,缺乏標準,難以像管理雲原生應用那樣進行統一的治理與管控。

同時 AI Agent 受制於背後的大模型能力,其穩定性很難保證,如果不做好防護,很容易牽一髮而動全身,導致依賴該 Agent 的業務產生雪崩。

2.3.2 AI 網關在 Agent 訪問場景的解決方案

與訪問工具類似,AI 網關可以作為 AI 應用的統一代理:

- 穩定:AI 網關可以直連包括 ACK、FC、SAE 在內的多種運行平台,通過主動和被動健康檢測,及時隔離異常節點,並通過灰度發佈,有效降低變更風險,通過多種限流策略避免應用過載,提升 AI 應用的穩定性。

- 靈活:藉助 AI 網關的服務發現,可以將部署在各種計算平台上的 AI 應用在 AI 網關上統一對外透出,並通過網關的 REST to A2A 轉換能力,將存量 HTTP 應用自動轉換為符合 A2A 協議的 AI 應用。對於運行在 dify 上的低代碼 AI 應用,AI 網關可統一代理,並支持二次鑑權。

除此以外,AI 網關深度集成阿里雲可觀測體系,AI 應用接入 AI 網關後,可一鍵開啓 AI 全鏈路觀測能力,從應用到 MCP 工具到模型,實現全鏈路追蹤與問題定位。

2.4 安全防護維度

2.4.1 AI 應用的安全防護挑戰:網絡+數據+內容

AI 原生架構下,大模型處於核心位置,很多時候是大模型而不是應用自身來調度工具和使用數據,這就讓 AI 應用的安全風險邊界比以往擴大了,而方式也更為多樣,比如針對大模型的爆破、針對 MCP 的注入等等,都是 AI 原生架構下新的安全風險。在這個背景下,安全防護的範圍將從網絡和數據,擴展到內容層面。而由於內容的發散性,針對 AI 應用的內容防護也將從以往的規則庫和小模型,進化到微調大模型、小模型和規則庫混合的方式。

2.4.2 AI 網關的安全防護方案

針對 AI 原生架構的安全挑戰,AI 網關從網絡安全、數據安全和內容安全三個層面進行了安全防護。

- 網絡安全:在網絡安全層面,AI 網關集成 SSL 證書和 WAF 防護,結合內置的四層/七層 IP 黑白名單能力,可在網絡入口有效防護和阻斷安全風險。

- 數據安全:在數據安全層面,AI 網關首先通過後端服務鑑權和 API-KEY 託管,將 API-KEY 進行二次簽發,降低數據泄露的影響範圍;其次,無論是 API-KEY 還是其它敏感信息,都可以在 AI 網關上集中託管到 KMS,做到敏感信息在網關側不落盤。

- 內容安全:在內容安全層面,AI 網關與 AI 安全護欄深度集成,可按 API 一鍵開啓,防護包括敏感詞風險、合規風險、提示詞注毒和爆破風險在內的各類安全問題,並支持按防護維度分別制定攔截策略,提升 AI 應用的安全水位和穩定性。

AI 開放平台幫助企業構建 AI 應用協作機制

3.1 HiMarket 的定位

通過 AI 網關,企業可以快速地進行 AI 應用創新,但是當企業開始大規模落地的時候,新的問題出現了,即 AI 應用的開發者和管理者如何進行高效地協同。相關的問題包括如何管理不同 AI 應用開發者的權限和配額,如何上架 MCP Server 和 Agent,如何讓開發者自行註冊和申請 MCP 和 Agent 的訪問權限,如何進行審批等等。

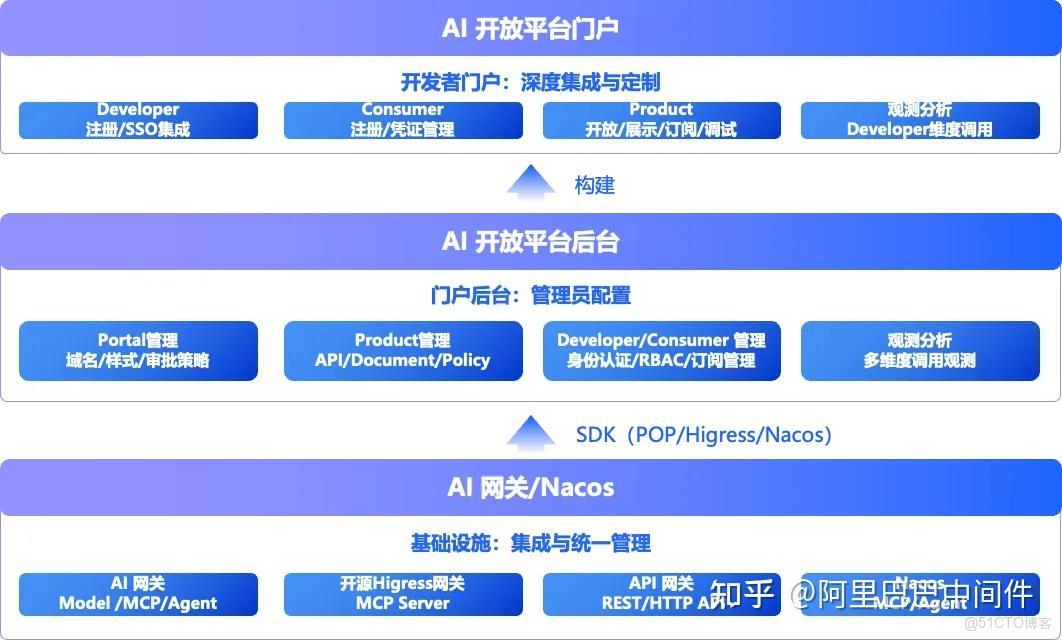

按照最簡的抽象視角,AI 開放平台面向兩類角色:開發者和管理者,開發者申請和使用開放平台上的各類 MCP Server 和 Agent,構建自己的 AI 應用,管理者維護開放平台上的各類資產,對 MCP Server 和 Agent 進行上架,對開發者進行認證、審批和設定配額,並管理實際承載 MCP Server 和 Agent 的各個 AI 網關。於是,在用户界面上,AI 開放平台分為主要面向開發者的開發者門户,和主要面向管理者的開放平台後台。開發者門户主要承接開發者的註冊和訪問,與企業 SSO 對接,實現開發者的認證和鑑權。開放平台後台主要承接管理者的各類訴求,包括門户的管理、資產的管理、網關的管理等。

每個企業都有自己的研發協同機制和賬號體系,在這個問題上,雲產品很難提供一個標準解。為了解決這個問題,AI 網關團隊參照業界最佳實踐,開源了 HiMarket AI 開放平台,以幫助企業構建自己的 AI 開發者門户,可訪問 https://github.com/higress-group/himarket 查看。

3.2 Himarket 的整體架構

HiMarket AI 開放平台在架構上分為三層:

- AI 開放平台門户:這一層面向開發者,每個 Agent 和 MCP Server 的門户都不盡相同,定製化程度最高。

- AI 開放平台後台:這一層面向管理員,管理三大核心對象:門户(portal)、產品(product,包括 MCP Server 和 Agent)、開發者。

- AI 網關/Nacos:這一層為基礎設施,通常只有管理員可見,並通過 AI 開放平台後台進行統一管理與集成。

已經有部分用户基於 HiMarket 在構建自己的 AI 開放平台,如果您也有類似訴求,歡迎加入 HiMarket 開源社區共建。

AI 網關 Serverless 版,大幅降低開通成本

AI 網關在雲棲前上線了 Serverless 版,相比專享實例版,Serverless 版極大地降低了開通和使用成本,在阿里雲 Serverless AI 場景的大圖上補上了重要的一塊。AI 網關結合百鍊、FC/FunctionAI 和雲市場,用户可構建完整的 Serverless AI 基礎設施。。

具體來説,AI 網關 Serverless 版有如下 3 大特點:

- 擁有專項實例版的全部核心功能,覆蓋模型訪問、MCP 訪問和 Agent 訪問場景。受產品形態限制,Serverless 版不支持內置 WAF 集成和插件能力,如果對這兩塊能力有強訴求,請使用專享實例版。

- 按調用量付費,沒有實例費用,對於調用量較低的用户可降低 90% 的使用成本。

- 100% 免運維,AI 網關 Serverless 版無需用户手工運維,可自動升級和按水位彈性伸縮。需注意,如果流量在短時間內大量增加,為了保護網關實例,AI 網關 Serverless 版將會拒絕掉處理不了的請求,如果您的請求峯值 QPS 較高且快速增長,請使用專項實例版。

Serverless 版與專享實例版的詳細對比,請參考:

https://help.aliyun.com/zh/api-gateway/ai-gateway/product-overview/ai-gateway-capacity-description

Serverless 版的計費方式,請參考:

https://help.aliyun.com/zh/api-gateway/ai-gateway/product-overview/free-product-templates

總結

過去半年,AI 網關完成了從“單一模型代理”到“AI 應用統一入口”的跨越——內核上,以模型、MCP、Agent 三大 API 形態覆蓋 AI 原生架構的主要流量;治理上,圍繞多模型、多模態、多場景等痛點,在路由、協議轉換、限流、緩存、觀測、安全護欄等方面形成了一站式閉環;生態上,開源 HiMarket 讓任何企業都能快速搭建自己的 AI 開發者門户,實現開發者與管理者的協同;成本上,Serverless 版把開通門檻降到“零實例費 + 按調用付費”,讓中小團隊也能零運維享受企業級 AI 流量治理。至此,AI 網關已不只是“流量網關”,而是 AI 時代的新型基礎設施:向下屏蔽異構算力與協議差異,向上支撐模型、工具、Agent 的統一編排、治理與安全,為正在落地的各類 AI 應用提供了可插拔、可擴展、可持續演進的堅實底座。