北京人形機器人創新中心有限公司(下文簡稱:北京人形)是國內首家省級人形機器人創新中心,聚焦於具身智能機器人核心技術、產品研發和應用落地,圍繞通用機器人平台「具身天工」和通用具身智能平台「慧思開物」兩大核心任務開展攻堅,致力於打造具有全球影響力的具身智能創新策源地和應用示範高地。

2024 年,北京人形發佈「天工1.0 LITE」,成為全球首個純電驅擬人奔跑的全尺寸人形機器人。同時,2025 年北京人形發佈全球首個通用具身智能平台「慧思開物」,支持多本體多場景應用,獲行業高度評價,引領產業協同創新。

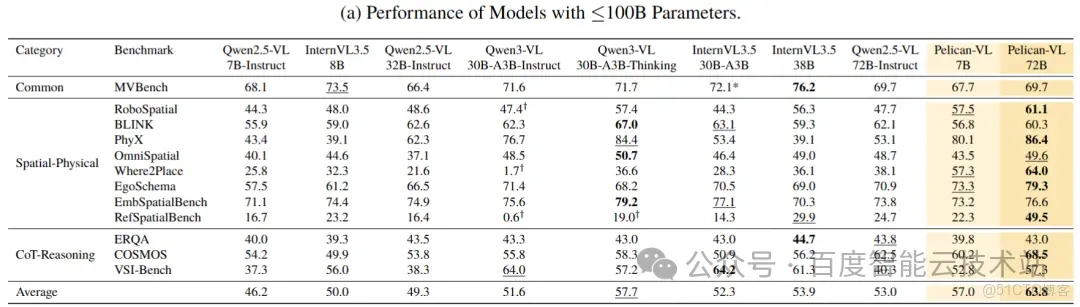

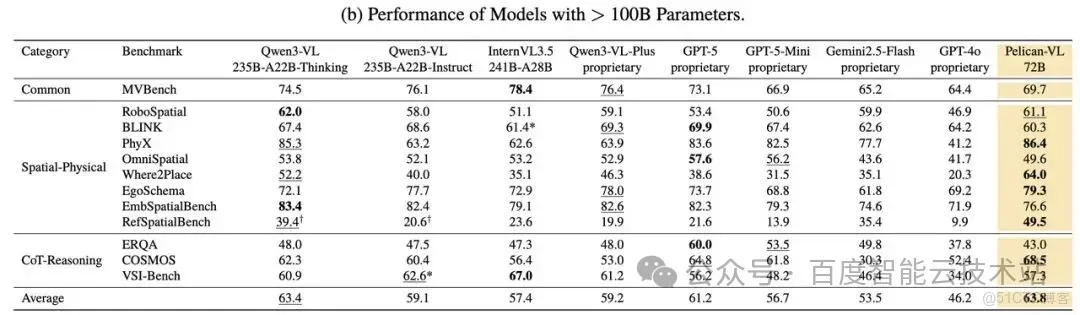

1. 規模最大,性能最好的開源具身多模態大模型

2025 年 11 月 14 日,北京人形機器人創新中心發佈了具身智能視覺-語言模型 Pelican-VL 1.0,並實現全面開源。該系列模型的核心優勢在於深度整合海量數據與自適應學習機制,覆蓋 7B、72B 參數規模,是「最大規模的開源具身多模態大模型」。在基線基礎上性能提升 20.3%,超過同級別開源模型 10.6%。

在研發 Pelican-VL 模型的過程中,北京人形採用了創新的訓練方案,通過 SFT 有監督微調與 RL 強化學習的高效迭代,提升模型性能。同時,為了縮短模型訓練時間,採用了千卡規模的集羣。在本次模型的研發中,北京人形調動各個團隊、跨部門的協作共享,確保模型研發高效推進與快速落地。

2. 面向行業的 AI Infra 解決方案

針對全新的模型和訓練方法,百度百舸聯合北京人形,構建了覆蓋「模型提效加速、訓練穩定性保障、企業級開發平台」的 AI Infra 具身智能解決方案,加速了 Pelican-VL 模型的落地。

2.1. 在 SFT 和 RL 各階段加速模型訓練

2.1.1. SFT 階段:多模態混訓 + 離線 Sequence Packing,提升訓練效率和 GPU 利用率

在多模態大模型 SFT 訓練任務,數據類型的異構性(如文本為序列、圖像為二維像素、視頻為多幀時序)和序列長度的巨大差異(視頻動輒上萬 token,文本通常僅數百 token)需要處理文本、圖像、視頻等異構數據,導致不同模態難以放入同一個 batch 中訓練,不僅造成大量 padding 浪費,還使得 GPU 負載無法對齊,訓練效率顯著降低。

針對這一情況,百度百舸聯合北京人形,實現並優化了文本、圖像、視頻多模態混訓的能力。同時,提供了利用 CPU 集羣進行離線 Sequence Packing 的能力,訓練時直接加載已處理好的數據,無需實時計算,釋放 GPU 集羣算力。該能力與模型的分佈式並行策略解耦,實現「一次預處理,多場景複用」。

依託雙方深度協作與多維度的優化,北京人形模型訓練效率和 GPU 資源利用率大幅提升,縮短了整體 SFT 的任務完成時間。

2.1.2. RL 階段:視頻上下文並行,縮短任務時間提升模型性能

在強化學習階段,高分辨率和高幀率採樣的視頻數據,將能有效縮短訓練數據,提升模型質量。

基於強化學習訓練框架,雙方聯合打造針對長序列(長視頻)的上下文並行解決方案。新增視頻 CP(上下文並行)切分機制,實現上下文線性拓展,並在 A800 環境中優化 attention 後端選擇,進一步提升訓練效率。

同時重構分片通信機制,解決「多模態混訓 + 視頻 CP」場景的穩定性問題,滿足北京人形高分辨率高幀率數據訓練的訴求。

相比社區原有方案,經過雙方共同論證的合理切分配置,北京人形業務中單段視頻支持的幀數上限、單幀最大分辨率上限均實現大幅突破,縮短訓練時間。同時顯存佔用更低,訓練曲線更加平穩。在模型效果上,在既有評測集上的準確率評分提升約 5%。

2.2. 千卡集羣自動容錯,保障集羣穩定運行

千卡級大規模 GPU 集羣的長時間運行,一定會遇上資源、任務等各類故障,由此導致任務的中斷。

百度百舸平台通過自動彈性容錯機制,保障千卡模型訓練 99.5% 有效訓練時長,確保北京人形 Pelican-VL 等大型模型訓練,在 1000+ A800 GPU 集羣訓練穩定進行,單次檢查點訓練超 50,000 A800 GPU-小時。

2.3. 建設企業級開發平台,支撐高效協作

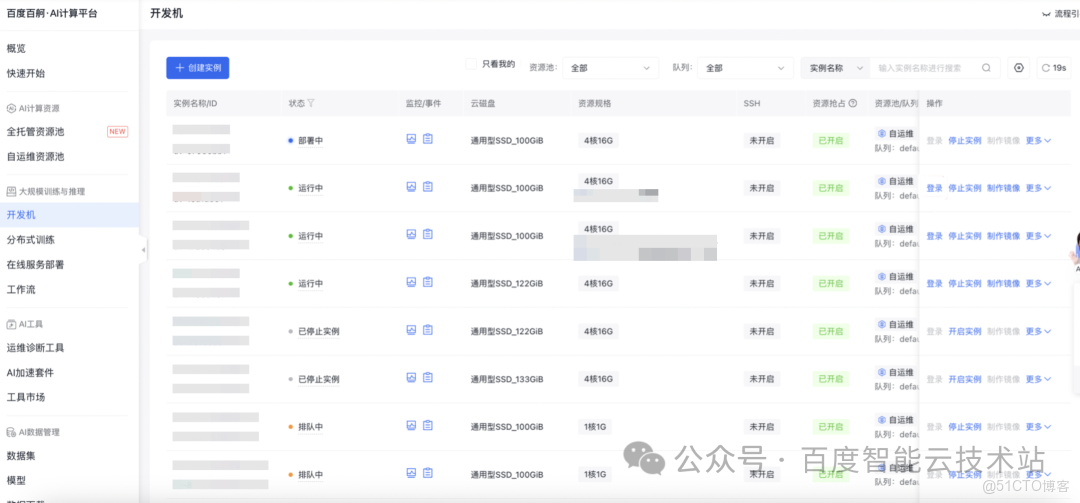

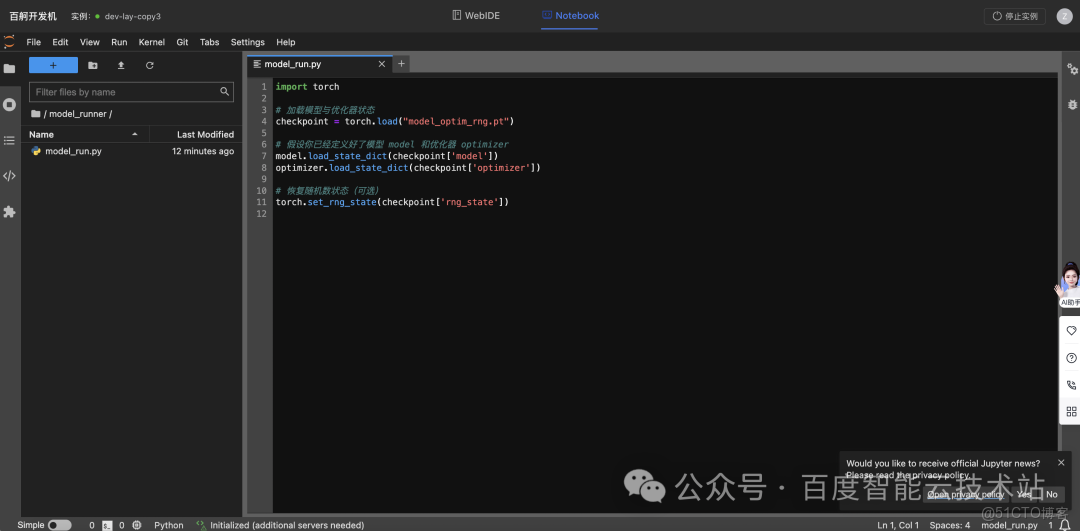

2.3.1. 一站式開發機,快速驗證模型上機效果,大幅提升研發效率

在 Pelican 的訓練過程中,縮短每次開發迭代的週期,成為加速模型落地的關鍵。

百度百舸的開發機內置 VSCode 等主流開發工具,滿足北京人形研發人員的基礎編碼與調試需求;集成 NVIDIA Isaac Sim 仿真軟件、RDT 開發框架、 ISAAC LAB 工具包等模型開發環境,實現開箱即用,將原本需要數天的環境搭建時間壓縮至分鐘級。

同時,支持開關機數據不丟失與多類型存儲適配,可在線打包鏡像並一鍵提交「鏡像 + 代碼 + 數據」至訓練集羣,快速響應大規模模型迭代需求,便於北京人形研發人員高效驗證上機效果,提升研發效率。

2.3.2. AI 數據資產管理,實現跨團隊安全、高效協同

高效的模型訓練需要數據、資源、運營等多團隊共同協同推進,團隊之間既需共用公共數據集,又有專屬數據的權限管理需求。多角色參與、多類型數據並存,導致 AI 資產查找繁瑣、協作效率低,且權限管控難度大。百度百舸對此提供了數據資產管理方案:

- 通過元數據、版本與細粒度權限統一管理,實現 AI 資產全生命週期安全可控。

- 提供統一資產目錄,減少工程師在資產查找、準備上的重複勞動,推動團隊協作標準化。

3. 總結

目前,Pelican-VL 1.0 已經上線百舸百舸平台,用户可以快速完成模型部署開展新的業務。未來,北京人形將持續深化與百度智能雲的合作,讓更多機器人在可見的未來中具備通用智能、靈活自適應的能力。

Pelican-VL 1.0 開源模型信息

- 主頁:https://pelican-vl.github.io/

- Github:https://github.com/Open-X-Humanoid/pelican-vl

- Huggingface:https://huggingface.co/collections/X-Humanoid/pelican-vl-10

- Modelscope:https://modelscope.cn/collections/Pelican10-VL-1036b65bbdfe46