通義深度研究:開源AI研究助手的新里程碑

最近AI研究領域有個很有意思的現象,就是那些最厲害的AI研究助手,比如OpenAI的DeepResearch、谷歌的Gemini DeepResearch,全都是閉源的。這就像大家都在説"我做出了很棒的東西",但就是不告訴你怎麼做的。阿里巴巴通義實驗室最近開源的通義深度研究(Tongyi DeepResearch)終於打破了這個局面,而且性能還相當能打。

為什麼需要開源的深度研究AI?

想象一下,你要寫一篇深度報告,需要在互聯網上搜索大量資料,整理歸納,最後形成結論。這個過程可能要花你好幾個小時。而深度研究AI就是要把這個時間壓縮到幾分鐘,讓AI自主完成多步驟推理和信息蒐集。

但問題來了,現在市面上能做這事兒的AI系統基本都是黑盒子。你不知道它們是怎麼訓練的,用了什麼數據,採用了什麼方法。這對整個學術界和開發者社區來説其實挺不友好的,因為沒法復現結果,也沒法在此基礎上繼續改進。

通義深度研究的出現就是為了解決這個問題。它不僅開源了模型,還把完整的訓練框架、數據合成方法全都公開了。更厲害的是,它在多個基準測試上都達到了最先進水平,證明開源也能做到業界頂尖。

核心創新:智能體訓練的新範式

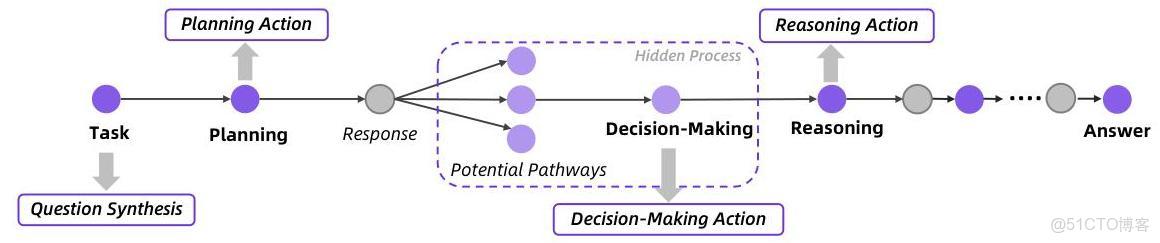

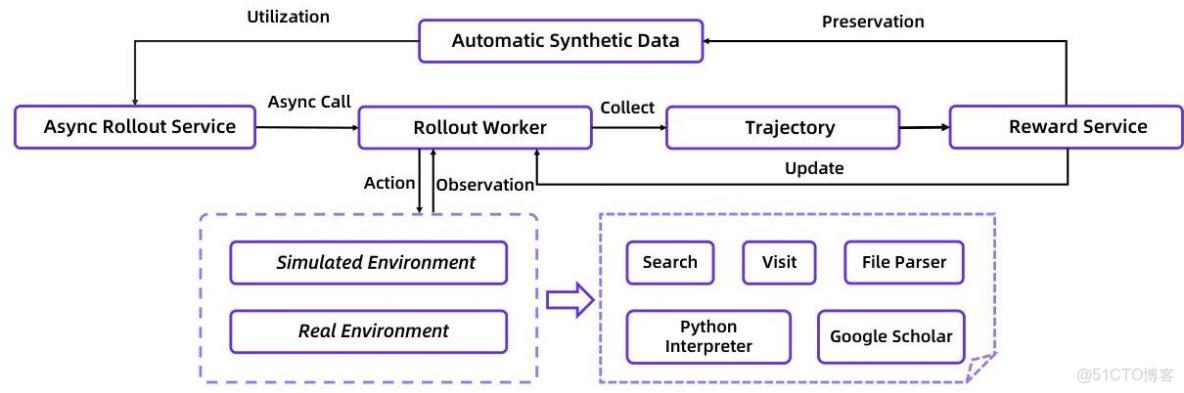

傳統的大語言模型訓練主要是讓模型學會"説話",但要讓它成為一個能自主研究的智能體,光會説話可不夠。通義深度研究提出了一個端到端的訓練框架,分成兩個關鍵階段。

智能體中期訓練:從"説話"到"做事"

第一階段叫"智能體中期訓練",這其實是在普通預訓練和專業智能體能力之間搭了一座橋。你可以把它理解成讓模型從"知道怎麼説"過渡到"知道怎麼做"。

這個階段最巧妙的地方是它的數據合成方式。研究團隊設計了一套完整的智能體工作流程模型,包括怎麼規劃任務、怎麼推理、怎麼做決策。然後通過自動化方式生成大量訓練數據,完全不需要人工標註。

比如説,系統會先生成各種研究領域的複雜問題,然後自動生成智能體應該如何把這個大問題分解成小步驟,每一步該做什麼推理,該調用什麼工具。這種數據不是簡單的問答對,而是完整的"思考-行動"序列,讓模型真正學會像研究人員一樣工作。

智能體後訓練:精益求精

第二階段包括監督微調和強化學習。這裏有個很有意思的設計叫"上下文管理模式"。

做深度研究的時候,上下文會越來越長——你要記住原始問題、已經收集的信息、正在寫的報告。如果不加處理,模型很容易"記不住"之前的內容。通義深度研究的做法是給智能體構建一個"工作空間",把最關鍵的信息(問題、當前報告、即時上下文)組織在一起,這樣既不會超出上下文限制,又能保持任務的連貫性。

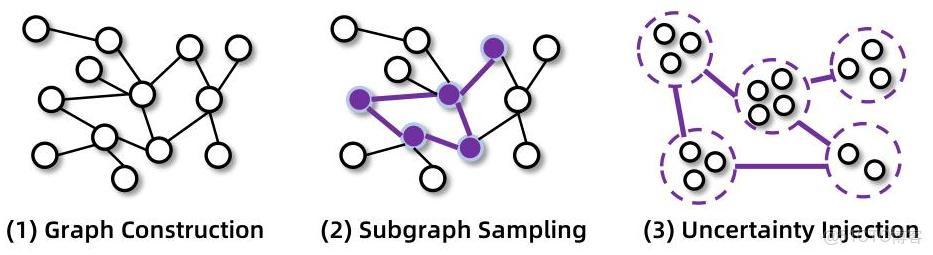

數據生成方面也很講究。系統先構建知識圖譜,然後從中採樣子圖,再故意增加一些不確定性和難度,生成真正有挑戰性的問題。這就像給學生出題,不能太簡單,要讓它動腦子才行。

強化學習:在三個世界裏訓練

強化學習階段的設計尤其巧妙。團隊設計了三種環境,每種都有各自的用途。

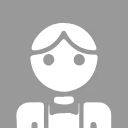

"先驗世界"是從模型自己的預訓練知識裏挖掘出來的,成本低、穩定性好,適合快速迭代。"模擬環境"提供可控的、可重現的交互,讓你能快速測試新想法。"真實世界"則直接接入谷歌搜索、網頁解析等真實工具,給模型提供真實反饋。

這三種環境配合使用,既保證了訓練的穩定性和效率,又確保模型能在真實場景中表現良好。就像飛行員訓練一樣,有模擬器練基本功,也要真機實飛積累經驗。

實戰表現:既強大又高效

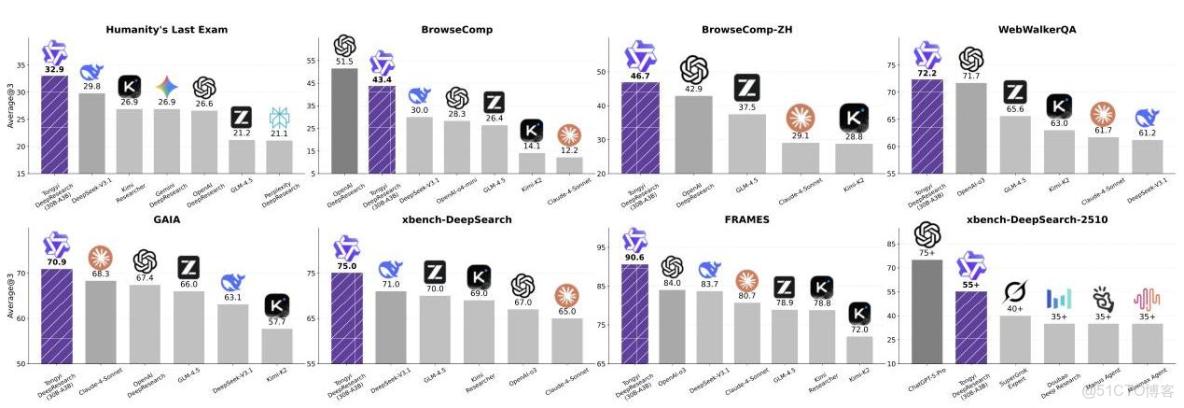

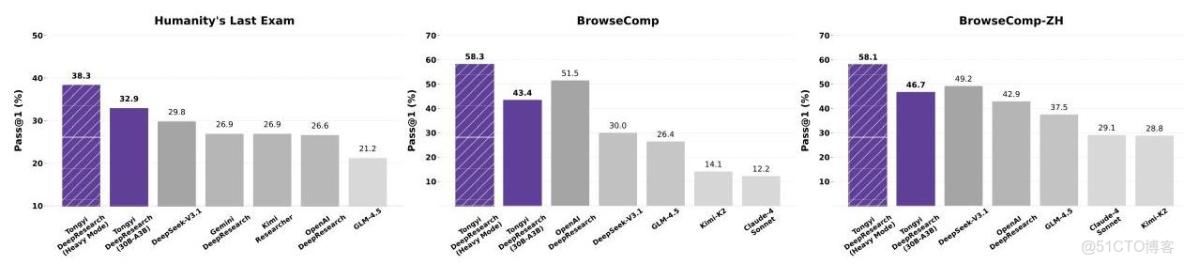

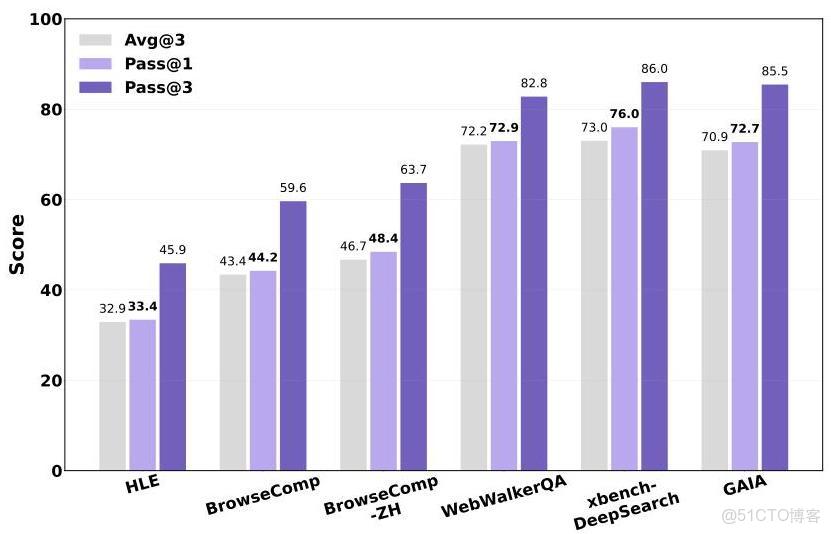

通義深度研究在多個高難度基準上都刷新了記錄。在"人類的最後考試"(Humanity’s Last Exam)這個超難的測試中,它拿到了32.9%的成績,聽起來不高,但要知道這個考試難到什麼程度——它包含的問題連人類專家都不一定能答對。

更讓人印象深刻的是效率。整個模型基於Qwen3-30B,總參數量305億,但每個token只激活33億參數。這意味着它能在相對普通的硬件上運行,不需要像某些大模型那樣動輒需要幾百張GPU卡。

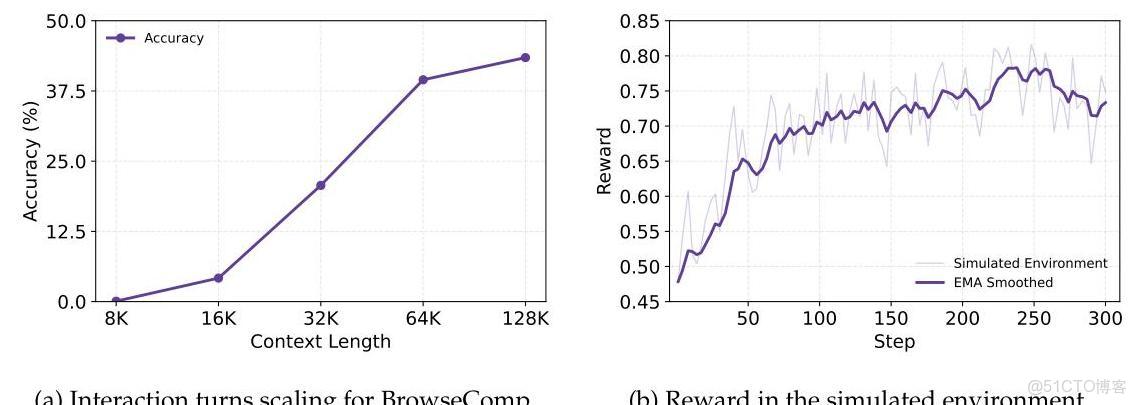

團隊還開發了一個"重度模式",簡單説就是同時跑多個智能體並行工作,最後把結果綜合起來。這種模式下,"人類的最後考試"的成績進一步提升到38.3%,在BrowseComp測試中達到58.3%。

訓練過程的穩定性

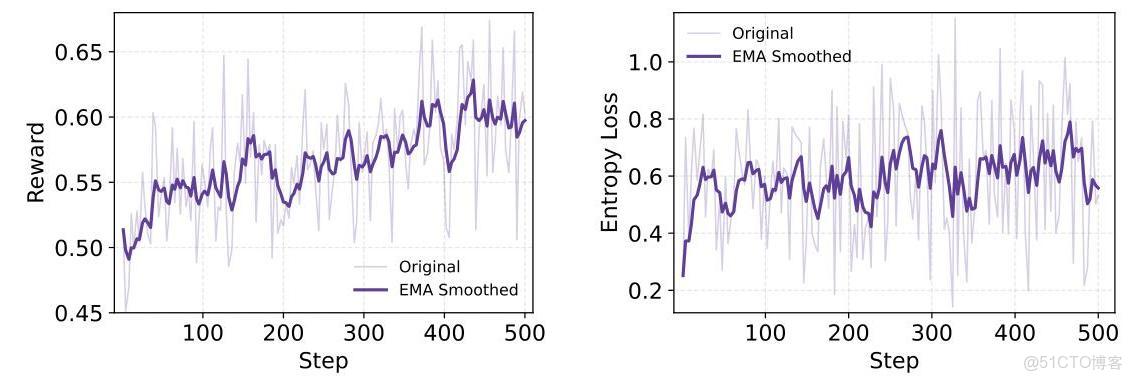

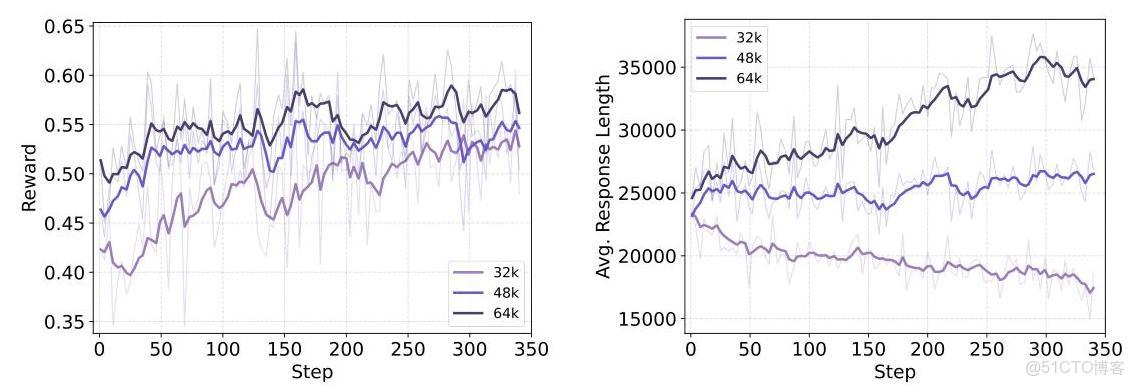

做強化學習最怕的就是訓練不穩定,策略容易崩潰。通義深度研究在這方面表現很穩健,從訓練曲線可以看出,獎勵穩步上升,策略熵(代表探索程度)保持一致,説明模型在學習過程中既能不斷進步,又不會忘記之前學到的東西。

研究團隊還做了很多實驗分析。比如上下文長度的影響——更長的上下文確實能帶來更高的性能上限,但有限上下文的模型也能找到更高效的解決方案。模擬環境和真實環境的獎勵曲線高度吻合,證明模擬環境確實是個有效的"實驗室"。

對AI研究的意義

通義深度研究的開源不僅僅是發佈一個模型那麼簡單,它代表了幾個重要的進步。

首先是方法論的突破。智能體中期訓練這個概念可能會成為未來訓練智能體模型的標準做法。它明確瞭如何讓語言模型從"能理解"到"能行動"。

其次是數據合成的創新。完全自動化的數據合成管道,不需要人工標註就能生成高質量、多樣化的訓練數據。這對很多領域的AI開發都有借鑑意義,畢竟人工標註又貴又慢。

再就是效率的提升。33億激活參數就能達到頂尖水平,這讓高級AI能力不再是少數人的專利。你不需要超級計算機,普通服務器就能跑。

最重要的是開放的態度。通過開源模型、框架和完整解決方案,通義深度研究為整個社區提供了一個可以在其基礎上繼續創新的平台。這才是真正推動技術進步的方式。

討論

通義深度研究讓我們看到了一個可能性:AI助手不僅能回答問題,還能真正像研究人員一樣工作——自主規劃研究路徑,蒐集和分析信息,最後形成有深度的結論。

這種能力的普及意味着什麼?對普通用户來説,可能意味着幾分鐘就能完成過去需要幾小時的研究工作。對研究人員來説,可以把精力放在更高層次的創造性思考上,讓AI處理信息收集和初步分析。對開發者來説,有了一個可以學習和改進的開源基礎。

當然,這還不是終點。通義深度研究是邁向通用人工智能的一步,但要讓AI真正能在各個領域自主推理和行動,還有很長的路要走。不過至少現在,這條路已經向所有人開放了。