1. 簡介:

主要是Andrew W.Moore 的課件Predicting real-valued outputs: an introduction to regression學習筆記(逐步完成)。

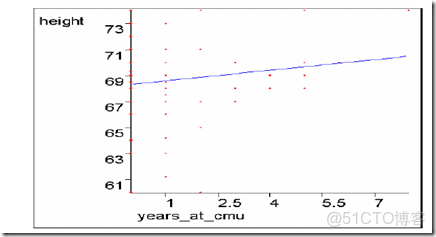

2. 單一參數線性迴歸 single parameter linear regression

前面關於PRML第一章學習筆記中已經貼了該部分。注意最後的最優求解很簡單,按照偏導數=0。

對應最小值的

然後可以利用這個

來預測新值。

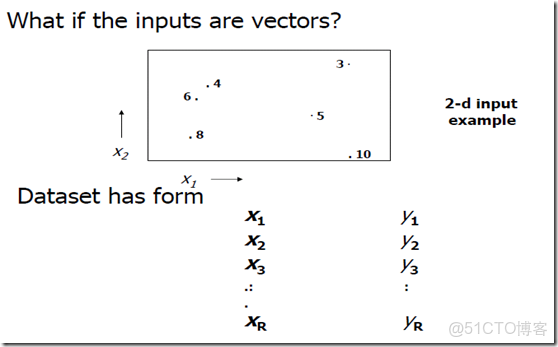

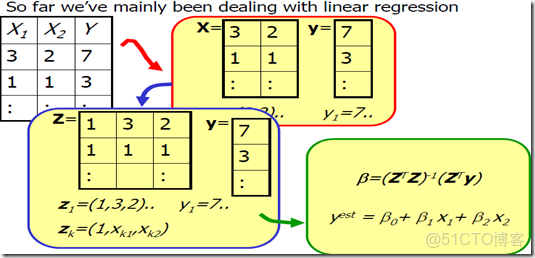

3. 多元線性迴歸

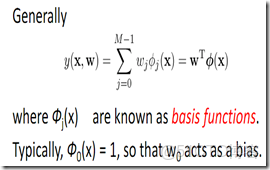

注意前面PRML中曲線擬合的例子,輸入可不是多元的,仍然是f(X)->Y,X,Y都是單一變量而不是vector(不過參數W是多元的而已)。當然從basis function的角度來看其實也是一樣的可以看做多元迴歸。

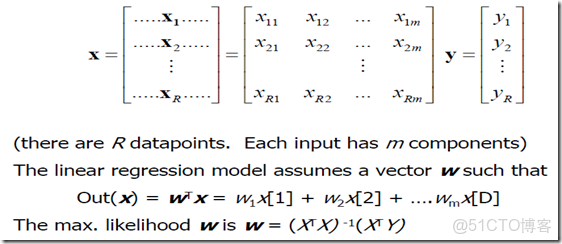

為什麼取得最大可能對應的 是上面那個樣子呢?其實這是一個最小二乘問題,也是線性方程組求解問題。設上圖關於R個訓練輸入數據,每個數據有m個輸入維度的矩陣是

=

如果

的解空間包含

,那麼

方程是有解的。這個時候可以説對應的

使得對於訓練數據的逼近最好,誤差為0。那麼如果解空間不存在

呢,那麼我們只能儘可能的調整

使得

最小。我們求得的

是

中最接近

的向量。參考<<線性代數及其應用>>p359,

應該是

向

的列空間的投影。

正交投影

是唯一的,當

的列是線性無關的時候則有唯一的最小二乘解,即上面圖中給出的。

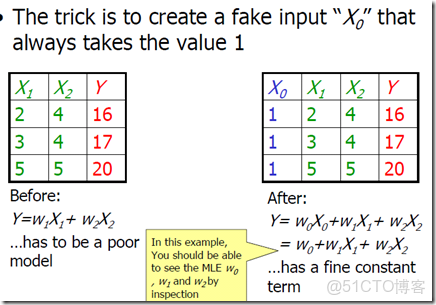

4. 線性迴歸中的常量

考慮一元線性迴歸,不穿過原點的情況,通常的做法是對數據的輸入維度增加一個

,其取值固定為1。

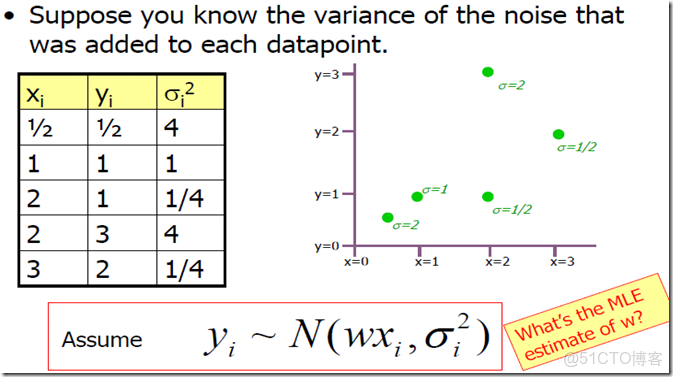

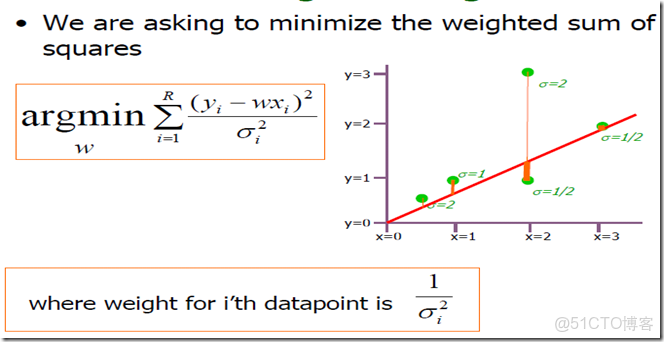

5. 異方差性:線性迴歸with varing noise

假設你知道加在每個數據點上的噪聲的方差。如何利用MLE估計w?

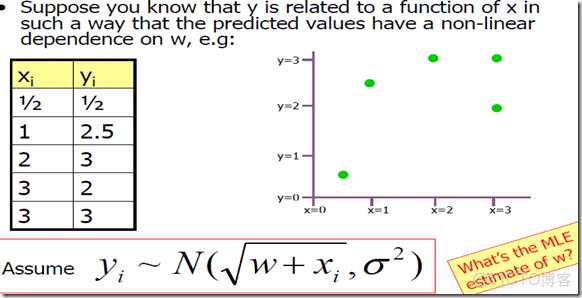

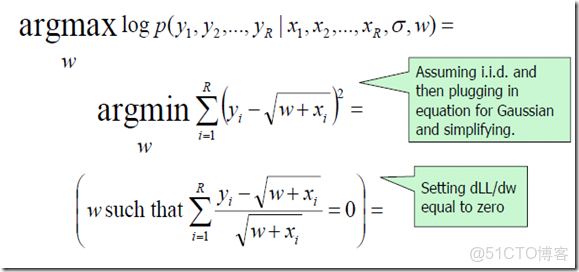

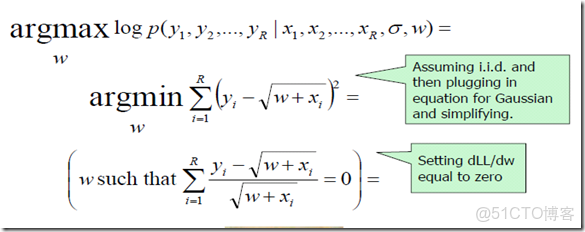

6. 非線性迴歸(Non-linear Regression)

假定你知道y和x的關係是一個有關w的非線性依賴關係。如何通過MLE估計W?

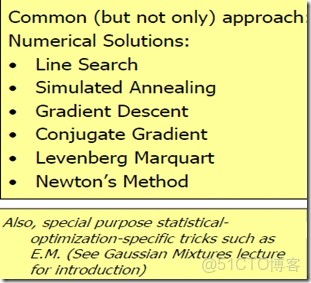

常用的一些方法

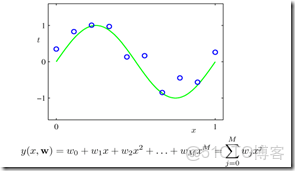

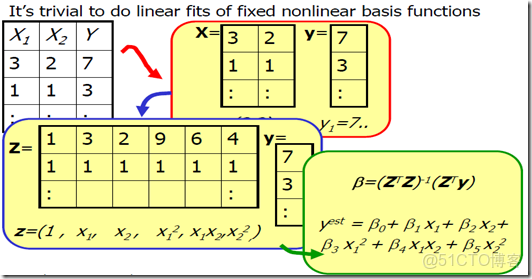

7. 多項式迴歸(Polynomial Regression)

下面第二個圖給出了例子,即增加了類似

的項,考慮PRML中給出的多項式曲線擬合,那個應該是屬於一個1維input的M,order的情況。