2025 年 7 月 2 日,智譜 AI 聯合清華大學團隊發佈開源視覺語言模型 GLM-4.1V-9B-Thinking,專為複雜認知與推理任務打造。該模型基於 GLM-4-9B-0414 基座模型,支持圖像、視頻、文檔等多模態輸入,採用創新的「思考範式」設計。

這款模型名字有點長,我們拆開來看:

- GLM-4.1V → 新一代多模態模型框架

- 9B → 參數量約 90 億,屬於輕量級「實力派」

- Thinking → 代表它在視覺理解中引入了鏈式思維推理,不止回答,還會「思考過程」

其核心技術亮點是引入課程採樣強化學習,系統性提升模型在多階段推理與理解任務中的表現。GLM-4.1V-9B-Thinking 在 18 個榜單任務中持平甚至超過 8 倍參數量的 Qwen-2.5-VL-72B,達到 10B 參數級別的視覺語言模型的最強性能。

本教程支持文本對話,圖片、視頻、PDF、PPT理解

教程鏈接:https://go.openbayes.com/qEjWR

使用雲平台: OpenBayes

http://openbayes.com/console/signup?r=sony_0m6v

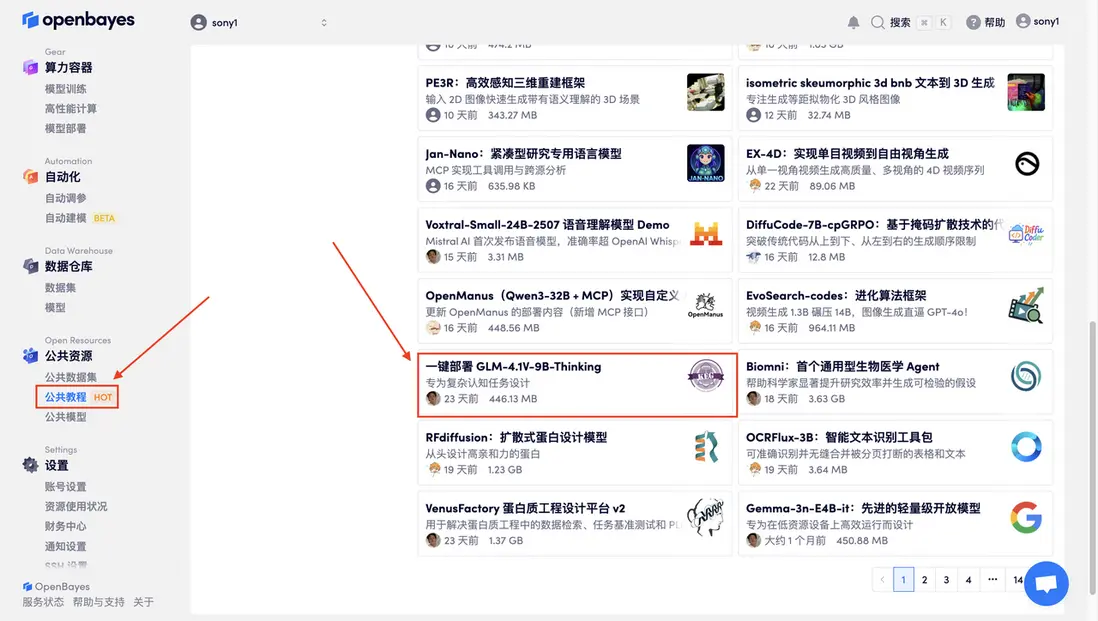

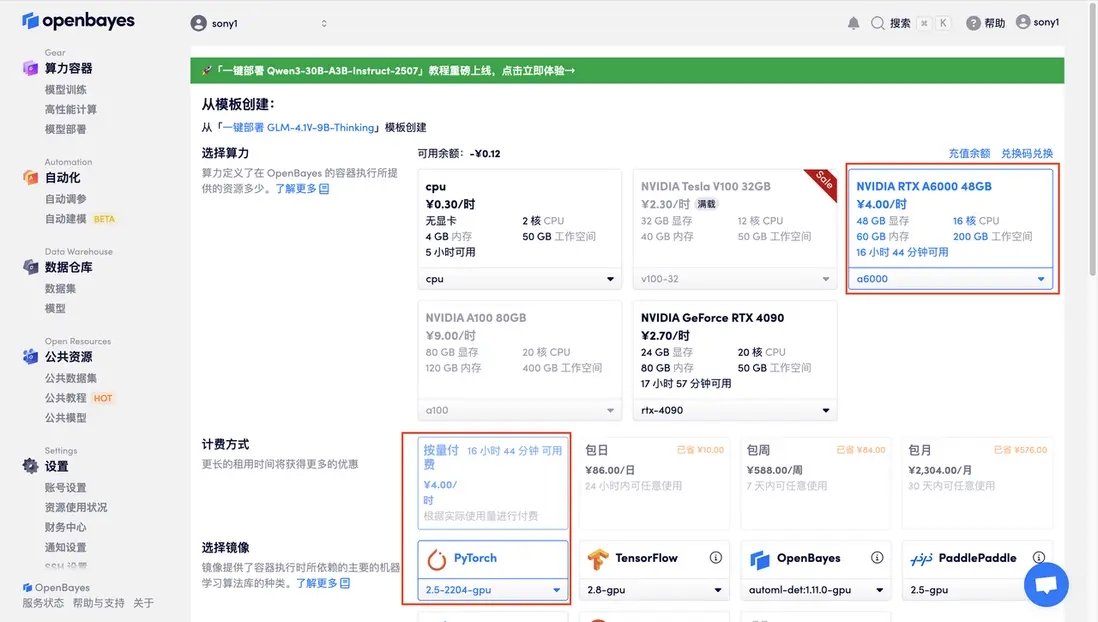

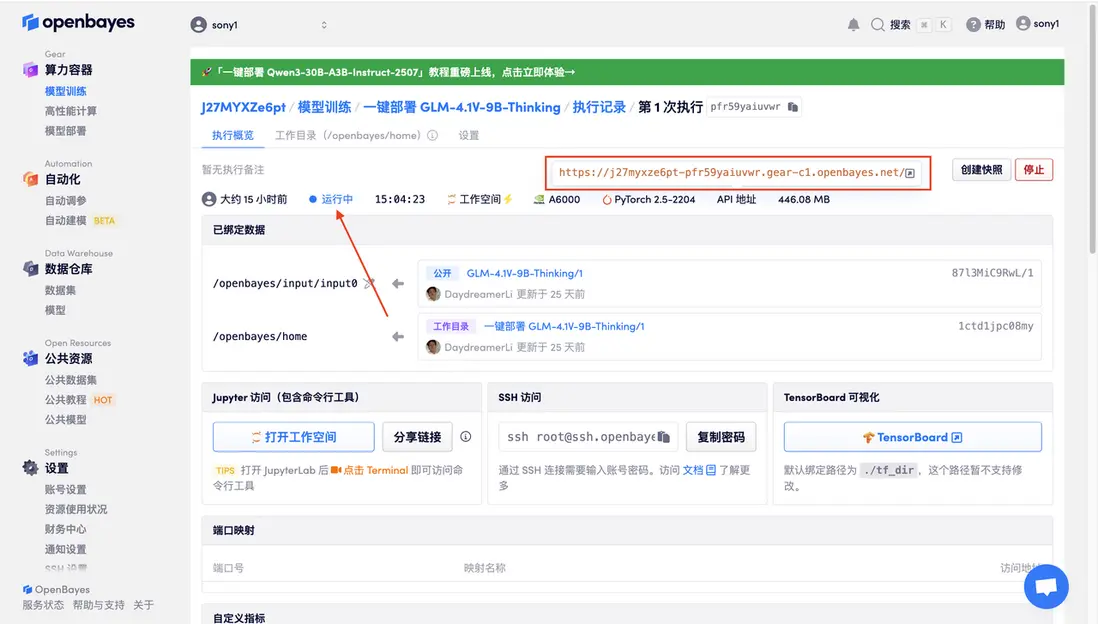

首先點擊「公共教程」,在公共教程中找到「一鍵部署 GLM-4.1V-9B-Thinking」,單擊打開。

頁面跳轉後,點擊右上角「克隆」,將該教程克隆至自己的容器中。

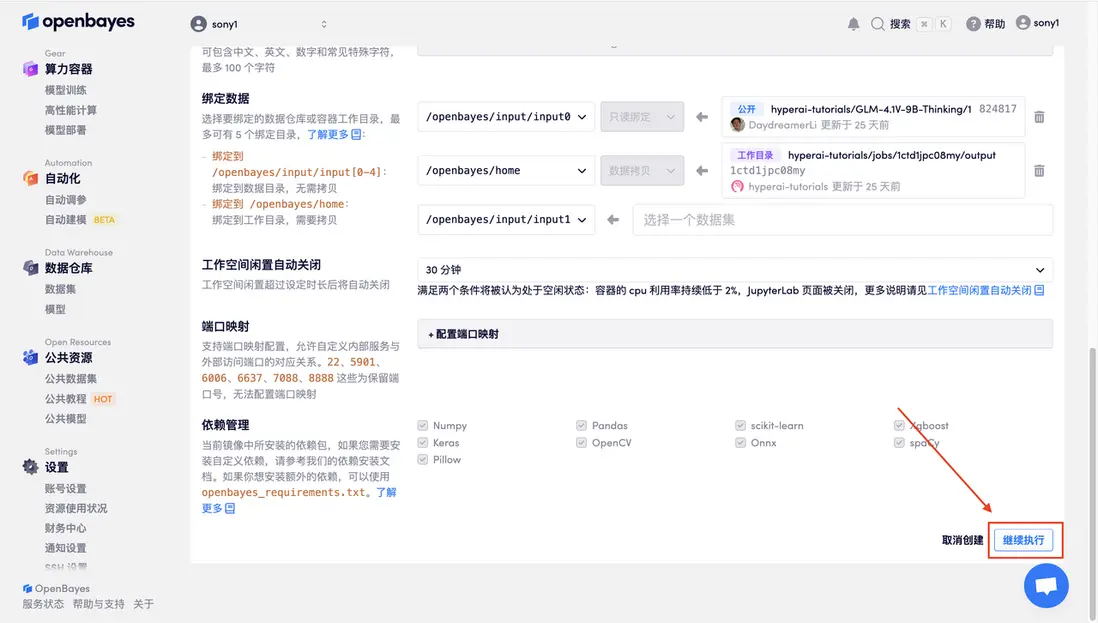

在當前頁面中看到的算力資源均可以在平台一鍵選擇使用。平台會默認選配好原教程所使用的算力資源、鏡像版本,不需要再進行手動選擇。點擊「繼續執行」,等待分配資源。

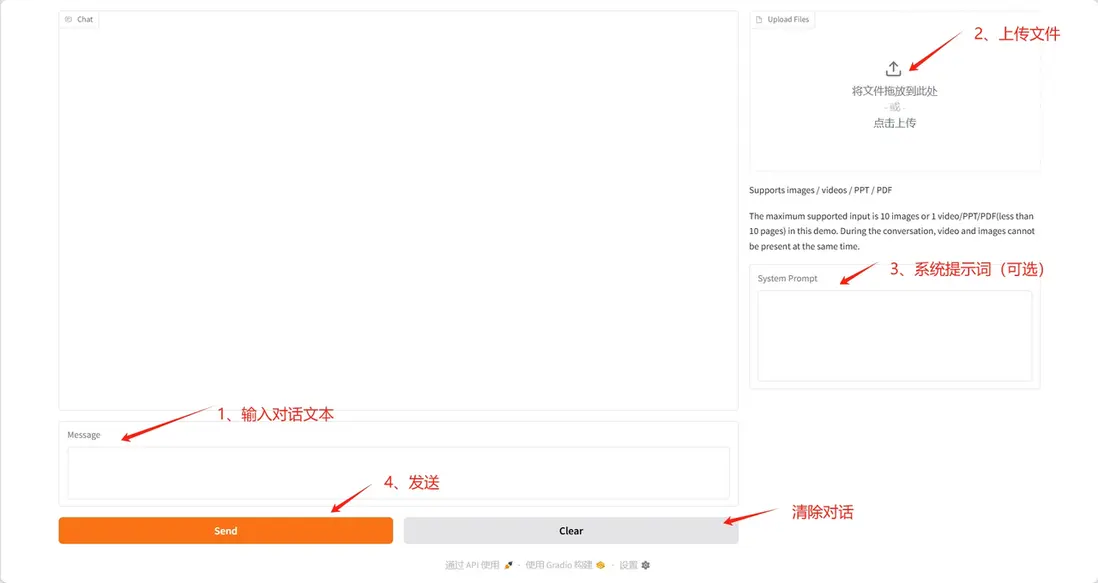

數據和代碼都已經同步完成了。容器狀態顯示為「運行中」後,點擊「 API 地址」,即可進入模型界面。

若顯示「Bad Gateway 」,這表示模型正在初始化,由於模型較大,請等待約 2-3 分鐘後刷新頁面。

上傳的視頻最好不超過 10 秒,PDF 和 PPT 不超過 10 頁,在對話過程中,視頻和圖片不能同時存在。建議每完成一次對話都點擊「Clear」進行清除操作。

該模型支持文本對話,圖片、視頻、PDF、PPT 理解功能,下面是各功能展示 。

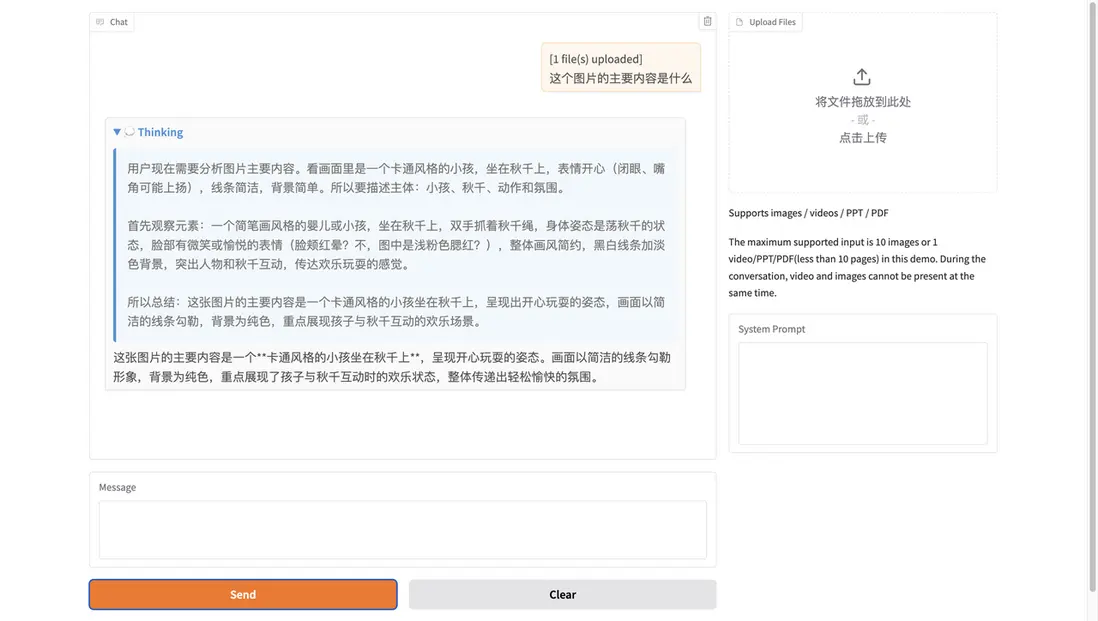

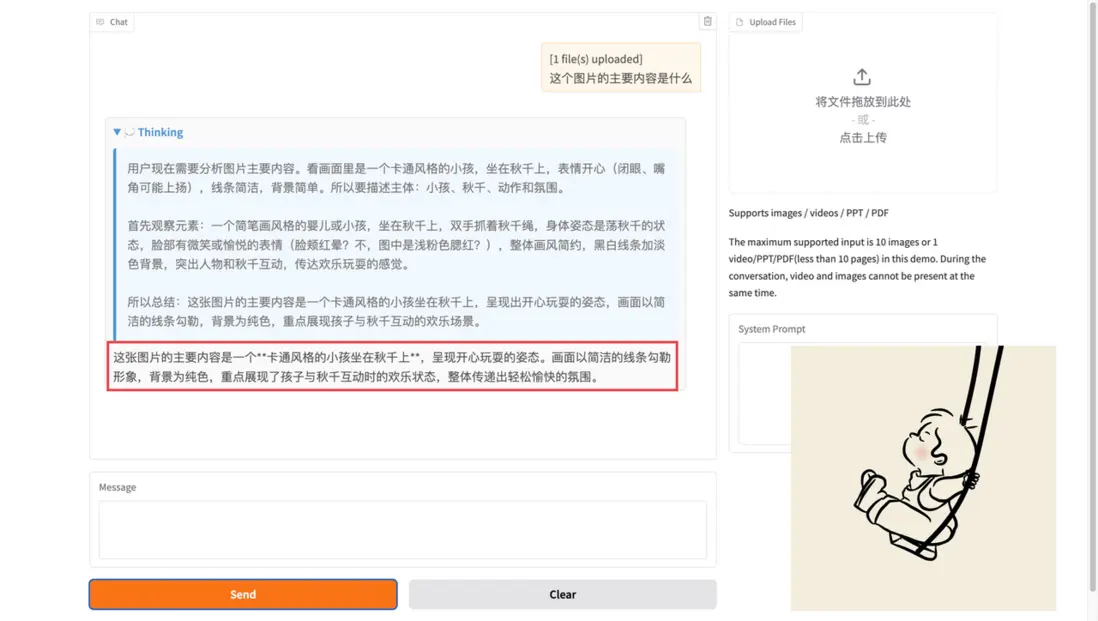

圖片理解

上傳圖片到模型中,輸入 Message「這個圖片的主要內容是什麼」,點擊「Send」開始運行,可以看到模型很快給出了圖片的主要內容,圖片內容是卡通風格的小孩坐在鞦韆上。

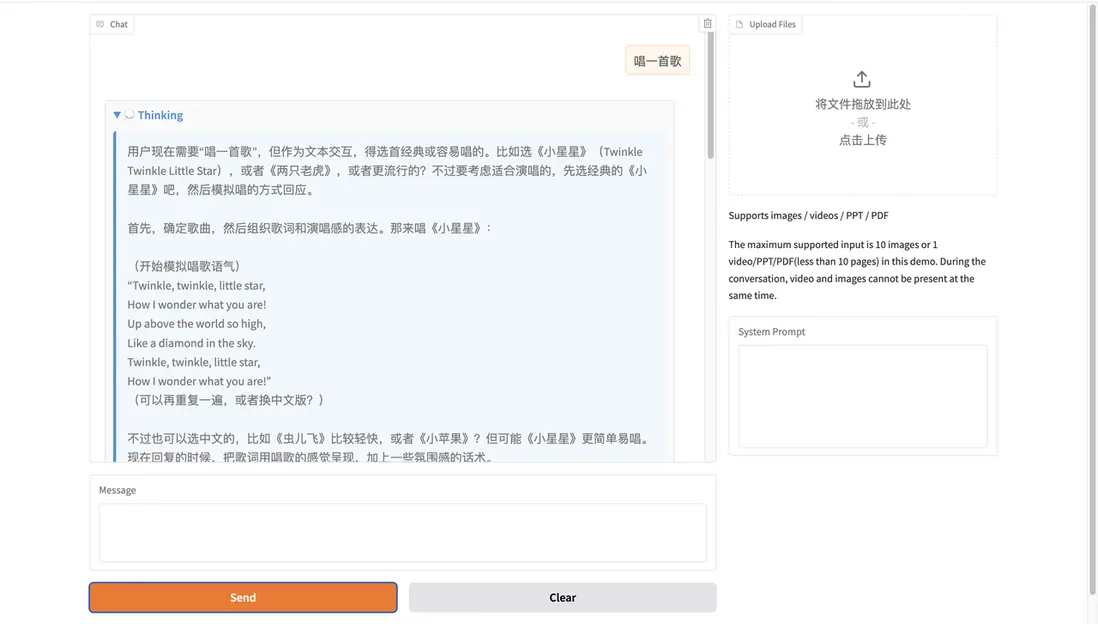

文本對話

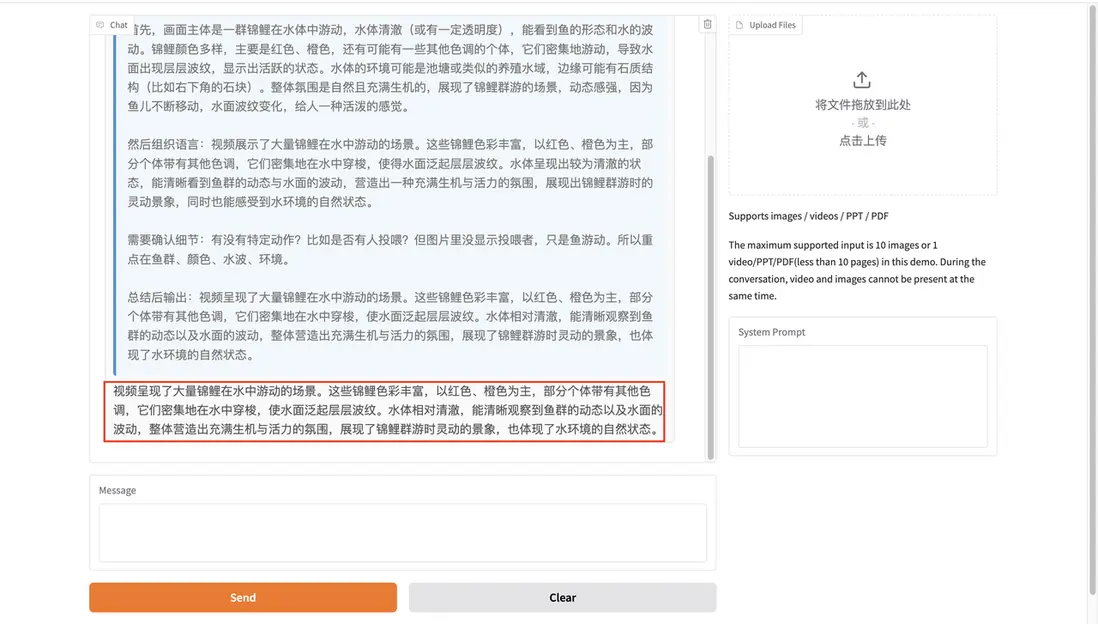

視頻理解

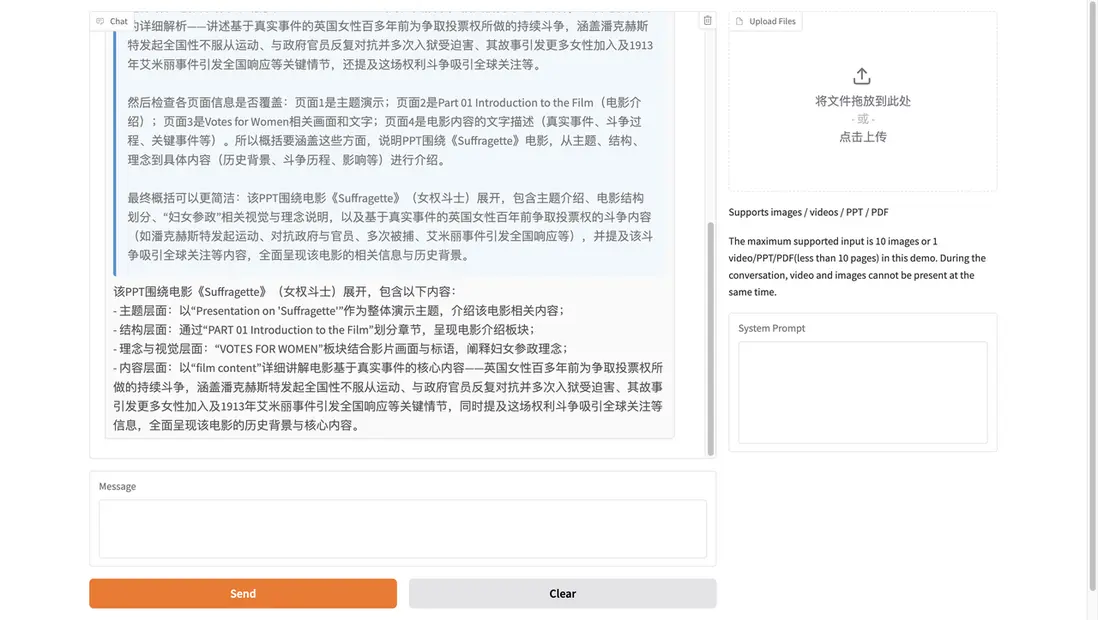

PDF 理解

PPT 理解