視頻演示

基於深度學習的無人機視角檢測系統

1. 前言

無人機憑藉其靈活性強、成本低、視角獨特等優勢,已成為環境監測、交通管理、農業勘測等領域的重要工具。然而,無人機航拍圖像中的目標往往尺寸較小、分佈密集,且常受到光照變化、複雜背景及運動模糊等因素干擾,導致檢測難度顯著增加。傳統的目標檢測算法在應對此類場景時,常出現漏檢、誤檢及實時性不足等問題。因此,開發一種高效、精準的無人機小目標檢測系統具有重要的研究價值與應用前景。

近年來,基於深度學習的目標檢測算法取得了突破性進展。其中,YOLO系列算法以其高效的檢測速度和良好的精度平衡,在實時檢測任務中表現突出。從YOLOv5到最新版本,該系列算法通過結構優化、特徵融合等技術,持續提升了小目標的檢測能力。然而,不同版本的YOLO模型在特定場景下的性能差異尚未得到充分比較與驗證。此外,現有的檢測系統多側重於算法本身,缺乏友好的人機交互界面與多功能集成,限制了其在實際場景中的部署與應用。

為此,本研究設計並實現了一套基於YOLO算法的無人機視覺小目標檢測系統。該系統不僅支持圖片、視頻、文件夾批量處理及實時攝像頭檢測等多種輸入方式,還集成了用户管理、模型切換、結果過濾與詳細分析等交互功能。通過對比YOLOv5、YOLOv8、YOLOv11及YOLOv12四個版本的模型性能,系統能夠針對不同場景靈活選擇最優檢測模型。同時,系統提供了完整的訓練與評估腳本,支持用户自定義數據集的模型訓練與優化。

本文後續章節將詳細介紹系統的設計與實現:第二章闡述系統整體架構與功能模塊;第三章分析多版本YOLO模型的訓練與對比結果;第四章展示系統在不同檢測任務中的實際效果;第五章總結系統優勢與未來改進方向。本研究旨在為無人機小目標檢測提供一套實用、高效的解決方案,併為相關領域的算法選擇與系統開發提供參考。

2. 項目演示

2.1 用户登錄界面

登錄界面佈局簡潔清晰,左側展示系統主題,用户需輸入用户名、密碼及驗證碼完成身份驗證後登錄系統。

2.2 新用户註冊

註冊時可自定義用户名與密碼,支持上傳個人頭像;如未上傳,系統將自動使用默認頭像完成賬號創建。

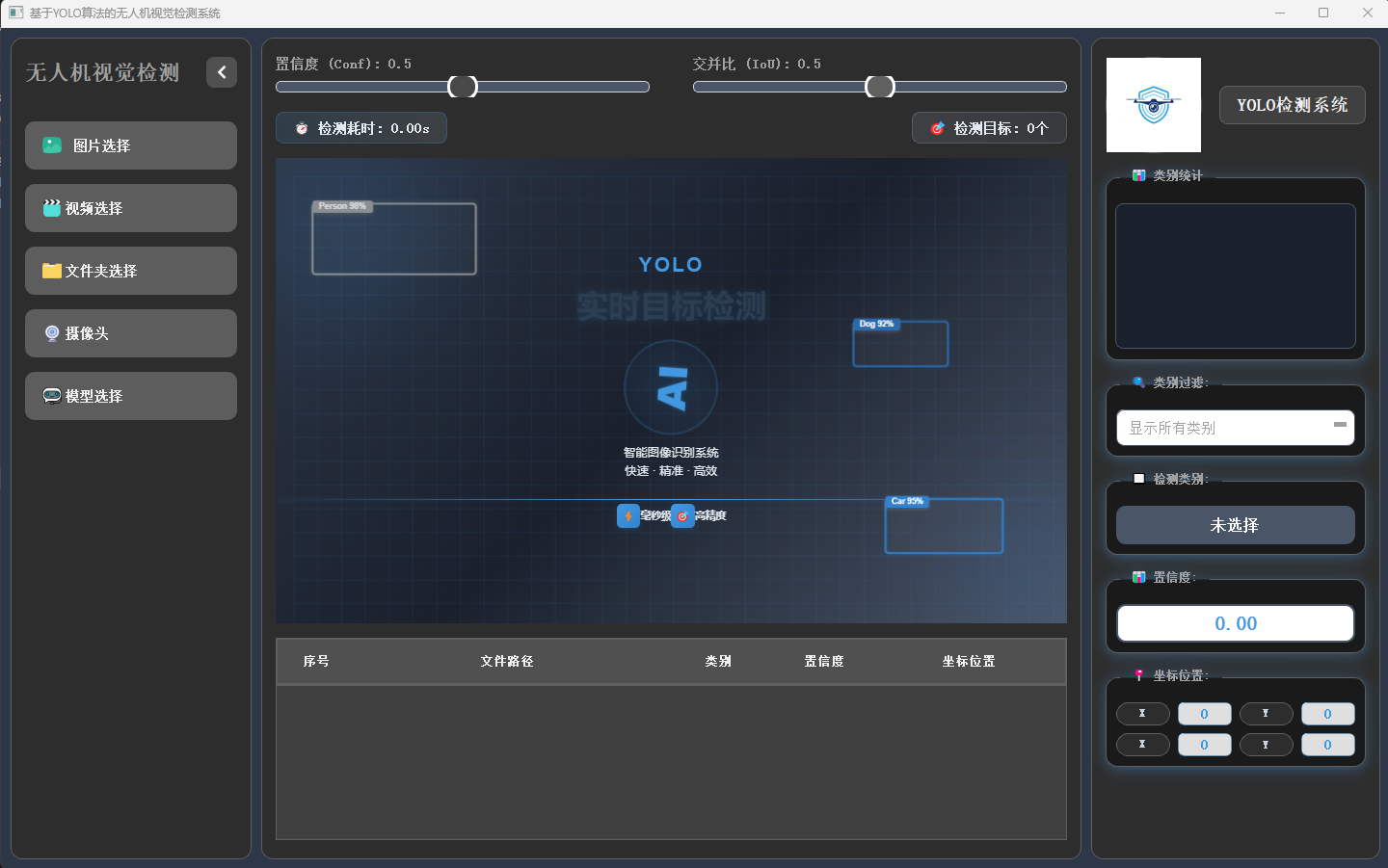

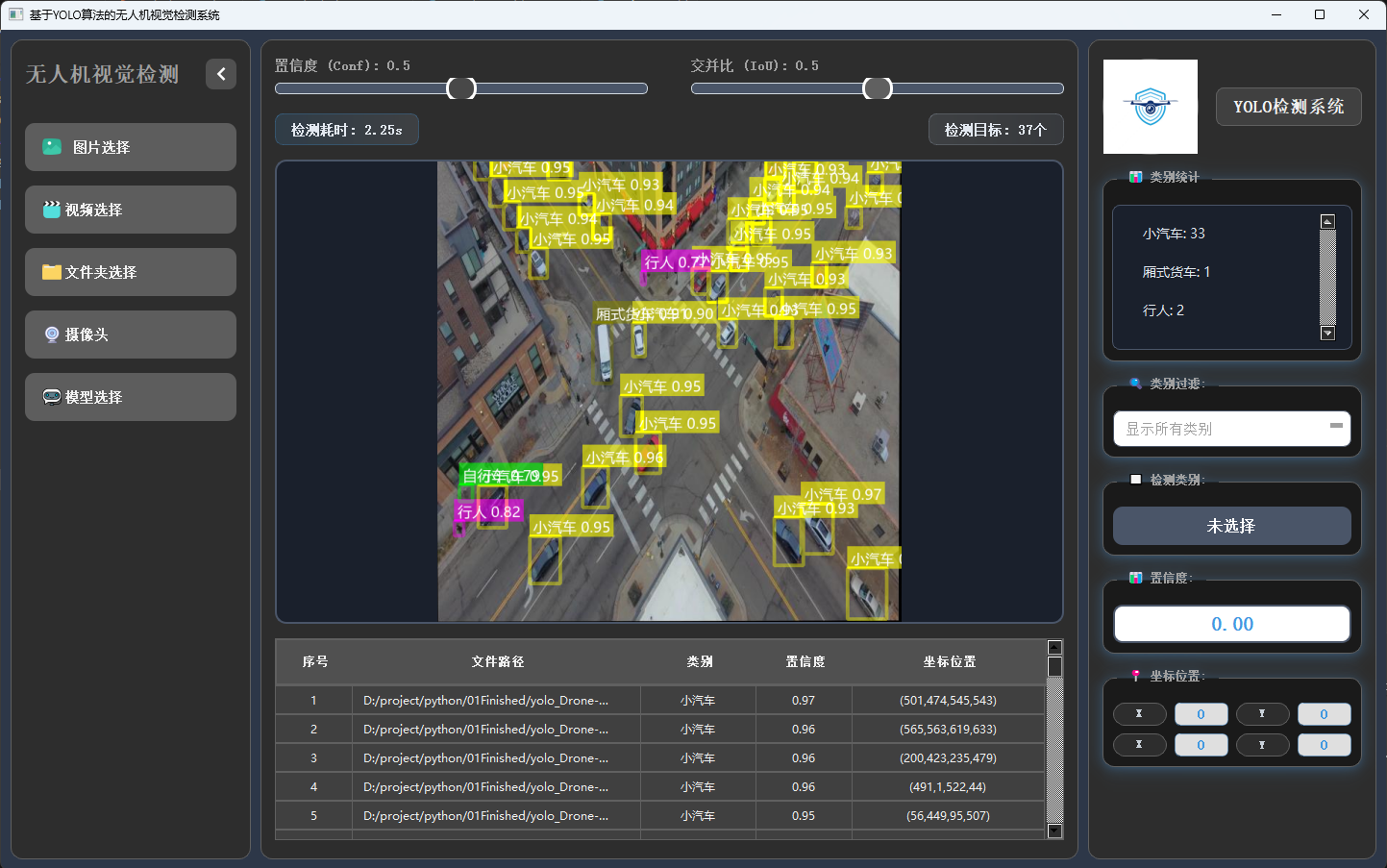

2.3 主界面佈局

主界面採用三欄結構,左側為功能操作區,中間用於展示檢測畫面,右側呈現目標詳細信息,佈局合理,交互流暢。

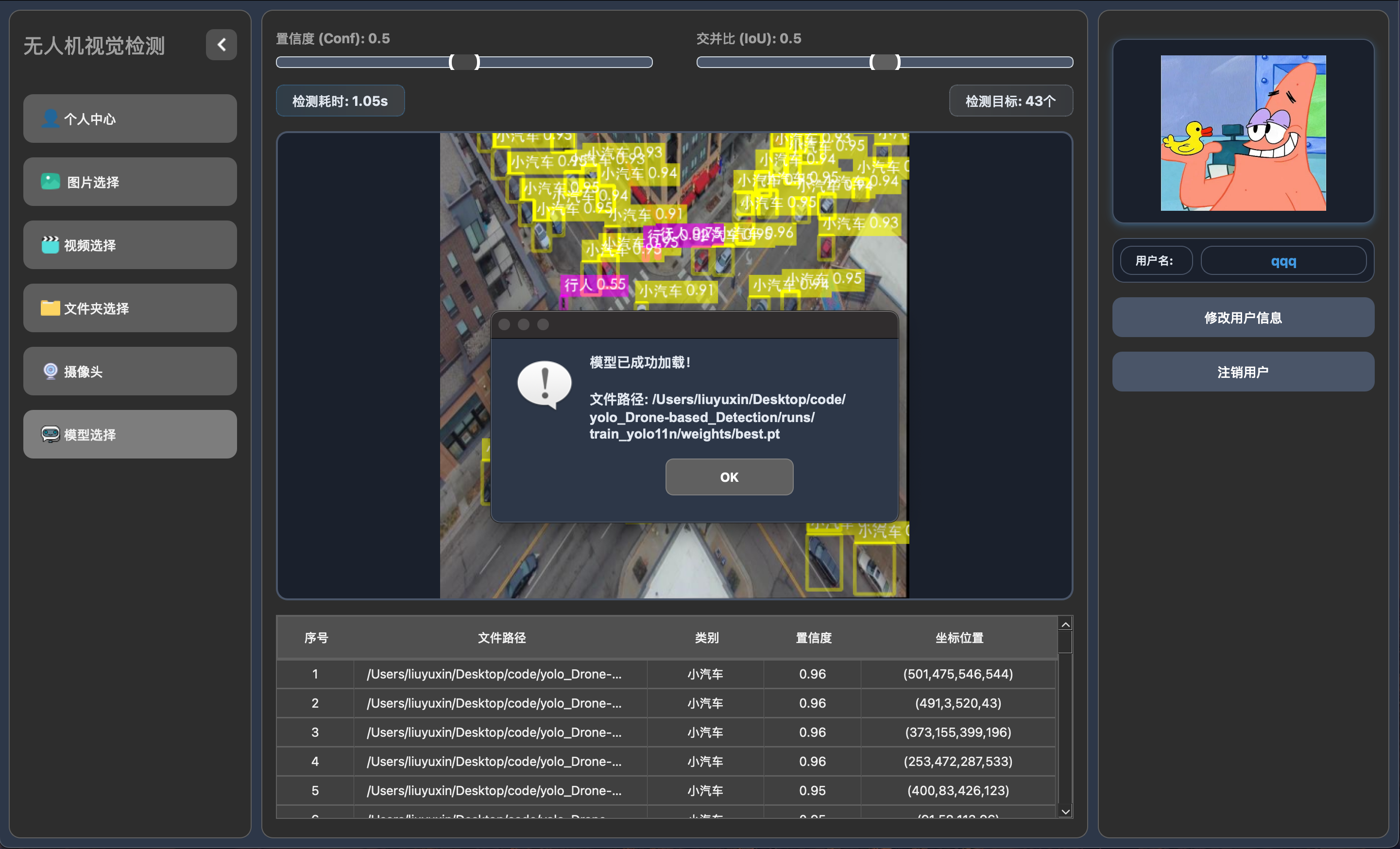

2.4 個人信息管理

用户可在此模塊中修改密碼或更換頭像,個人信息支持隨時更新與保存。

2.5 多模態檢測展示

系統支持圖片、視頻及攝像頭實時畫面的目標檢測。識別結果將在畫面中標註顯示,並在下方列表中逐項列出。點擊具體目標可查看其類別、置信度及位置座標等詳細信息。

2.6 多模型切換

系統內置多種已訓練模型,用户可根據實際需求靈活切換,以適應不同檢測場景或對比識別效果。

3.模型訓練核心代碼

本腳本是YOLO模型批量訓練工具,可自動修正數據集路徑為絕對路徑,從pretrained文件夾加載預訓練模型,按設定參數(100輪/640尺寸/批次8)一鍵批量訓練YOLOv5nu/v8n/v11n/v12n模型。

4. 技術棧

-

語言:Python 3.10

-

前端界面:PyQt5

-

數據庫:SQLite(存儲用户信息)

-

模型:YOLOv5、YOLOv8、YOLOv11、YOLOv12

5. YOLO模型對比與識別效果解析

5.1 YOLOv5/YOLOv8/YOLOv11/YOLOv12模型對比

基於Ultralytics官方COCO數據集訓練結果:

|

模型 |

尺寸(像素) |

mAPval 50-95 |

速度(CPU ONNX/毫秒) |

參數(M) |

FLOPs(B) |

|---|---|---|---|---|---|

|

YOLO12n |

640 |

40.6 |

- |

2.6 |

6.5 |

|

YOLO11n |

640 |

39.5 |

56.1 ± 0.8 |

2.6 |

6.5 |

|

YOLOv8n |

640 |

37.3 |

80.4 |

3.2 |

8.7 |

|

YOLOv5nu |

640 |

34.3 |

73.6 |

2.6 |

7.7 |

關鍵結論:

-

精度最高:YOLO12n(mAP 40.6%),顯著領先其他模型(較YOLOv5nu高約6.3個百分點);

-

速度最優:YOLO11n(CPU推理56.1ms),比YOLOv8n快42%,適合實時輕量部署;

-

效率均衡:YOLO12n/YOLO11n/YOLOv8n/YOLOv5nu參數量均為2.6M,FLOPs較低(YOLO12n/11n僅6.5B);YOLOv8n參數量(3.2M)與計算量(8.7B)最高,但精度優勢不明顯。

綜合推薦:

-

追求高精度:優先選YOLO12n(精度與效率兼顧);

-

需高速低耗:選YOLO11n(速度最快且精度接近YOLO12n);

-

YOLOv5nu/YOLOv8n因性能劣勢,無特殊需求時不建議首選。

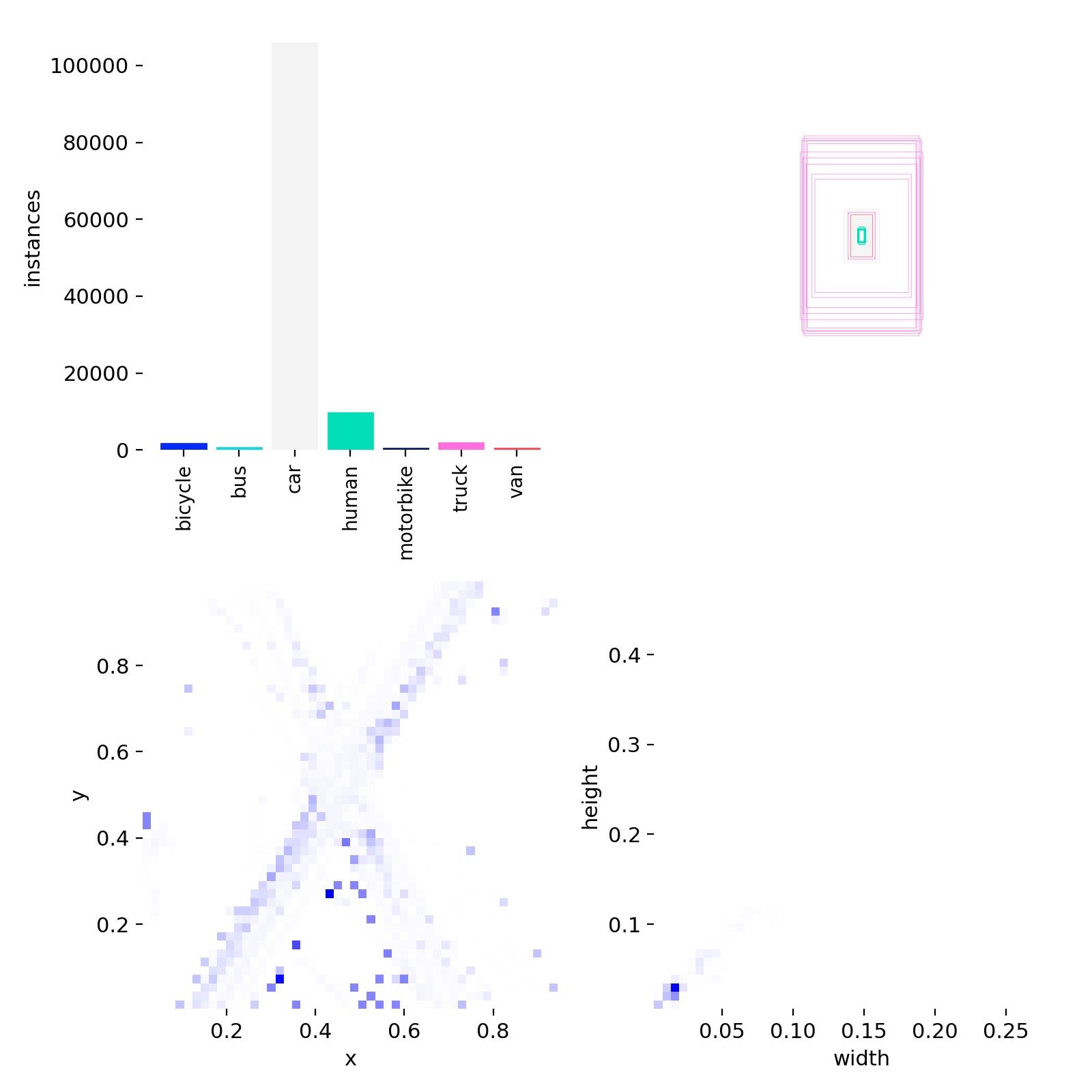

5.2 數據集分析

數據集中訓練集和驗證集一共2400多張圖片,數據集目標類別7種:自行車、公共汽車、小汽車、行人、摩托車、卡車、廂式貨車,數據集配置代碼如下:

上面的圖片就是部分樣本集訓練中經過數據增強後的效果標註。

5.3 訓練結果

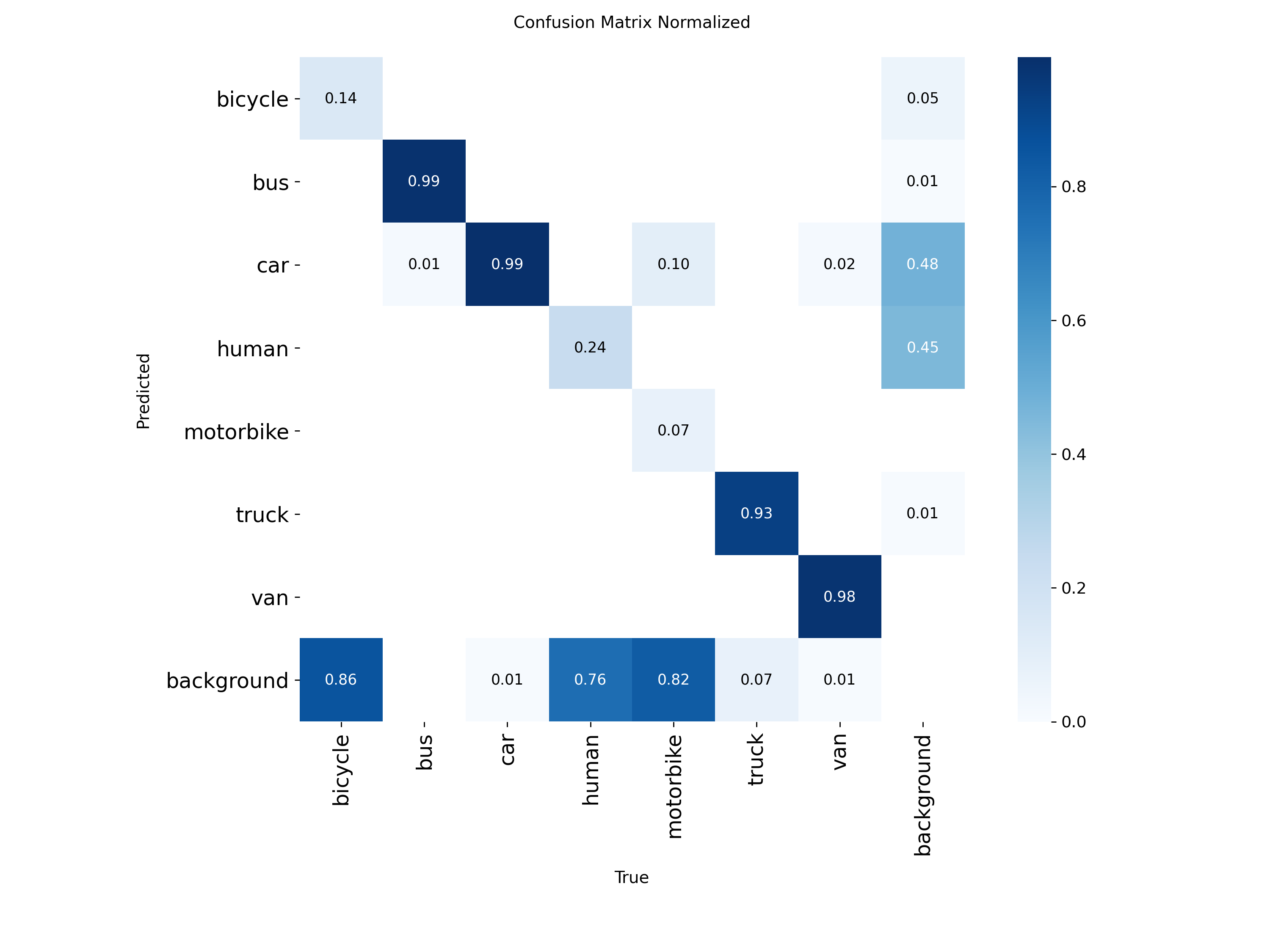

混淆矩陣顯示中識別精準度顯示是一條對角線,方塊顏色越深代表對應的類別識別的精準度越高。

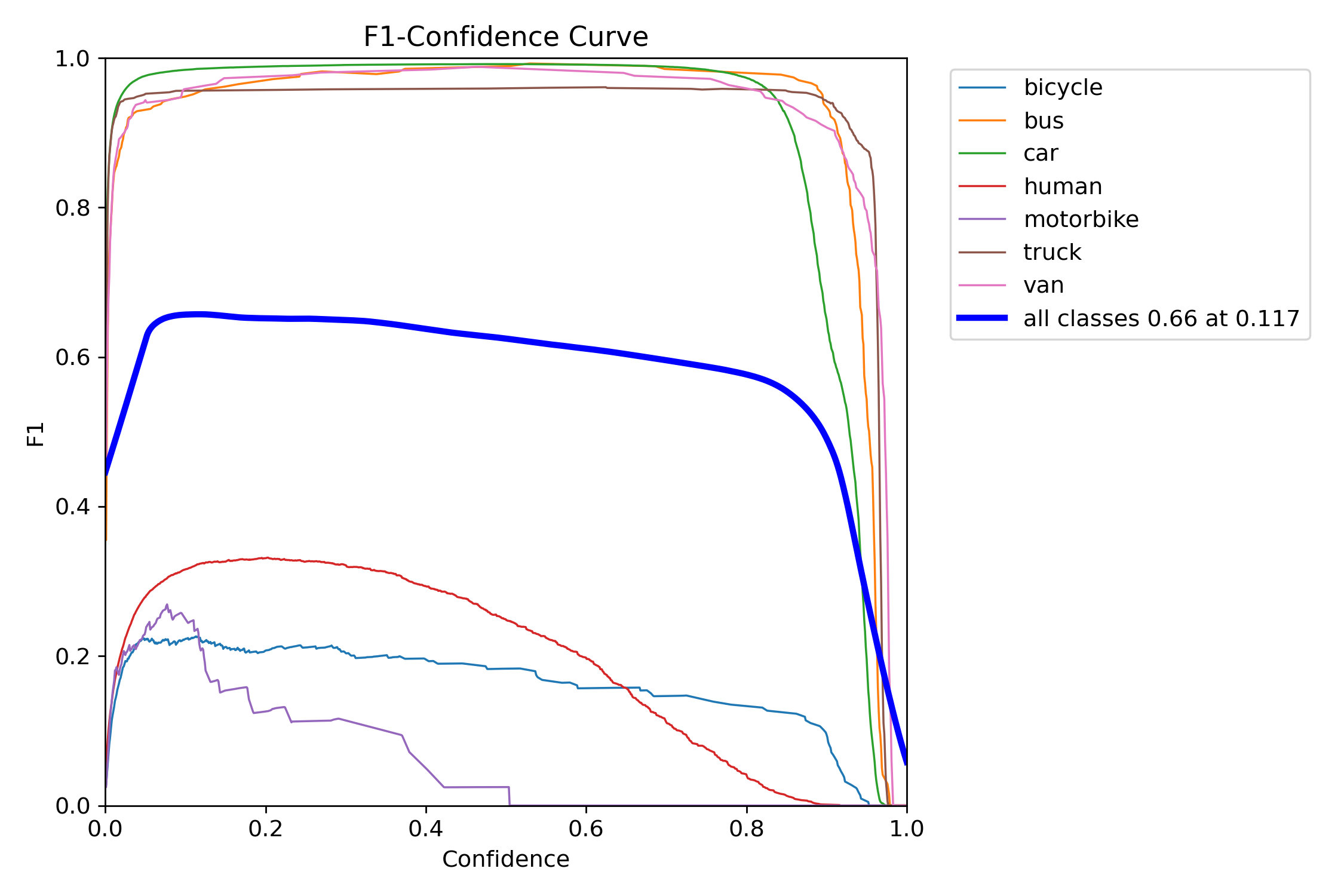

F1指數(F1 Score)是統計學和機器學習中用於評估分類模型性能的核心指標,綜合了模型的精確率(Precision)和召回率(Recall),通過調和平均數平衡兩者的表現。

當置信度為0.117時,所有類別的綜合F1值達到了0.66(藍色曲線)。

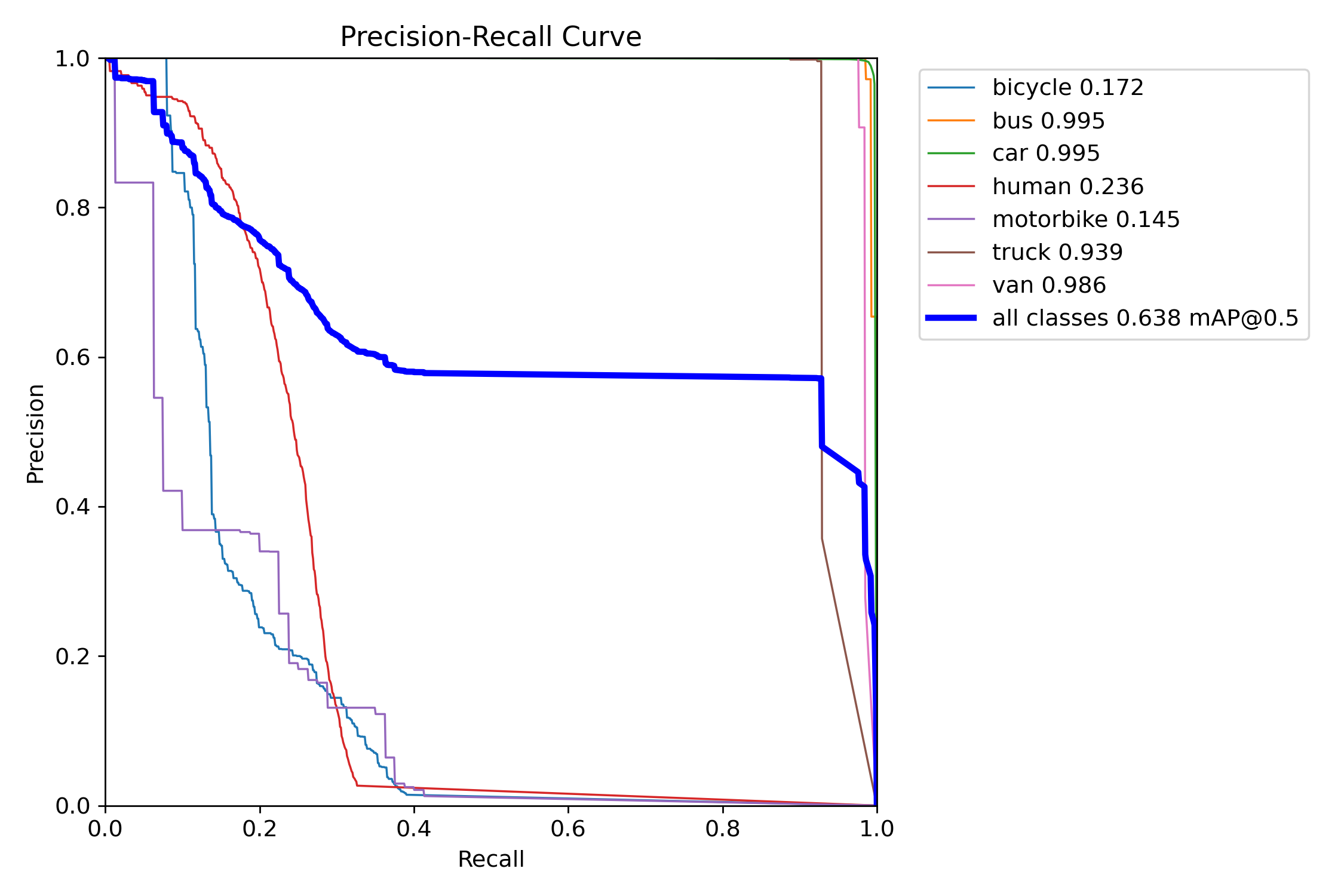

mAP@0.5:是目標檢測任務中常用的評估指標,表示在交併比(IoU)閾值為0.5時計算的平均精度均值(mAP)。其核心含義是:只有當預測框與真實框的重疊面積(IoU)≥50%時,才認為檢測結果正確。

圖中可以看到綜合mAP@0.5達到了0.638(63.8%),準確率非常高。

6. 源碼獲取方式

源碼獲取方式:https://www.bilibili.com/video/BV11jUKB2Ei9