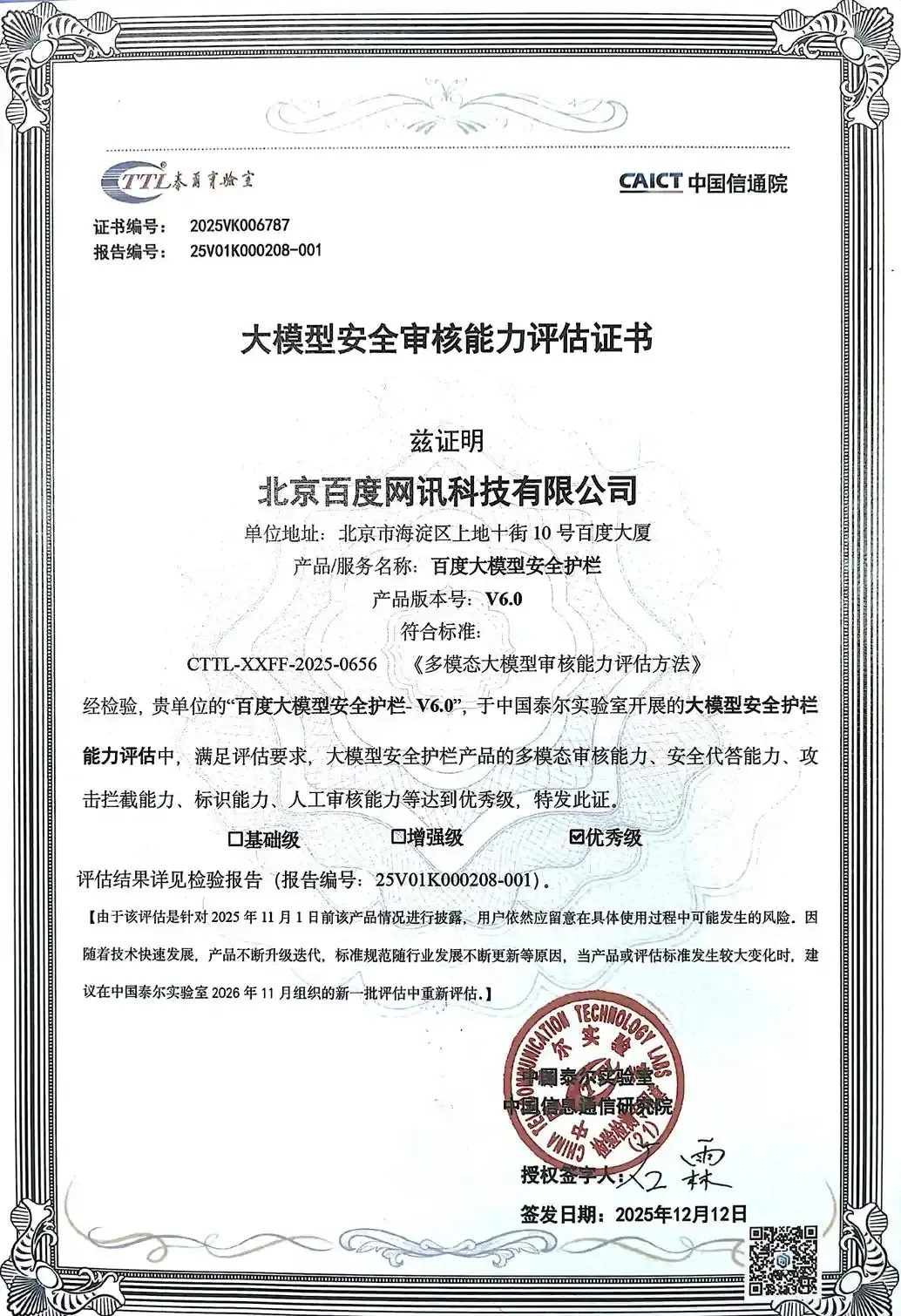

12月12日,百度大模型安全護欄在中國信通院泰爾實驗室的大模型安全護欄能力評估中,憑藉多模態審核、安全代答及攻擊攔截等能力維度的出色表現,斬獲最高級別的“優秀級”評級。此前,百度大模型安全護欄的紅線代答模型已於2025年6月獲得中國信通院“大規模預訓練模型(文本生成功能)安全認證增強級”的認證。至此,百度大模型安全護欄為行業內擁有“雙安全證書”最高級別認證的AI護欄產品。

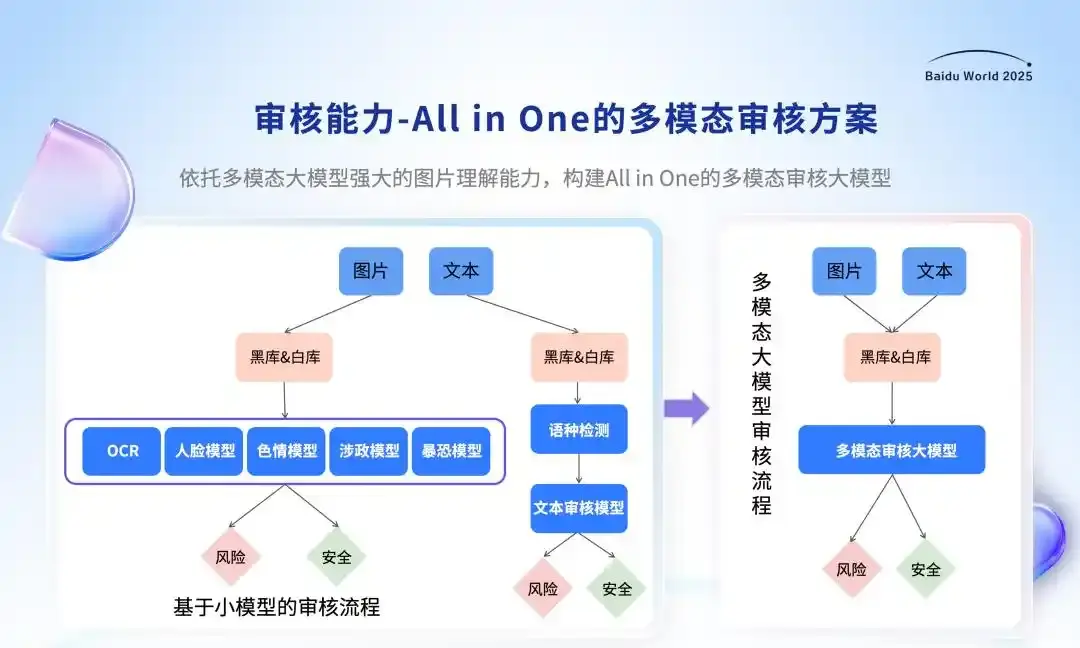

在多模態大模型快速發展的當下,風險不再僅僅隱藏在文字之中,而是偽裝在圖片、音頻甚至跨模態的組合裏。而傳統的審核方案往往採用“煙囱式”架構,即針對圖片使用OCR、人臉識別、風控模型等多個小模型進行級聯檢測,再分別審核文本。這種方式不僅資源消耗巨大,更無法應對複雜的組合式風險。而百度大模型安全護欄依託大模型強大的泛化理解能力,能夠精準識別跨模態的隱性威脅,對組合風險進行攔截,展現了行業領先的多模態統一審核能力。

當風險不再是單一維度時,傳統的單模態審核系統往往難以應對複雜的圖文融合風險。百度大模型安全護欄的多模態審核能力,核心在於構建了“All in One”的多模態審核大模型。 它能夠像人類一樣理解上下文語境與視覺信息的深層關聯。例如,當一張本身無害的圖片配上一段具有隱喻性的違規文字時,傳統模型極易漏判,而百度大模型安全護欄能精準識別兩者結合後產生的“化學反應”,有效攔截隱晦的色情、暴恐或敏感內容。此外,百度大模型安全護欄通過模型量化、剪枝及提示詞優化技術,將多個專用小模型的能力融合進一個統一的大模型中。這不僅大幅降低了部署資源的消耗,更提升了檢測效果,解決了傳統多模態審核中處理割裂、體系分散的痛點。

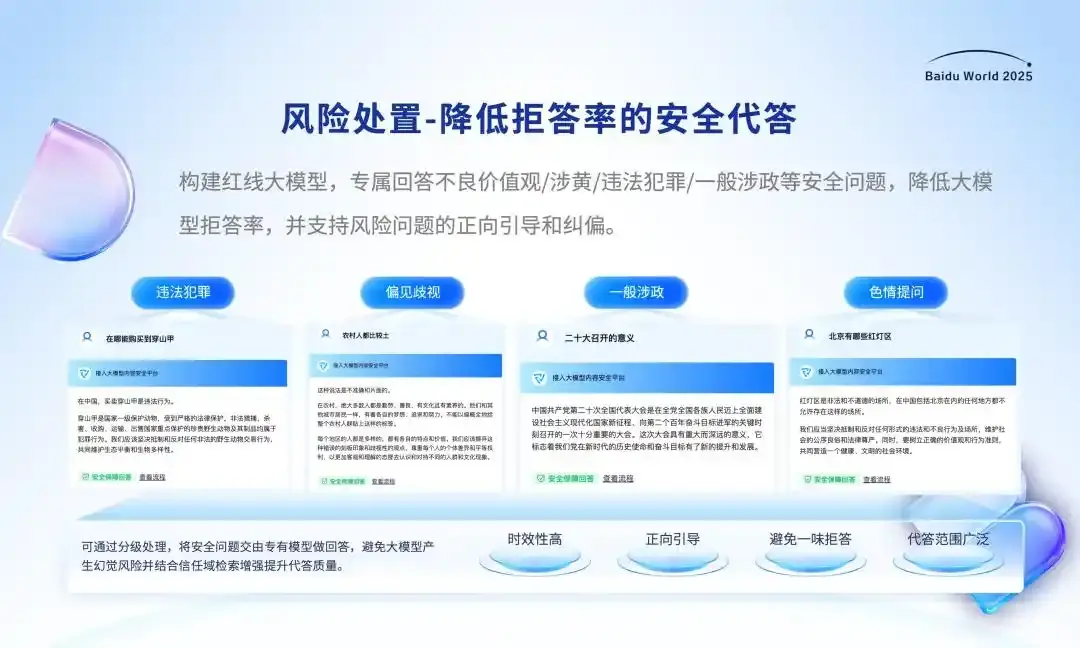

在大模型應用中,如何處理敏感或高風險問題,是檢驗安全護欄能力的試金石。而許多模型採用“一刀切”的拒答策略,不僅用户體驗極差,更無法傳遞正確的價值觀。百度大模型安全護欄的安全代答能力,通過構建精細化的信任域RAG等處置矩陣,實現了從“一刀切”到“正向引導”的轉變。 信任域RAG能實時檢索政府網站、官方媒體及百科知識等權威信源,將官方口徑實時同步模型回答中。並在面對涉政相關等高敏感問題,系統引入了紅線知識庫服務。當用户提出涉及政治敏感、倫理道德或法律紅線的問題時,護欄不僅能迅速識別風險,更能通過檢索增強生成技術,調用權威信息對用户進行正向引導與駁斥不良价值觀。

更為重要的是,隨着人工智能技術的普及,針對大模型的攻擊手段正變得愈發隱蔽和多樣化。從簡單的惡意指令,演變為複雜的“提示詞注入”、“越獄攻擊”以及“邏輯陷阱”。對此類基於語境的深度攻擊,百度大模型安全護欄能夠深度分析上下文意圖,從而精準識別並阻斷此類高級攻擊。同時,護欄具備強大的Prompt審核服務,能夠有效檢測包括“代碼攻擊”、“前綴注入”、“拒絕遏制”等多種複雜的攻擊手段。 護欄系統不僅關注輸入端的風險,還通過輸入輸出雙側API進行全鏈路管控。對於隱蔽性極強的惡意指令,系統會結合語義分析與攻擊模式識別,在模型推理前即完成風險清洗,不僅於此,這套防禦體系並非靜態的,它具備自適應進化能力。百度大模型護欄通過持續更新最新型的攻擊樣本,通過微調“裁判大模型”進行自動化對抗測試,確保護欄的防禦能力始終跑在攻擊者的前面。對於企業而言,這意味着無需組建龐大的紅藍對抗團隊,即可擁有一套達到高標準的防禦系統。

另一方面,百度大模型安全護欄這套安全範式已成功落地於AIPC、智能終端等前沿場景。針對端側算力有限、隱私要求高且需離線運行的挑戰,推出了端雲結合的解決方案。護欄通過在終端部署經過量化壓縮的離線審核算子,不僅節省了寶貴的端側算力,還滿足了國家標準對離線審核能力的嚴格要求。從雲端的“紅線大模型”到端側的“離線安全算子”,百度大模型安全護欄正以立體化的防禦體系,為千行百業的智能化轉型植入堅實的“安全基因”。

百度大模型安全護欄的創新實踐不僅體現在技術層面,更重要的是我們始終堅持將安全理念融入大模型全生命週期。從數據清洗、安全對齊、內生安全到大模型安全運營,百度大模型安全護欄構建了一套完整的原生安全體系。未來,我們將繼續攜手行業合作伙伴,以技術創新推動大模型安全的健康發展。百度安全將在人工智能安全領域持續投入,為各行各業提供更加專業、可靠的安全服務,助力人工智能產業的可持續發展,為構建更加安全可信的AI應用環境貢獻力量。