LLVM 前段時間發佈了一份關於制定 AI 工具使用政策的徵求意見稿 (RFC),允許貢獻者提交 AI 輔助的內容,但前提是必須有“人工參與”,並且貢獻者必須具備足夠的知識,能夠在代碼審查期間回答問題。

如果工具生成的內容“數量龐大”,貢獻者也應該保持透明。目前,GitHub 上已開放一個 pull request,旨在將 AI 貢獻政策添加到 LLVM 文檔中。

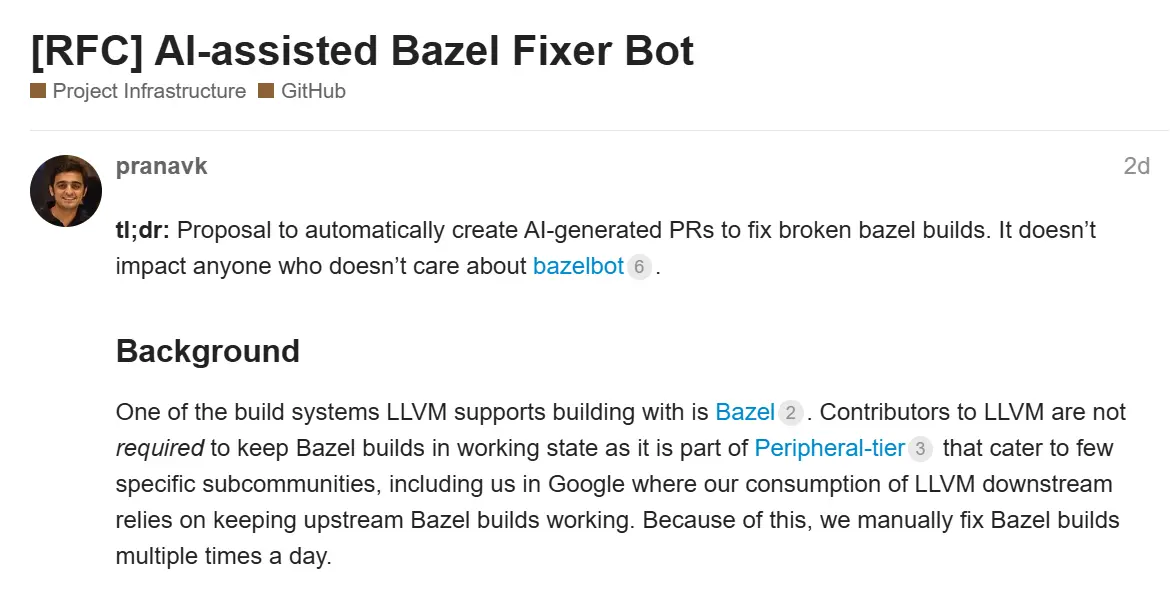

近日,谷歌編譯器工程師 Pranav Kant 又提出了一項提案,旨在創建一個 AI 輔助的 Bazel 修復機器人。這款 AI 機器人將自動生成拉取請求,用於修復使用 Bazel 構建系統時出現的 LLVM 構建問題。

谷歌是 Bazel 構建系統的主要用户,但 LLVM 貢獻者無需針對 Bazel 構建更新他們的代碼。因此,谷歌編譯器工程師希望開發一個實驗性的 AI 輔助機器人,以幫助維護 LLVM 中對 Bazel 構建的支持。

最初的提案要求該 AI 機器人創建包含修復的拉取請求,但有人對此提出了異議。一些人認為,至少應該先由人工評估這些更改,而不是讓機器人直接創建 PR,從而增加 LLVM 開發人員審查機器人代碼的負擔。

與此同時,GNU 工具鏈開發人員也在考慮為 GCC 編譯器制定 AI/LLM 策略。

詳情可查看:https://discourse.llvm.org/t/rfc-llvm-ai-tool-policy-human-in-the-loop/89159/1