首個在國產芯片上全程訓練的SOTA多模態模型GLM-Image,開源不到24小時即登頂全球知名AI開源社區Hugging Face Trending榜第一。模型SOTA性能、創新架構和訓練過程引發海外科技圈熱議。

這也是首次完全依託國產芯片訓練的國產模型在國際舞台上取得榜首身位,標誌國產AI模型的端到端自主研發能力在國際競爭中取得突破。

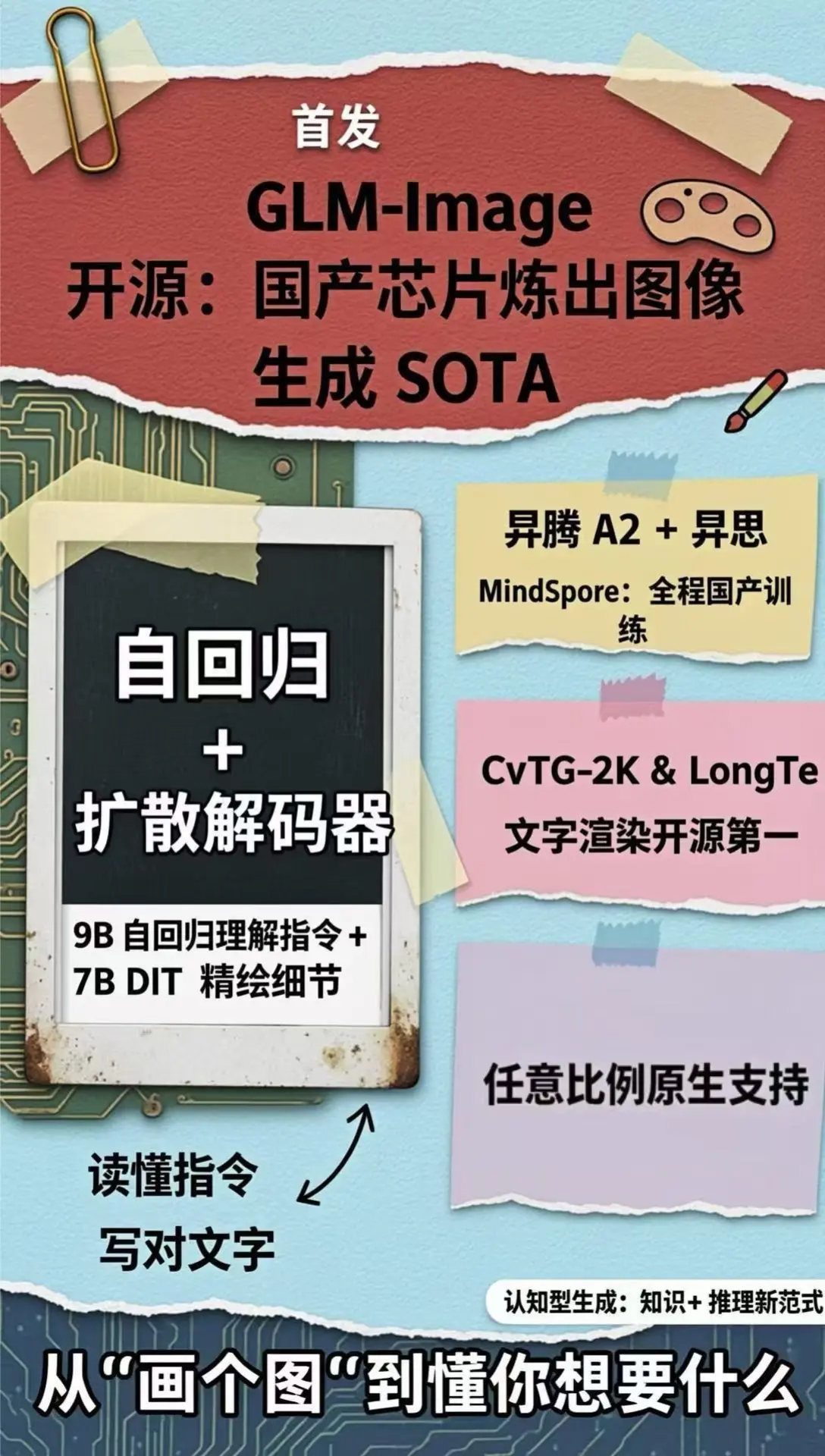

GLM-Image項目的最終目標就是全流程創新,是GLM團隊面向以Nano Banana Pro為代表的新一代「認知型生成」技術範式的一次重要探索。

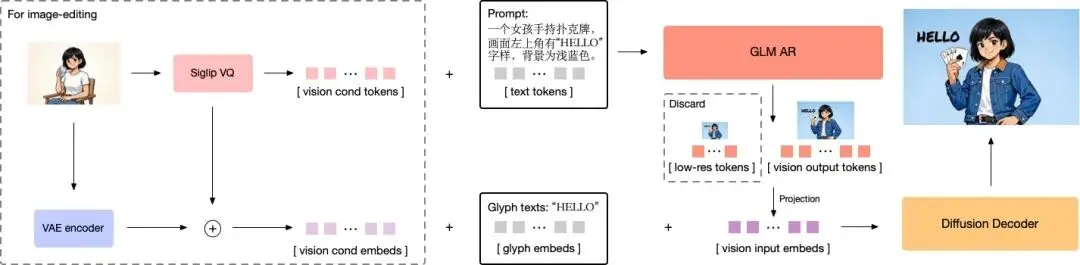

從架構上看,不同於開源常用的LDM方案,GLM-Image採用了創新的「自迴歸+擴散解碼器」混合架構,並在基本對齊主流方案的基礎上驗證了新架構在知識密集型場景下生成的優越性。

通用pipeline

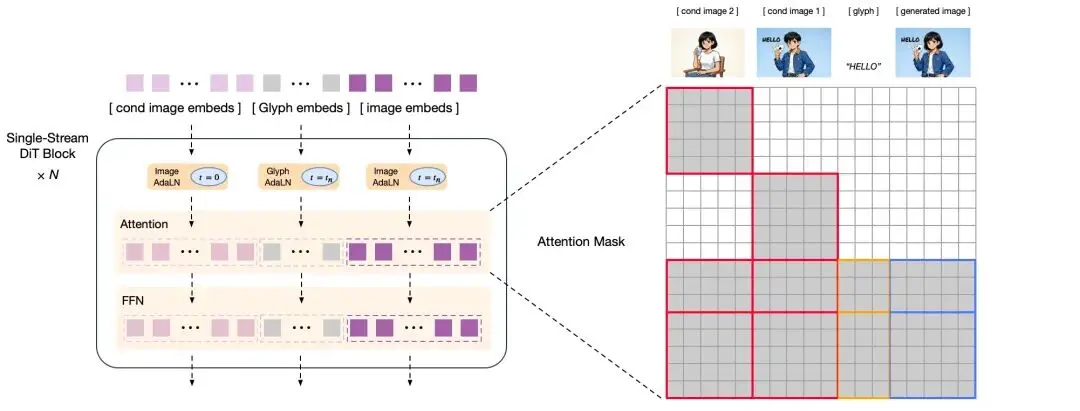

解碼器結構示意圖

從訓練基礎上看,GLM-Image實現了基於昇騰Atlas 800T A2設備和昇思MindSpore AI框架的全流程訓練及推理適配,實際訓練性能足以達到相應計算設備的彙報性能上限,驗證了在國產算力上訓練出SOTA模型的可行性。

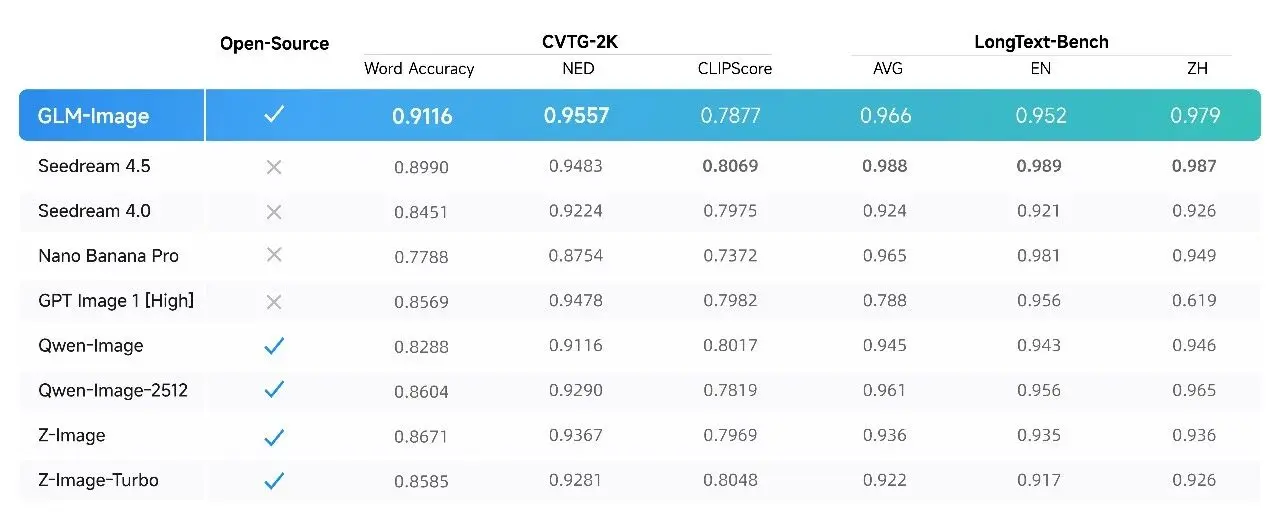

從性能表現上看,GLM-Image在CVTG-2K(複雜視覺文本生成)和LongText-Bench(長文本渲染)榜單獲得開源第一,能夠讀懂指令,寫對文字,尤其擅長漢字生成任務,可廣泛應用於海報、PPT、科普圖等知識密集型場景。

即刻體驗

登錄智譜清言APP/網頁版,進入“AI畫圖”智能體,左下角選擇GLM-Image,即可免費體驗。

開源地址

GitHub:https://github.com/zai-org/GLM-Image

Hugging Face:https://huggingface.co/zai-org/GLM-Image