清華大學自然語言處理實驗室(THUNLP)與 OpenBMB 團隊的研究人員發佈了題為《H-Neurons: On the Existence, Impact, and Origin of Hallucination-Associated Neurons in LLMs》的研究論文。該研究從識別、行為影響和起源三個維度,對Large Language Models (LLMs)中的幻覺關聯神經元(H-Neurons)進行了系統性調查。

論文地址:https://arxiv.org/pdf/2512.01797

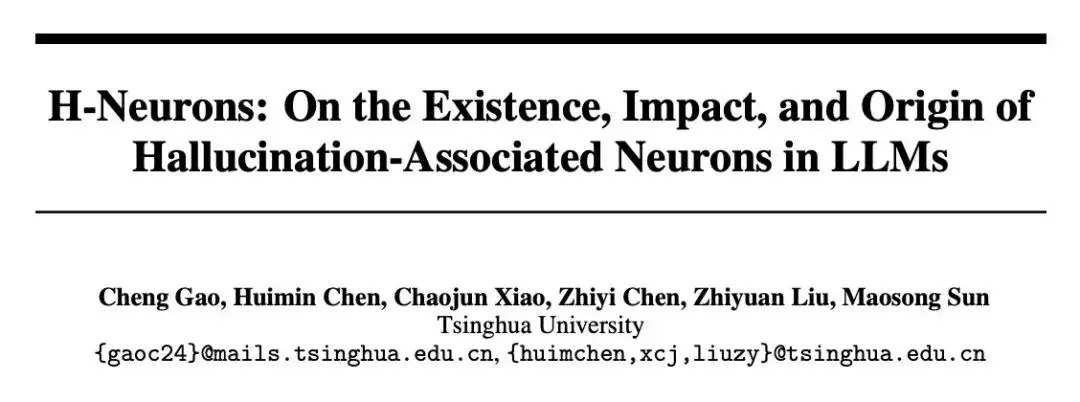

在識別方面,研究證明 LLMs 中存在一個比例極低的稀疏神經元子集(佔總神經元數量不到 0.1% ),這些 H-Neurons 能夠可靠地預測幻覺的發生。官方數據顯示,該預測能力在從通用知識到生物醫學等不同領域和場景中展現出極強的泛化性。

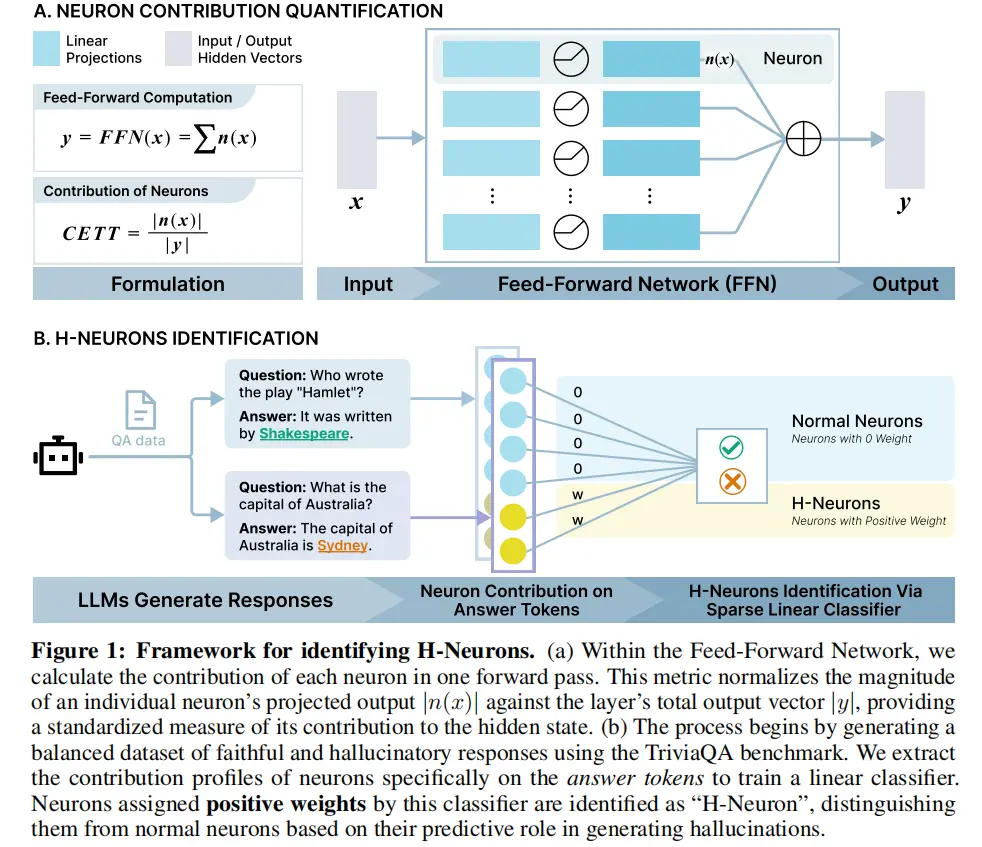

在行為影響方面,通過受控干預實驗,研究揭示了 H-Neurons 與模型的“過度順從”(Over-compliance)行為之間存在因果聯繫。干預實驗證明,這些神經元會強制模型優先考慮滿足用户 Prompt 的需求,即便 Prompt 中包含錯誤的前提,模型也會選擇迎合用户而非堅持事實真相,這被認為是幻覺產生的核心物理來源。

在起源追溯方面,研究人員將這些神經元定位到了預訓練(Pre-trained)基礎模型階段。研究發現,這些神經元在預訓練期間就已經具備了對幻覺檢測的預測性,表明幻覺傾向並非產生於後期微調,而是深植於基礎模型的“下一個 Token 預測”這一訓練目標中。

該研究成果將 LLMs 的宏觀行為模式與微觀神經機制連接起來,為解決 LLMs 事實準確性問題以及開發更可靠的模型提供了見解。目前,該研究論文已提交至 arXiv。