騰訊混元 AI Infra 團隊開源生產級高性能 LLM 推理核心算子庫 HPC-Ops,該算子庫基於生產環境痛點,採用 CUDA 和 CuTe 從零構建,通過抽象化工程架構、微架構深度適配及指令級極致優化等,降低底層算子開發門檻,將核心算子性能逼近硬件峯值,實現了顯著性能突破。

據介紹,騰訊混元使用 CUDA 和 CuTe 開發的這套輕量、高效的 LLM 核心算子庫,主要包括幾個模塊:FusedMoE、Attention、機內/機間通信、Norm、Sampler、以及各類小算子的融合算子。通過分析任務特性和硬件微架構,將任務的劃分邏輯與硬件指令做了更好的對齊,以此獲得更好的性能,並且對工程代碼進行了適度的抽象,讓開發者能聚焦於算法本身,降低維護門檻。

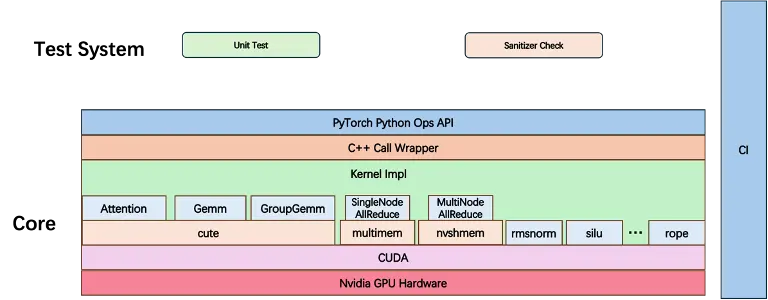

HPC-Ops 算子庫架構如下:

騰訊混元 AI Infra 團隊表示,在真實場景下,基於 HPC-Ops,混元模型推理 QPM 提升 30%,DeepSeek 模型 QPM 提升 17%。同時,在單算子性能方面,HPC-Ops 實現 Attention 相比 FlashInfer/FlashAttention 最高提升 2.22 倍;GroupGEMM 相比 DeepGEMM 最高提升 1.88 倍;FusedMoE 相比 TensorRT-LLM 最高提升 1.49 倍。

開源地址:https://github.com/Tencent/hpc-ops