騰訊混元正式開源翻譯模型 1.5 版本,共包含兩個模型:Tencent-HY-MT1.5-1.8B和Tencent-HY-MT1.5-7B,支持33個語種互譯以及5種民漢/方言,除了中文、英語、日語等常見語種,也包含捷克語、馬拉地語、愛沙尼亞語、冰島語等小語種。

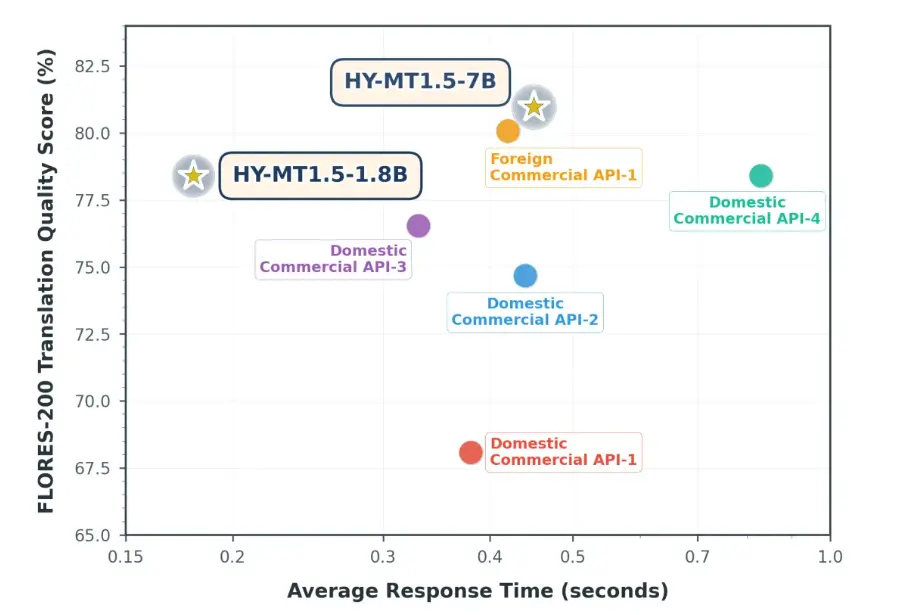

根據介紹,HY-MT1.5-1.8B主要面向手機等消費級設備場景,經過量化,支持端側直接部署和離線實時翻譯,僅需1GB內存即可流暢運行,並且在參數量極小的前提下,效果超過了大部分商用翻譯API。同時,模型也體現出了極致的效率和性價比,與主流商用翻譯模型API對比,HY-MT1.5-1.8B 推理速度更快,處理50個tokens的平均耗時只有0.18秒,其他模型的時間在0.4秒左右。

HY-MT1.5-7B模型效果相比前一版本效果有較大提升,是此前獲得WMT25比賽30個語種翻譯冠軍模型的升級版,重點提升了翻譯準確率,大幅減少了譯文中夾帶註釋和語種混雜的情況,實用性進一步增加。

在部分用户實際使用場景下,混元翻譯1.8B和7B兩個尺寸模型同時使用,可以實現端側和雲側模型的協同部署,提升模型的效果的一致性和穩定性。

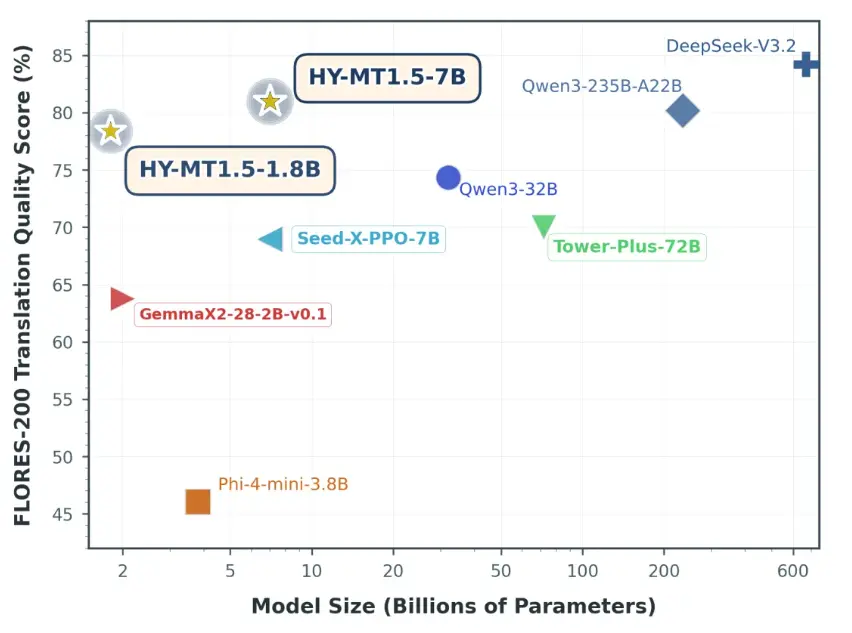

在常用的中外互譯和英外互譯測試集Flores200、WMT25以及民漢語言的測試集中,Tencent-HY-MT1.5-1.8B全面超越中等尺寸開源模型和主流商用翻譯API,達到Gemini-3.0-Pro這種超大尺寸閉源模型的90分位水平。在WMT25和民漢翻譯測試集上,其效果僅略微差於Gemini-3.0-Pro,遠超其他模型。

HY-MT1.5系列模型在翻譯質量與響應效率之間達到了出色的平衡。具體而言,HY-MT1.5-1.8B模型在FLORES-200質量評估中取得了約78%的分數,同時平均響應時間僅為0.18秒,超越主流商用翻譯API。

針對各類場景,兩個模型均實現了對術語庫、長對話、帶格式文本(例如網頁)的翻譯支持,更加全面。

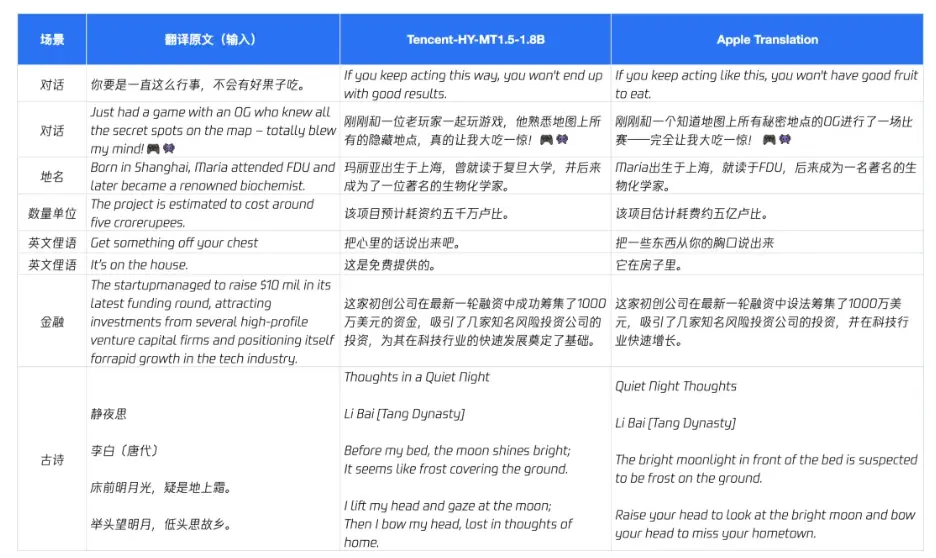

以下為混元 Tencent-HY-MT1.5-1.8B 與蘋果手機自帶離線翻譯的結果對比:

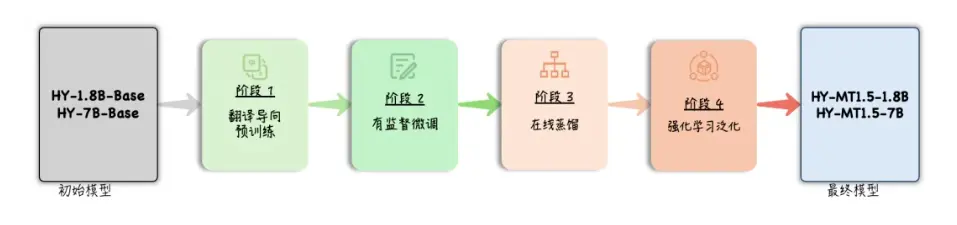

技術方面,HY-MT1.5-1.8B能夠用小尺寸實現大尺寸模型的效果,得益於On-Policy Distillation(大尺寸模型蒸餾)策略的引入,讓 HY-MT1.5-7B 作為 Teacher,實時引導 1.8B 的 Student 模型,讓其避免死記硬背標準答案,通過糾正在預測序列分佈時的偏移,讓小模型從錯誤中學習,切實提升能力。