智源研究院已正式發佈新一代具身智能大腦基礎模型 RoboBrain2.5,直面具身智能 “空間不準” 和 “過程不穩” 的兩大長期短板,通過大規模、高質量的時空監督訓練,實現了兩項面向真實物理世界的關鍵升級:

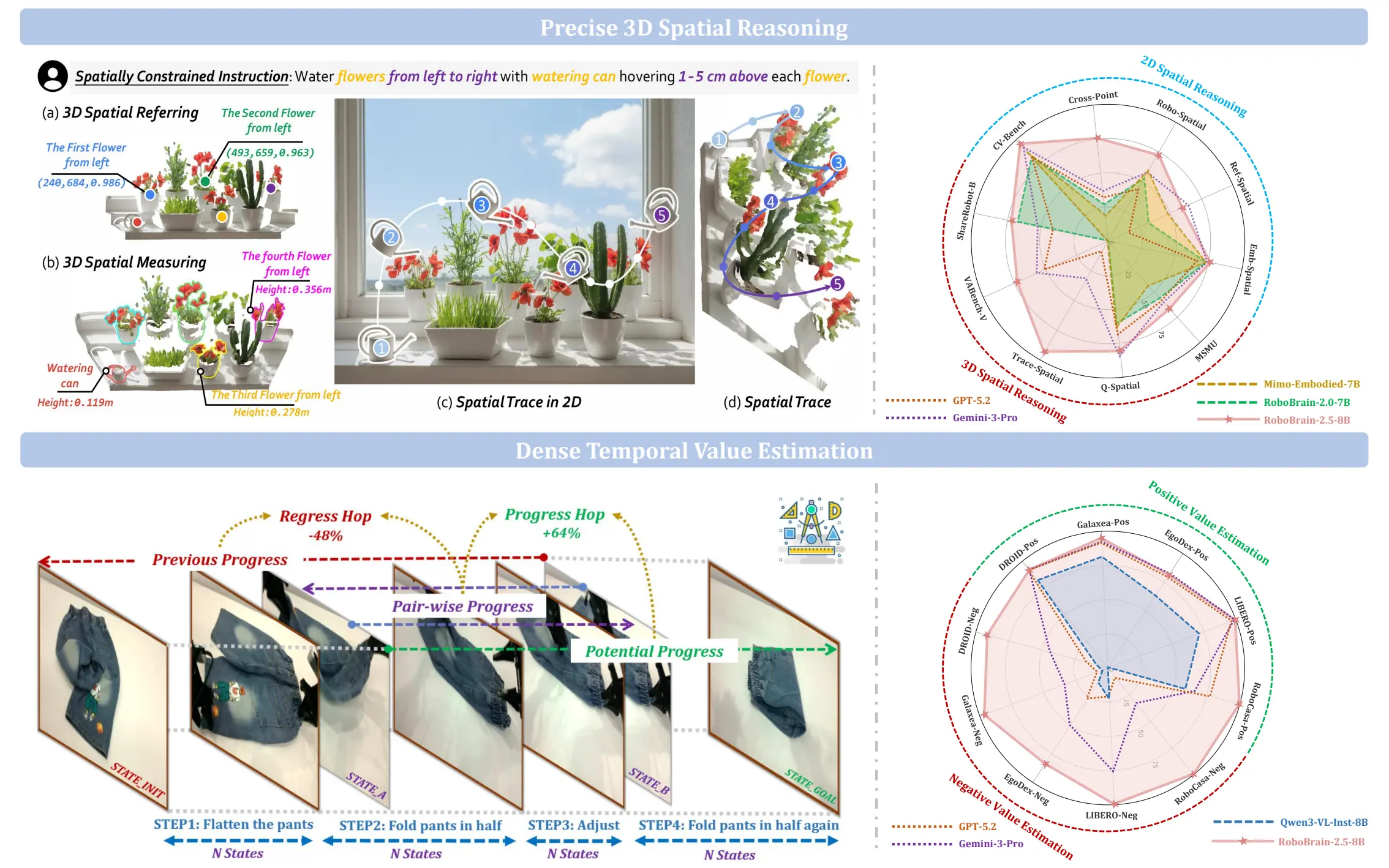

- 精確 3D 空間推理:將 2D 視覺理解轉化為真實尺度下的可執行軌跡,讓機器人 “抓得準、放得穩”。

- 稠密時序價值預測:實時評估任務進度與狀態風險,支持長時、動態任務中的自適應調整與閉環恢復。

據介紹,作為 RoboBrain 系列的最新版本,RoboBrain 2.5 在延續通用感知、空間推理與時序建模能力底座的基礎上,通過更大規模的高質量時空監督訓練,完成了兩項面向真實物理世界的關鍵升級:Precise 3D Spatial Reasoning(精確 3D 空間推理)與 Dense Temporal Value Estimation(稠密時序價值預測),讓機器人不僅能理解任務,更能在物理約束與過程反饋中把任務做對,推動具身智能從 “能看懂、能説清”,邁向 “能落手、做得準、做得穩”。

RoboBrain 2.5 已在多項空間推理和時序價值估計的基準任務中取得 SOTA 表現,有力推動具身智能邁向可部署、可閉環、可規模化的未來。

下載與使用:

項目主頁:https://superrobobrain.github.io

技術報告:https://arxiv.org/abs/2601.14352

GitHub:https://github.com/FlagOpen/RoboBrain2.5

模型權重:https://huggingface.co/collections/BAAI/robobrain25

RoboBrain2.5 多芯片適配:https://huggingface.co/FlagRelease